Vineet Bhatkotiは2025年11月7日、DZoneにおいてプロンプトエンジニアリングとコンテキストエンジニアリングの違いを解説した。

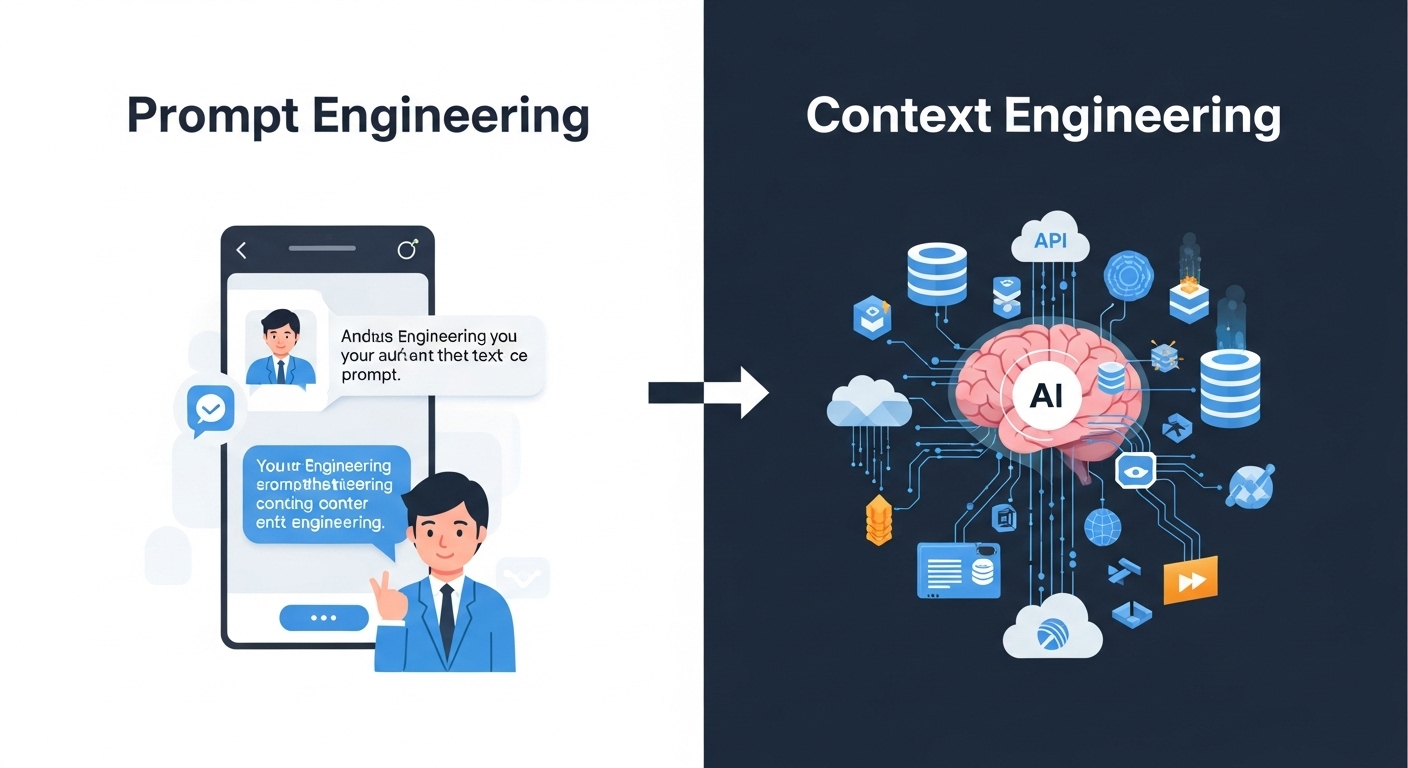

プロンプトエンジニアリングはLLMモデルへの指示や入力を作成する手法で、各インタラクションが独立したステートレスな特徴を持つ。一方、コンテキストエンジニアリングは外部知識ベース、データベース、APIなどの関連データをLLMに提供する手法で、インタラクション全体でコンテキストを維持するステートフルな特性を持つ。

比較分析では、プロンプトエンジニアリングは複雑さが低いが、トークン使用量が高く、スケーラビリティが低い。

コンテキストエンジニアリングは複雑さが高いが、トークン使用量が低く、一貫性とスケーラビリティが高い。

業界は信頼性、スケーラビリティ、保守性、コスト効率の観点から本番システムではコンテキストエンジニアリングに向かう傾向がある。

From: ![]() Prompt Engineering vs Context Engineering

Prompt Engineering vs Context Engineering

【編集部解説】

大規模言語モデル(LLM)が登場して以来、「プロンプトエンジニアリング」は開発者にとって重要なスキルとして注目されてきました。適切な言葉選びや指示の与え方によって、AIの出力品質が大きく変わることが分かっていたからです。しかし2025年、AI開発の現場では新たなパラダイムシフトが起きています。それが「コンテキストエンジニアリング」への移行です。

この変化の背景には、AIシステムの複雑化があります。初期のLLMアプリケーションは、ユーザーが入力したプロンプトに対して一度だけ応答を返す「ワンショット」型が主流でした。しかし現在では、複数のデータソースにアクセスし、過去の会話履歴を記憶し、外部ツールを活用しながら複雑なタスクを遂行する「エージェントAI」が台頭しています。こうした高度なシステムでは、単なるプロンプトの工夫だけでは不十分なのです。

コンテキストエンジニアリングとは、LLMが応答を生成する際に「何を知っているか」を設計する技術です。これには外部データベースへのアクセス、API連携、過去の会話履歴の管理、リアルタイムデータの取得などが含まれます。特に重要なのが「RAG(Retrieval-Augmented Generation:検索拡張生成)」と呼ばれる技術で、LLMが必要な情報を外部から動的に取得し、それを基に回答を生成する仕組みです。

Gartnerは2025年10月のレポートで、コンテキストエンジニアリングをAI戦略の中核として位置づけるべきだと提言しています。同社の定義によれば、コンテキストエンジニアリングとは「AIシステムが意図を理解し、より良い意思決定を行い、ビジネスに沿った成果を提供できるよう、関連データ、ワークフロー、環境を設計・構造化すること」です。

実際の企業での採用も進んでいます。医療分野では、最新の臨床ガイドラインや研究論文をリアルタイムで参照しながら診断支援を行うシステムが導入され、診断精度の向上と意思決定時間の短縮を実現しています。金融業界では、市場レポートや決算報告書などのライブデータを取得しながら分析を行うAIアナリストシステムが活用されています。

この技術的進化は、AI開発者の役割そのものも変えつつあります。従来のプロンプトエンジニアリングが「言語学的なチューニング」だったのに対し、コンテキストエンジニアリングは「システム設計」の領域です。どのデータソースを使うか、どのタイミングで情報を取得するか、トークン制限の中でどう優先順位をつけるか——こうした戦略的判断が求められます。

ただし、コンテキストエンジニアリングにも課題があります。取得するコンテキストの品質が低ければ、かえって出力精度が下がる「コンテキスト劣化」が起こります。Googleの研究では、不十分なコンテキストを与えられたLLMは、コンテキストがない場合よりも誤った回答(幻覚)を生成する割合が高くなることが示されています。また、複雑なデータインフラの構築には技術的ハードルとコストがかかります。

それでも業界全体は、本番環境で信頼性の高いAIシステムを構築するには、コンテキストエンジニアリングが不可欠だという共通認識を持ち始めています。プロンプトエンジニアリングが実験やプロトタイピングに適しているのに対し、コンテキストエンジニアリングは大規模な業務システムに必要な一貫性、精度、スケーラビリティを提供するからです。

AnthropicやOpenAI、Googleといった主要AI企業も、コンテキストエンジニアリングを支援するツールや機能を次々とリリースしています。これは一時的なトレンドではなく、AI開発の新しい標準になりつつあると言えるでしょう。

【用語解説】

プロンプトエンジニアリング(Prompt Engineering)

LLMに対して適切な指示や入力を作成する技術である。質問の表現方法を最適化することで、望ましい出力を得ることを目指す。各インタラクションが独立したステートレスな特徴を持つ。

コンテキストエンジニアリング(Context Engineering)

LLMが応答を生成する際に参照する情報環境全体を設計・構築する技術である。外部知識ベース、データベース、API、過去の会話履歴などをLLMに提供し、インタラクション全体でコンテキストを維持するステートフルな特性を持つ。

RAG(Retrieval-Augmented Generation / 検索拡張生成)

LLMが外部データソースから関連情報を動的に取得し、その情報を基に回答を生成する技術である。事前学習データに依存せず、リアルタイムの情報や組織固有のデータを活用できるため、幻覚(ハルシネーション)の低減と回答精度の向上が期待できる。

LLM(Large Language Model / 大規模言語モデル)

膨大なテキストデータで訓練された自然言語処理のAIモデルである。GPT、Claude、Geminiなどが代表的なLLMであり、テキスト生成、質問応答、翻訳などの幅広いタスクに対応する。

トークン(Token)

LLMが処理する情報の基本単位である。一般的に、単語や文字のまとまりが1つのトークンとして扱われる。LLMにはコンテキストウィンドウと呼ばれるトークン数の制限があり、一度に処理できる情報量が決まっている。

エージェントAI(Agentic AI)

自律的に判断し、複数のツールやデータソースにアクセスしながら複雑なタスクを遂行するAIシステムである。単純な質問応答を超えて、計画立案、情報収集、実行、検証のサイクルを自動で回すことができる。

コンテキストウィンドウ(Context Window)

LLMが一度に処理できる情報の上限である。トークン数で表され、モデルによって異なる。コンテキストウィンドウが大きいほど、より多くの情報を参照して回答を生成できる。

【参考リンク】

Anthropic(外部)

Claude AIを開発するAI安全性研究企業。コンテキストエンジニアリングに関する公式ドキュメントを公開している

Anthropic – Effective Context Engineering for AI Agents(外部)

AIエージェントのためのコンテキストエンジニアリング戦略を解説した公式技術記事

Gartner – Context Engineering(外部)

調査会社Gartnerによるコンテキストエンジニアリングの解説記事。エンタープライズAIにおける重要性を分析

Prompt Engineering Guide – Context Engineering Guide(外部)

コンテキストエンジニアリングの実践的なガイド。具体的な実装例とともにプロンプトエンジニアリングとの違いを解説

DZone(外部)

開発者向けの技術情報プラットフォーム。AI、ソフトウェア開発、DevOpsなどの最新トレンドを提供

【参考記事】

Context Engineering vs Prompt Engineering – Medium(外部)

プロンプトエンジニアリングとコンテキストエンジニアリングの違いを実例とともに詳しく解説している

Beyond prompt engineering: the shift to context engineering – Nearform(外部)

プロンプトエンジニアリングからコンテキストエンジニアリングへの移行を解説している記事

Context Engineering: Going Beyond Prompt Engineering and RAG – The New Stack(外部)

コンテキストエンジニアリングがRAGを超えた包括的アプローチである理由を解説している

Context Engineering is the ‘New’ Prompt Engineering – Analytics Vidhya(外部)

RAGや構造化プロンプトを使ったコンテキストエンジニアリングの実践方法を解説している

Is RAG Dead? The Rise of Context Engineering and Semantic Layers – Towards Data Science(外部)

RAGの進化とコンテキストエンジニアリングの台頭を解説している分析記事

The State of Retrieval-Augmented Generation (RAG) in 2025 – Aya Data(外部)

2025年におけるRAGの現状と将来展望を医療、金融、小売の実例とともに紹介している

【編集部後記】

AIツールを使っていて、「思った通りの答えが返ってこない」と感じたことはありませんか?私たちも同じ経験をしてきました。

この記事で紹介したプロンプトエンジニアリングとコンテキストエンジニアリングの違いは、まさにその課題を解決するヒントになるかもしれません。

特に、業務でAIを活用している方、AIエージェントの構築を検討されている方にとって、コンテキストの設計という視点は新たな可能性を開くはずです。

みなさんは普段、AIとどのように対話していますか?プロンプトだけで満足していますか、それともより深いコンテキストが必要だと感じていますか?

ぜひ、ご自身の経験と照らし合わせながら、この技術の進化を一緒に見守っていきましょう。