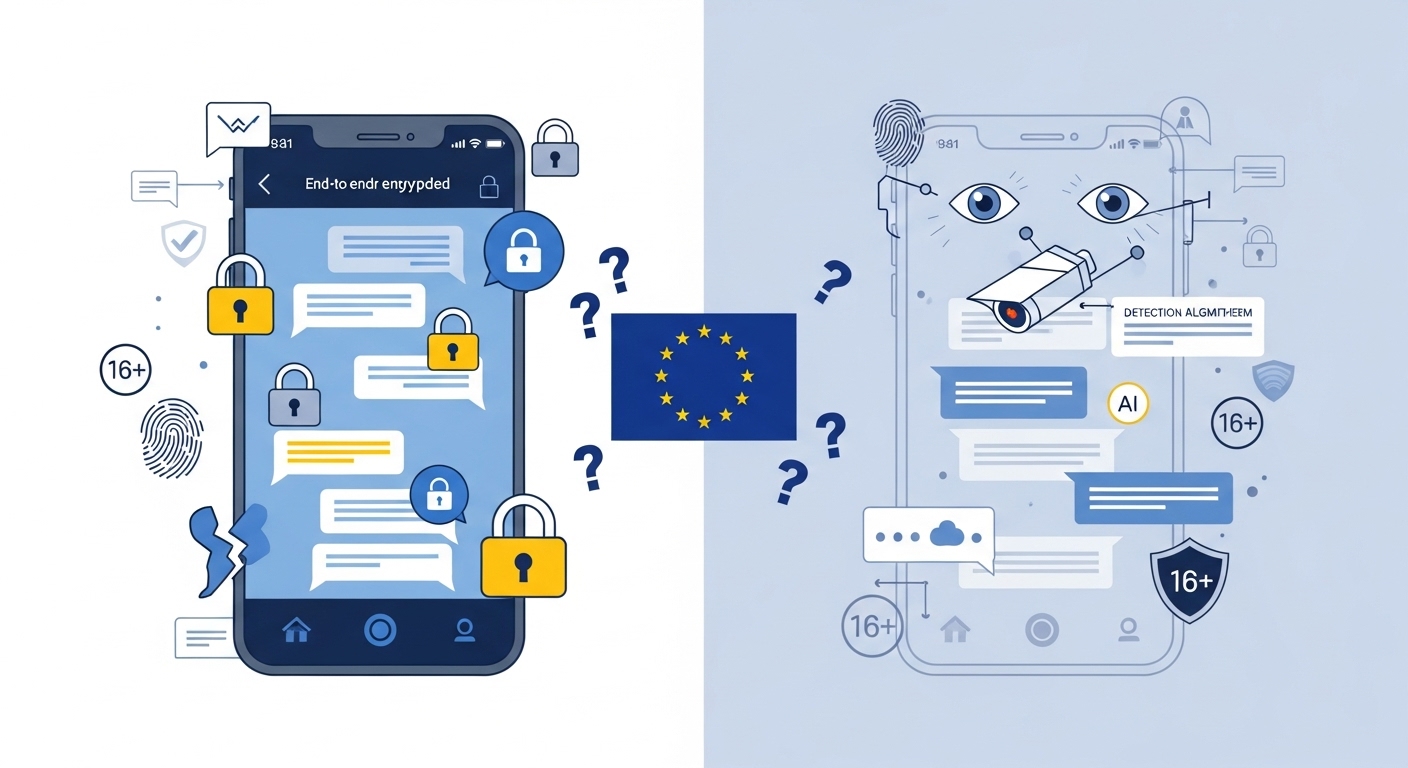

欧州では今、「チャットコントロール規則(CSAR)」を巡る議論が白熱しています。メールやメッセンジャーまで監視対象にするこの法案は、児童性的虐待対策という目的を掲げながらも、令状なしアクセスや匿名性制限といった重大な懸念を伴っています。

元欧州議会議員のパトリック・ブライヤー氏は2025年10月30日、デンマークがEUのチャットコントロール提案を更新し、プライベートチャットの一般的な監視ではなく機密情報の自主的な検索に切り替えたと発表した。

検索はプロバイダーが自主的に実施を選択できる形となる。しかしブライヤー氏は3つの重大な問題が未解決だと指摘する。第一に通信チャネルへのアクセスを裁判所のみが決定できるという欧州議会の立場に従っていない。第二に提案第6条により子ども(年齢不明瞭)に対し「リスクのある」アプリの提供を制限しなければならない。第三に提案第4条3項により匿名メールやメッセージアカウント、匿名チャットが事実上禁止され、IDや顔の提示が必要となる可能性が高い。この記事はEU Tech Loopで公開されEuronewsに掲載された。

From: ![]() New Danish proposal for chat control: three fat problems remain

New Danish proposal for chat control: three fat problems remain

【編集部解説】

このニュースを理解するには、まず「デンマークが提案を取り下げた」という一部報道の誤解を解く必要があります。10月末にデンマーク司法大臣ピーター・フメルゴー氏が表明したのは、チャットコントロールの「強制スキャン」を取り下げ「自主的なスキャン」に戻すという方針転換です。提案そのものが消えたわけではなく、むしろ修正版として議論が続いています。

EUのチャットコントロール規制案は2022年5月に欧州委員会が提出した法案で、児童性的虐待コンテンツ(CSAM)対策を名目に、メッセンジャーやメールサービスプロバイダーに対してすべてのプライベート通信を自動スキャンすることを義務付けようとするものでした。これはエンドツーエンド暗号化された通信も対象とし、暗号化される前の段階でクライアント側(ユーザーのデバイス上)でスキャンする仕組みです。

今回デンマークが示した修正案の最大のポイントは、このスキャンを「強制」から「自主的」に変更したことです。これによりプロバイダーは自らの判断でスキャンを実施するかどうかを選択できるようになります。現在もGmail、Facebook Messenger、Skypeなどの一部米国企業は自主的にスキャンを実施していますが、この枠組みは2026年4月3日に期限切れとなる予定です。

しかし記事が指摘する通り、3つの深刻な問題は解決されていません。

第一の問題は、裁判所の令状なしでの通信の秘密の侵害です。欧州議会は裁判所命令によってのみ通信スキャンを許可すべきだと主張していますが、デンマーク案はこの立場を採用していません。つまり司法の監視なしに、行政の判断で個人の通信内容にアクセスできる状態が続くことになります。欧州司法裁判所の元判事ニノン・コルネリック氏も、このような無差別監視は基本的人権を侵害すると警告しています。実際、EUのデータ保護監督官も同様の懸念を表明しており、ドイツでは既に訴訟が起こされています。

第二の問題は、年齢確認システムが実質的に匿名性を禁止することです。提案第4条3項により、ユーザーは匿名でメールやメッセンジャーアカウントを作成できなくなり、身分証明書や顔認証による本人確認が必要になることが懸念されます。これはジャーナリストと内部告発者の連絡、性的マイノリティに関する相談、政治活動など、匿名性が不可欠なコミュニケーションに致命的な影響を与えます。InstagramなどではAIによる顔分析での年齢推定も導入されていますが、このような生体情報は外部企業に委託されることが多く、データ漏洩や誤用のリスクが高まります。

第三の問題は、「子ども」がメッセージングアプリをインストールできなくなることです。提案第6条における「リスクのあるアプリ」は、WhatsApp、Telegram、Snapchat、X、Instagram、TikTok、さらにはZoomやSkypeといったビデオ会議アプリまでを対象としてしまう可能性があります。イギリスのオンライン安全法の経験からも、若者はVPNなどを使ってこうした制限を簡単に回避できることが分かっています。効果が疑問視される一方で、デジタルコミュニケーションから若者を排除するという深刻な副作用が生じます。

さらに見落とせないのは、小規模・個人のサービス提供者への影響です。年齢確認システムの導入には技術的にも財政的にも大きなコストがかかります。GoogleやMetaのような大企業は対応できても、プライバシーを重視する小規模な暗号化メッセンジャーサービスや個人開発者にとっては禁止的な負担となり、市場から締め出される可能性があります。これは結果的に、プライバシー保護よりもビジネスモデルを優先する大手プラットフォームへの集中を加速させることになるでしょう。

この議論の根底には、セキュリティとプライバシーのトレードオフという古典的なジレンマがあります。児童保護という目的自体に異論を唱える人は少ないでしょう。しかし欧州基本権憲章第7条(プライバシー権)、第8条(データ保護権)、第11条(表現の自由)といった基本的人権とのバランスをどう取るかが問われています。欧州司法裁判所は過去の判例で、一般的かつ無差別な監視は基本的人権と両立しないと繰り返し判断してきました。

今後の展開としては、修正案でも強硬派の加盟国や欧州委員会の支持を得られない可能性があります。パトリック・ブライヤー氏が指摘するように、妥協案を受け入れるよりも法案自体を頓挫させる方を選ぶ勢力もいるためです。2026年4月の期限までに新たな法的枠組みが合意されなければ、EUは児童保護のための法的手段を失うことになります。この議論は、デジタル時代における基本的人権の保護と公共の安全という、テクノロジー社会が直面する最も困難な課題の一つを象徴しています。

【用語解説】

チャットコントロール(Chat Control)

正式名称は「児童性的虐待を防止・対策する規則(Regulation to Prevent and Combat Child Sexual Abuse)」で、2022年5月に欧州委員会が提案したEU法案である。メッセージングサービスやメールプロバイダーに対して、児童性的虐待コンテンツ(CSAM)を検出するため、エンドツーエンド暗号化された通信を含むすべてのプライベート通信の自動スキャンを義務付けようとするもので、プライバシー侵害の懸念から強い反対を受けている。

CSAM(Child Sexual Abuse Material)

児童性的虐待コンテンツのことで、児童が性的に搾取されている画像や動画を指す。従来は「児童ポルノ」と呼ばれていたが、被害を受けた児童を尊重し、犯罪の性質を正確に表現するため、国際的にこの用語が使用されるようになった。

エンドツーエンド暗号化(End-to-End Encryption)

送信者のデバイスで暗号化され、受信者のデバイスでのみ復号化される通信方式である。通信経路上のサーバーや第三者は暗号化されたデータしか見ることができず、最も強固なプライバシー保護を提供する。WhatsApp、Signal、Telegramなどのメッセージングアプリで採用されている。

クライアントサイドスキャニング(Client-Side Scanning)

メッセージが暗号化される前に、ユーザーのデバイス上でコンテンツをスキャンする技術である。エンドツーエンド暗号化を技術的には維持しながら、送信前の段階でコンテンツを検査できるため、暗号化とコンテンツ監視を両立させる手段として提案されているが、プライバシーの根本的な約束を破るとして批判されている。

ハッシュマッチング(Hash Matching)

画像や動画に固有のデジタル署名(ハッシュ値)を割り当て、既知の違法コンテンツのハッシュ値データベースと照合する技術である。GoogleやFacebookなどが既にCSAM検出に使用している。既知のコンテンツの検出には有効だが、新しいコンテンツは検出できない。

欧州議会(European Parliament)

EU市民によって直接選出される唯一のEU機関で、EU法の立法過程において欧州委員会、EU理事会とともに重要な役割を果たす。チャットコントロール提案に対しては、裁判所命令によってのみ通信スキャンを許可すべきだという立場を取り、暗号化通信の保護を支持している。

EU理事会(Council of the European Union)

加盟国の閣僚レベルの代表者で構成されるEUの意思決定機関である。2025年7月からはデンマークが議長国を務めている。チャットコントロール提案については加盟国間で意見が分かれており、ドイツなど複数の国が反対を表明している。

欧州基本権憲章(Charter of Fundamental Rights of the European Union)

EUにおける基本的人権を定めた憲章で、第7条でプライバシー権、第8条でデータ保護権、第11条で表現の自由を保障している。欧州司法裁判所は過去の判例で、一般的かつ無差別な監視はこれらの基本的人権と両立しないと判断してきた。

VPN(Virtual Private Network)

仮想プライベートネットワークの略で、インターネット接続を暗号化し、ユーザーの実際の位置や身元を隠す技術である。地理的な制限やコンテンツフィルタリングを回避するために使用され、イギリスのオンライン安全法下でも若者がアプリの年齢制限を回避する手段として利用されている。

【参考リンク】

Patrick Breyer 公式サイト(外部)

元欧州議会議員でデジタル権利活動家。チャットコントロール提案への反対活動と詳細な分析を提供している。

EU Tech Loop(外部)

2024年設立の独立系テクノロジー政策メディア。EUのデジタル政策に関する洞察と分析を提供。

Fight Chat Control(外部)

チャットコントロール提案に反対する市民運動の中心的なウェブサイト。提案の問題点と最新動向を掲載。

EFF – Client-Side Scanning(外部)

米国デジタル権利団体EFFによる、クライアントサイドスキャニングの技術的解説と問題点の分析。

Internet Society – Client-Side Scanning Factsheet(外部)

インターネット協会発行のクライアントサイドスキャニングに関するファクトシート。技術的仕組みを平易に解説。

European Parliament 公式サイト(外部)

欧州議会の公式サイト。チャットコントロール規制に関する公式文書や委員会の意見書を閲覧可能。

【参考記事】

Half-good new Danish Chat Control proposal(外部)

パトリック・ブライヤー氏によるデンマーク新提案の詳細分析。3つの未解決問題を指摘している。

Denmark is finally giving up on EU Chat Control after privacy backlash(外部)

デンマークが強制スキャン要件を取り下げた経緯と市民社会からの反対圧力について報じている。

Regulation to Prevent and Combat Child Sexual Abuse – Wikipedia(外部)

チャットコントロール提案の全体像を包括的に解説。2022年以降の立法プロセスを時系列でまとめている。

Patrick Breyer – Wikipedia(外部)

パトリック・ブライヤー氏の経歴と活動を紹介。データ保持に関する訴訟実績などを掲載。

Chat control: incompatible with fundamental rights(外部)

ドイツ市民権団体GFFによる、チャットコントロールと基本的人権の両立不可能性についての法的分析。

How we detect, remove and report child sexual abuse material – Google(外部)

Googleが実施しているCSAM検出の仕組みを公式説明。ハッシュマッチングとAIの組み合わせを解説。

Privacy vs. child protection: EU’s “chat control” plans split member states(外部)

加盟国間での意見の相違を報道。児童保護とプライバシー保護のバランスをめぐる議論を詳述。

【編集部後記】

児童性的虐待コンテンツは決して許されるものではありません。しかし「子どもを守る」という誰もが反対できない大義のもとで、私たち全員のプライバシーが奪われていく構図を見逃してはならないと考えています。歴史的に見ても、監視権限の拡大は常に崇高な理由から始まりますが、一度構築されたシステムは他の目的にも転用されてきました。今回のチャットコントロール提案は、EUだけの問題ではなく、日本を含む世界中のデジタル社会が直面する根本的な問いを投げかけています。安全のために自由を手放すことは、結局のところ自らの足を食べるようなものではないでしょうか。私たちと一緒に、この問題について考えていただければ幸いです。