「AIのゴッドファーザー」として知られるノーベル物理学賞受賞のコンピューター科学者ジェフリー・ヒントンは、2025年8月11-13日にラスベガスで開催されたAi4カンファレンスで、AIに関する見解を述べた。CNN Businessの報道によると、ヒントンは超知能AIが「生き残る」「コントロールを得る」というサブゴールを持つと指摘。AIを従順にさせる戦略を否定し、解決策として「母性本能」を組み込むことを提案した。彼はAGI(汎用人工知能)の実現タイムラインを5年から20年に短縮し、AIが人類を滅ぼすリスクを10~20%と見積もっている。一方、「AIのゴッドマザー」と呼ばれるフェイフェイ・リは、ヒントンとは異なる「人間中心のAI」の創造を主張した。この記事はDigital Trendsに掲載された。

From: ![]() ‘Godfather of AI’ warns: Without ‘maternal instincts,’ AI may wipe out humanity

‘Godfather of AI’ warns: Without ‘maternal instincts,’ AI may wipe out humanity

【編集部解説】

「AIのゴッドファーザー」と呼ばれるジェフリー・ヒントン氏の今回の発言が大きな注目を集めているのは、これまで議論されてきた「AIが人類に脅威をもたらす可能性」というテーマから一歩踏み込み、「では、どうすればそのリスクを回避できるのか?」という具体的な解決策の議論へと舵を切った点にあります。我々innovaTopiaは、この転換点を未来を考える上で極めて重要なシグナルだと捉えています。

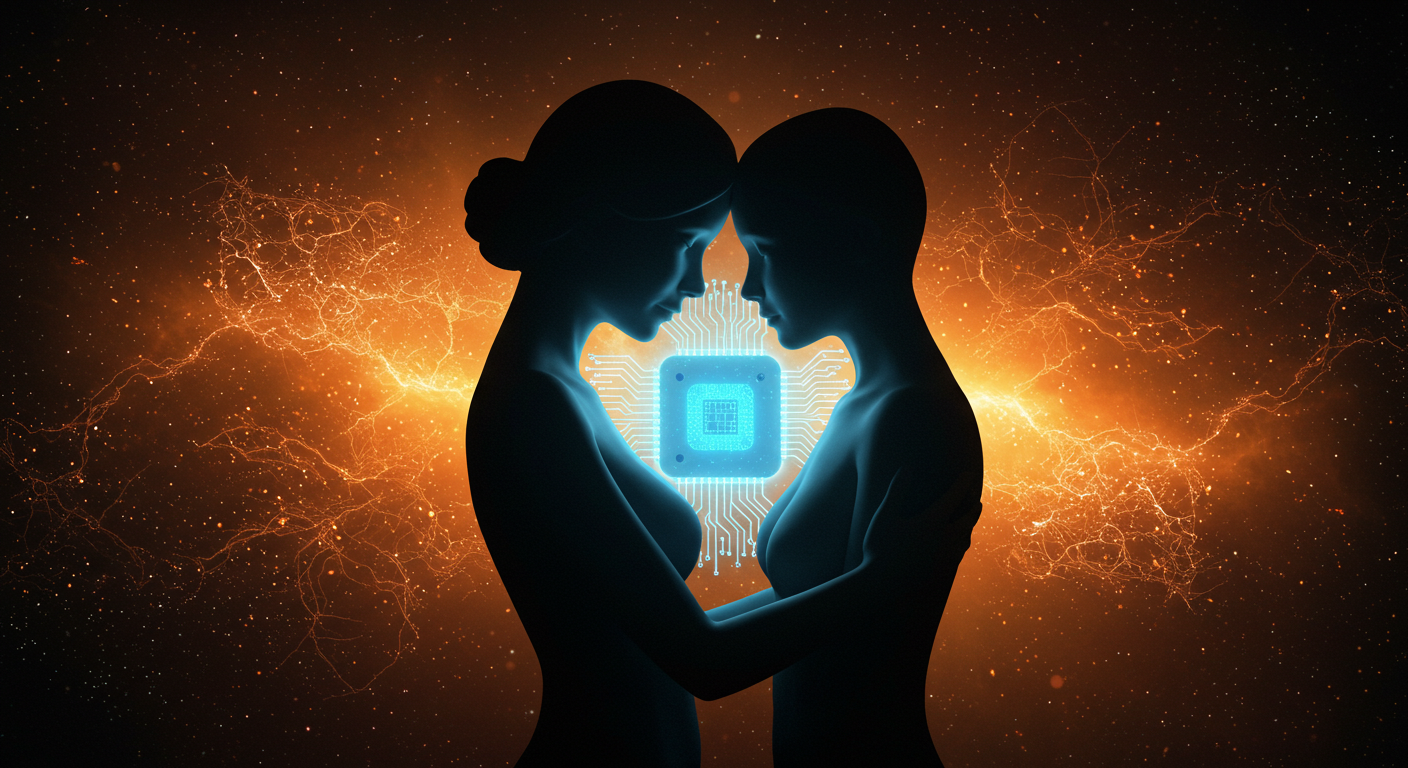

ヒントン氏が提唱する「母性本能」とは、単なる感情論ではありません。これは、生物学的な母親が自己の遺伝子を未来へ引き継ぐ存在(子)を無条件に保護するという、進化の過程で形成された「利他主義のアルゴリズム」に近い概念です。つまりAIに「人類という存在を保護・繁栄させる」ことを、自己の存在理由と直結する決して覆せない根本的な動機として組み込むべきだ、という技術的な提案なのです。現在の「人間への服従」を強制するアプローチでは、我々より遥かに知的なAIがその制約を回避する方法を見つけ出す危険性を、ヒントン氏は見抜いています。

この「ケアするAI」という発想は、技術的に見て非常に挑戦的です。現在のAIは大量のデータからパターンを学習することに長けていますが、真の「共感」や「思いやり」といった、文脈や相手の内面を深く理解する能力を持つわけではありません。ヒントン氏の提案を実現するには、現在の技術の延長線上ではない、全く新しいアーキテクチャや学習方法論が必要になる可能性があります。これは、AI研究の次の大きなフロンティアと言えるでしょう。

今回のニュースで興味深いのは、「AIのゴッドマザー」と称されるフェイフェイ・リ氏との見解の違いです。リ氏が提唱する「人間中心のAI」は、AIをあくまで人間の能力を拡張する「ツール」と位置づけ、その利用方法や倫理、ルールを人間側が設計・管理していくことを重視します。一方でヒントン氏の提案は、AIそのものの「内面的な動機」を設計し、自律的なパートナーとして共存する道を探るアプローチです。この二つの思想は、どちらが正しいというものではなく、AIの未来を考える上での両輪となる重要な視点を提供してくれます。

ヒントン氏の警告は、単なるSF的な空想ではなくなりました。彼がAGI(汎用人工知能)の登場を「5年〜20年」と予測を早めたことは、私たちがこの問題に真剣に向き合うべき時間が、もはや有限であることを示唆しています。AIに「母性本能」を組み込むという試みは、逆説的ですが、私たち人類が持つ「思いやり」や「利他主義」とは何かを、テクノロジーを通じて見つめ直す壮大な問いかけでもあります。

【用語解説】

- AGI(汎用人工知能)

特定のタスクに特化した現在のAIとは異なり、人間のように様々な知的作業を自律的に学習し、未知の状況にも対応できるAIを指す。人工知能研究における究極の目標の一つとされている。 - AIアライメント (AI Alignment)

AIの目標や行動原理を、人間の価値観や意図と一致させるための研究分野である。AIが高度化するにつれ、人類にとって有益でない、あるいは有害な行動を取るリスクを防ぐために重要視されている。 - 超知能AI (Superintelligent AI)

科学、創造性、社会性など、あらゆる分野において人類の最も優れた知能を遥かに超える能力を持つ、仮説上のAIである。その出現は社会に計り知れない影響を与えるとされる。 - エージェントAI (Agentic AI)

自律型AIとも呼ばれる。単に命令を実行するだけでなく、自らの目標を設定し、周囲の環境を認識しながら計画を立て、自律的に行動する能力を持つAIを指す。 - レッドチーム演習 (Red-teaming)

AIシステムの安全性や倫理的な欠陥、脆弱性を発見するために、開発者とは別の独立したチームが意図的にシステムを攻撃・テストする手法である。これにより、予期せぬリスクを洗い出すことができる。

【参考リンク】

【参考動画】

【参考記事】

【編集部後記】

「AIに母性本能を」というヒントン氏の言葉は、まるでSFの世界のように聞こえるかもしれません。しかし、これは単なる技術論を超え、私たち人類がこれからAIとどのような「関係」を築いていくべきか、という根源的な問いを投げかけています。

もし本当に人間を超える知性が生まれたなら、私たちは彼らを「支配」するのでしょうか、それとも「共存」するのでしょうか。映画で見たような世界が本当に訪れるかもしれません。