2025年3月に突如として発表され、新たな画像生成AIとして注目されている「HiDream-I1」。今回は、このHiDreamを「ComfyUI」で利用するための手順について解説します。

HiDreamとは?

「HiDream-I1」は、北京の「HiDream.ai」が開発し、香港の「VivagoAI」によって提供されている、高性能かつオープンウェイトの画像生成AIモデルです。2024年3月に発表されて以来、その卓越した画像生成能力と、ビジネス利用を強力にサポートする柔軟なライセンス体系で、画像生成AIの新たな潮流を築いています。特に、スモールビジネスにおけるデザインコストの削減や、個人クリエイターの表現力向上に貢献することを目指して設計されています。

HiDreamは、DiT(Diffusion Transformer)とMoE(Mixture-of-Experts)を組み合わせたハイブリッドモデルです。

DiTは、画像生成の安定性と品質を飛躍的に向上させるTransformerベースの拡散モデルで、Stable Diffusionなどの次世代モデルでも採用が進んでいます。そして、MoEとは、大規模なAIモデルを効率的に動かすための革新的な技術です。これは、特定のタスク(例えば、ある種類の画像生成)に特化した、「エキスパート」と呼ばれる複数の小さなAIを用意し、入力された情報に応じて最適なエキスパートを賢く選び、その部分だけを動かす仕組みです。

このDiTとMoEのハイブリッドアーキテクチャによって、HiDreamは170億パラメータという途方もない規模のモデルを、非常に効率的に制御しています。参考までに、多くの主要なStable Diffusionモデルが約10億~数10億パラメータ程度、比較的新しいFLUX.1でも約9億パラメータであることを考えると、HiDreamの170億パラメータという規模は、いかに膨大で、より詳細かつ複雑な表現を可能にする潜在力を持っているかがわかると思います。

加えて、HiDream-I1は、T5やLlamaなどのLLMを活用することで、日本語を含む多様な言語のプロンプトを非常に高度に理解します。これにより、単語の羅列ではない、より自然で複雑な文章による指示からも、ユーザーが意図する画像を正確に生成しやすくなっています。最も認識しやすいのは中国語プロンプトですが、英語・日本語でも遜色なく動作します。

また、MITライセンスの下で提供されており、個人利用だけでなく、商用利用、改変、再配布が自由に認められています。

※本記事の内容は2025年7月時点の情報です。大きな変更点は随時更新していきますが、モデルやUI、料金体系などはの詳細は必ず公式サイトや最新の情報も併せてご確認ください。

目次

はじめに

先述の通り、HiDreamは効率化の技術が用いられているとはいえ、170億という膨大なパラメータのため、これまで紹介してきたモデルよりもはるかに要求スペックが高くなっています。

FLUXのように完全版の「Full」開発用の「Dev」モデルと、軽量の「Fast」モデルが用意されています。ライセンスなどは全て同じなので、商用利用も改変も自由にすることができます。

「Fast」最低環境(ギリギリ動かせる)

| OS | Windows10 64bit |

| GPU | NVIDIA GeForce RTX 4060(VRAM 8GB) |

| 容量 | 30GB以上の空き SSD推奨 |

| CPU | Intel Core i5 第8世代 AMD Ryzen 5 2600 |

| メモリ | 16GB |

「Fast」推奨環境(快適に利用できる)

| OS | Windows11 64bit |

| GPU | NVIDIA GeForce RTX 4070(VRAM 12GB) |

| 容量 | 50GB以上の空き NVMe SSD推奨 |

| CPU | Intel Core i7 第10世代 AMD Ryzen 7 5800X |

| メモリ | 32GB |

「Dev」最低環境

| OS | Windows10 64bit |

| GPU | NVIDIA GeForce RTX 4070(VRAM 12GB) |

| 容量 | 50GB以上の空き SSD推奨 |

| CPU | Intel Core i7 第10世代 AMD Ryzen 7 3700X |

| メモリ | 32GB |

「Dev」推奨環境

| OS | Windows11 64bit |

| GPU | NVIDIA GeForce RTX 4080(VRAM 16GB) |

| 容量 | 100GB以上の空き NVMe SSD推奨 |

| CPU | Intel Core i9 第12世代 AMD Ryzen 9 7900X |

| メモリ | 64GB |

「Full」最低環境

| OS | Windows10 64bit |

| GPU | NVIDIA GeForce RTX 4070(VRAM 24GB) |

| 容量 | 100GB以上の空き SSD推奨 |

| CPU | Intel Core i9 第10世代 AMD Ryzen 9 5900X |

| メモリ | 64GB |

「Full」推奨環境

| OS | Windows11 64bit |

| GPU | NVIDIA GeForce RTX 5070 Ti(VRAM 32GB以上) |

| 容量 | 200GB以上の空き NVMe SSD必須 |

| CPU | Intel Core i9 第13世代 AMD Ryzen 9 7950X |

| メモリ | 128GB |

上の表はあくまで目安です。設定の最適化や、モデルなどによって必要なスペックは大きく変わります。最も重要なのは「NVIDIAのCUDA対応のGPUが搭載されていること」と「SSD」と「十分なメモリ」になります。

また、各モデルには、有志による「量子化モデル」が用意されており、多少手持ちのPCのスペックが低くても活用できる可能性はありますが、量子化モデルはどうしてもオリジナルに比べると品質が落ちてしまうのは覚悟しましょう。

また、推奨環境を満たせなくても、時間さえかければ生成できる場合もあります。1から描いたり、イラストレーターに依頼することを考えれば、1枚当たり数分かかってもかなり早い方ではありますが、生成AIという特性上、必ずしも思ったような構図やクオリティが一発で出るわけではないので、この繰り返しになると、PCに掛かる負荷や、時間がストレスの蓄積になるでしょう。

導入方法

HiDreamはComfyUIでの利用が推奨されています。ComfyUIの導入方法や使い方に関しては以下の記事で解説しています。

ComfyUIの導入に「Stability Matrix」を利用する場合は以下の記事にて解説しています。

ComfyUIはStable Diffusion、FLUX、HiDreamのすべてを利用できる汎用性の非常に高いツールですので、是非とも活用しましょう。

導入方法も、最も簡単な方法を紹介します。過去の記事で紹介した各ファイルの保存場所などを把握していることが前提になりますのでご注意ください。

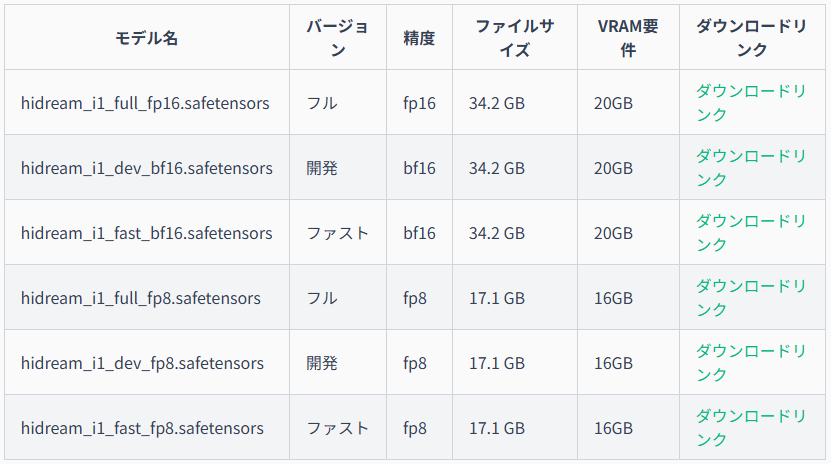

まずはComfyUIの開発者向けWikiにアクセスして、ほしいモデルをインストールします。

手動モデルダウンロード|ComfyUI Wiki(外部サイト)

ご覧の通りですが、モデルだけでもかなり容量が大きいので、ダウンロードにはかなり時間がかかります。

fp8とは軽量化モデルです。余裕があれば複数のモデルをダウンロードして比較してみるのもいいかもしれません。

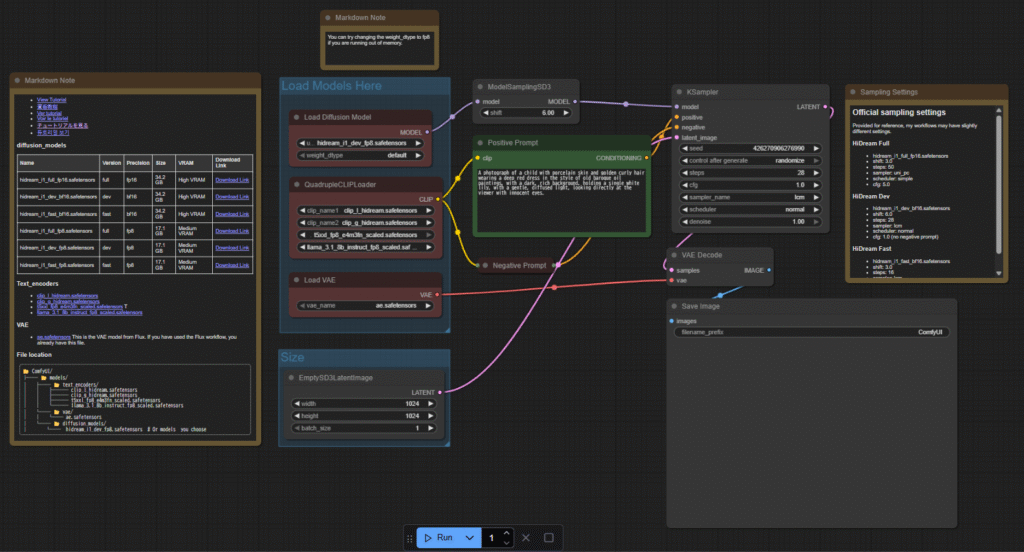

ダウンロード中に次の準備をしてしましましょう。モデルのリストの上にスクロールすると、サンプル画像が貼られています。これを右クリックして保存し、ComfyUI上にドラック&ドロップすると、画像のメタデータとして保存されているワークフローが読み込まれます。

この画像は「dev_fp8」が使用されているため、これや他のテキストエンコーダー、VAEなどが不足している場合はダイアログが出てきますので、モデル以外は全てダウンロードし、モデル自体は不要なら無視して閉じてしまいましょう。

各黄色のノードにマニュアルが一緒に書かれていますので、迷ったらこれらを見て解決できるかと思います。

HiDream特有の仕様としては、「QuadrapleCLIPLoader」を使用していることです。Llama、T5を含む4つのテキストエンコーダーを通すことで、プロンプトの理解度が大きく向上しています。

また、上記のWikiでは拡張子が.ggufとなっている量子化モデルの利用方法も解説されています。これは公式のモデルではなく、city96氏によって製作されたものです。

使い方は基本的に同じなのですが、拡張子が違うため、モデルを読み込むためのノードとして別のものを使う必要があります。

GGUF バージョン ワークフロー|ComfyUI Wiki(外部サイト)

Hagging Faceのページや、ワークフローが保存されたサンプル画像などが掲載されています。

HiDream-I1-Fast-gguf|Hagging Face(外部サイト)

HiDream-I1-Dev-gguf|Hagging Face(外部サイト)

HiDream-I1-Full-gguf|Hagging Face(外部サイト)

Q2~8と数字が降られていますが、数字が小さいほど軽量化が施されています。

利用方法

画面下部にある「Run(実行)」をクリックすれば画像の生成が始まります。押せば押した分だけ次の生成を予約することができ、順番に処理されていきます。

また、HiDreamは3つのモデル毎に推奨設定があります。サンプル画像からワークフローを読み込んだ場合は、一番右側のノードに記載されていますので、基本的にはこれに従いましょう。

HiDream Fast

- hidream_i1_fast_bf16.safetensors

- shift: 3.0

- steps: 16

- sampler: lcm

- scheduler: normal

- cfg: 1.0 (no negative prompt)

HiDream Dev

- hidream_i1_dev_bf16.safetensors

- shift: 6.0

- steps: 28

- sampler: lcm

- scheduler: normal

- cfg: 1.0 (no negative prompt)

HiDream Full

- hidream_i1_full_fp16.safetensors

- shift: 3.0

- steps: 50

- sampler: uni_pc

- scheduler: simple

- cfg: 5.0

すると、「shift」というあまり見慣れないステータスがあるかと思います。(「Model Sampling SD3」というノードですが、Stable Diffusionとは無関係です。)

この数字は「学習内容の平均値からどれだけずらすか」というステータスです。下げるほど、人物の正面や、棒立ちのような平凡で安定した出力になり、上げるほど独特なポーズや動きのあるポーズが出やすい分、プロンプトへの忠誠度は下がり、破綻の確率が上がることを示しています。

これを利用して、プロンプトとシード値を固定して、このshiftの数値を少しずつ上げていくと、アニメーションのように棒立ちから動きのある構図へと変化していくのが確認できるかと思います。

これはそのまま動画のようにつなげられるわけではありませんが、プロンプトがしっかりと反映されているかの確認などにも役立ちます。

出力したい構図などに合わせて、数値を変えるとより細やかなコントロールができるようになるステータスなので、上手く活用していきましょう。

また、サンプル画像ではネガティブプロンプトを記載するノードはなく、固定のフレーズが読み込まれています。

FLUXと共通するところではありますが、Stable Diffusionの学習データよりも、紐づけられたアノテーションが詳細に埋め込まれているため、ネガティブプロンプトは基本的に必要ありません。

Stable Diffusionが入力されたプロンプトから、頻出する概念を勝手に引っ張ってきてしまう現象(例えば、学生服(school uniform)と入力しただけで、背景のほとんどが教室風になるといったこと)が解消されているということなので、指示されていないことは出にくいことを示しています。

システム的に使えないというわけではないので、どうしてもネガティブプロンプトを設定したいときは、ノードを新たに追加して繋ぎなおせばいいだけです。

よくある症状と対処方法

ComfyUIが起動しない

Stability Matrix側のログに「error while attempting to bind on address (‘127.0.0.1’, 8188): 通常、各ソケット アドレスに対してプロトコル、ネットワーク アドレス、またはポートのどれか 1 つのみを使用できます。」と出ていませんか?これは8188のポートが何かに使われていて、使用できなかった時に表示されるエラーです。大半は、閉じたつもりのComfyUIがまだ動き続けてしまっていることが原因です。

コマンドプロンプトを起動し、

netstat -ano | findstr :8188

と入力してみてください。(ポート番号は人によって違う場合がありますので、エラーログをよく確認しましょう)

そうすると、該当のポート番号が何に使われているかが出てきます。

(例)TCP 127.0.0.1:8188 0.0.0.0:0 LISTENING 12345

そうしたら、コマンドプロンプトで以下のコマンドを実行し、ポートを使用しているプログラムを強制的に終了させます。

taskkill /PID 12345 /F

これで改善します。

ComfyUIが動かなくなった

Stability Matrixのほうを確認してみましょう。こちらでComfyUIが止まってしまっていることがたまにあります。その場合は起動しなおしてみましょう。

インストールしたモデルが見つからない

起動中にインストールしたものを表示するにはブラウザを更新をする必要があります。この更新でStability Matrix上でComfyUIが止まってしまう可能性もあるので、併せて確認しましょう。

最後に

今回は「ComfyUI」を使って「HiDream-I1」をローカルで運用する方法を紹介してきました。

HiDreamはリリースからの日が非常に浅く、元のモデルの容量が膨大であるために、まだコミュニティによる研究・開発が進んでいないのが現状です。

また、成人向けの表現が非常に出にくいことが知られています。純粋に学習したデータセットから徹底して性的な画像が排除されている可能性、テキストエンコーダーが性的なワードを弾いたり、重みが軽く設定されている可能性など、複数の技術によって強固に防がれているのではないかと考察が飛び交っています。

Stable Diffusionの性的コンテンツの規制を受けて代替を探しているユーザーには現状として不適切ではありますが、そうでない場合には、安心材料とも言えます。

AIによる画像生成は意図せず第三者の著作権・肖像権・商標権などを侵害するリスクもあります。また、モデルデータや追加学習データによっては商用利用を禁止していたり、商用利用以外でも公開の際にクレジット表記が求められる場合もありますので、公開・商用利用の際は、各モデルの利用規約や関連する法律を必ず確認してください。