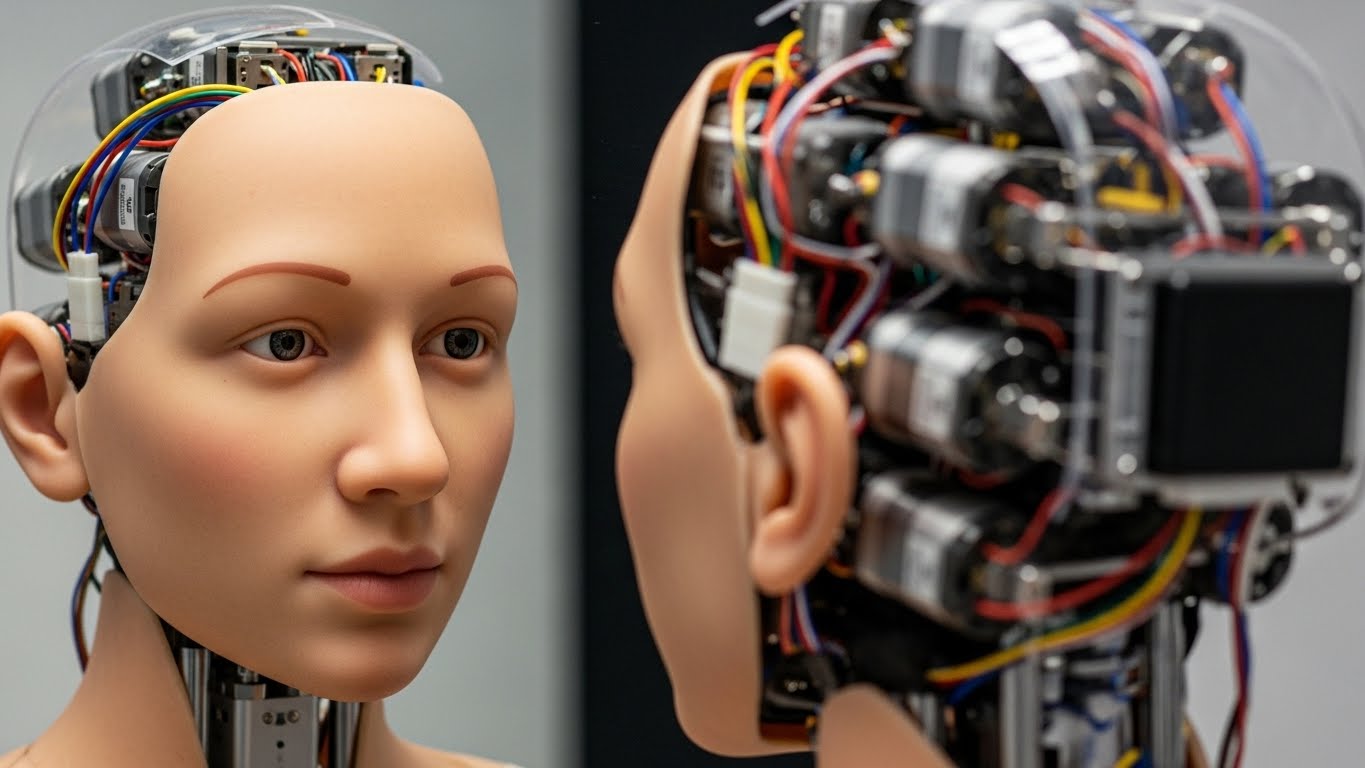

コロンビア大学工学部の研究チームが、観察を通じて唇の動きを学習できるヒューマノイドロボットを開発し、2026年1月14日に発表した。

研究成果はScience Robotics誌11巻110号に掲載された。このロボットは26個の顔面モーターを搭載し、鏡で自分の表情を観察しながら数千の顔の動きを実験した後、YouTubeの人間の会話や歌唱動画を学習することで、音声に同期した唇の動きを習得した。

研究を主導したユハン・フー氏とホッド・リプソン教授は、ChatGPTやGeminiなどの会話型AIと組み合わせることでより深いコミュニケーションが可能になると説明している。

一部の経済学者は今後25年間で10億台以上のヒューマノイドロボットが生産される可能性があると推定しており、研究チームはこの技術が「不気味の谷」を越える鍵になると考えている。

From: ![]() The breakthrough that makes robot faces feel less creepy

The breakthrough that makes robot faces feel less creepy

【編集部解説】

コロンビア大学が発表したこのロボット技術は、ヒューマノイドロボット開発における長年の課題に正面から取り組んだ成果です。

人間は対面コミュニケーションにおいて、注意の約半分を相手の唇の動きに向けています。しかし、従来のロボットは口の動きが硬直的で、せいぜい人形劇のパペットのような動きしかできませんでした。歩行のぎこちなさや手の動きの不自然さは許容されても、顔の表情、特に唇の動きのわずかなミスは即座に違和感として認識されてしまいます。

これが「不気味の谷」と呼ばれる現象の核心です。1970年に日本のロボット工学者、森政弘氏が提唱したこの概念は、ロボットが人間に似れば似るほど親近感が増すものの、ある段階で急激に嫌悪感や不気味さを引き起こすという心理現象を指します。そして、完全に人間と見分けがつかなくなると再び好感度が上昇するという曲線を描きます。

今回開発されたロボットは、26個の顔面モーターを搭載し、柔軟なシリコン製の皮膚を持っています。最大の特徴は、事前にプログラムされたルールに従うのではなく、観察を通じて学習する点にあります。

学習プロセスは2段階に分かれています。第一段階では、ロボットは鏡の前に置かれ、数千の無作為な表情を試しながら、どのモーターの組み合わせがどのような顔の形を生み出すかを学習します。まるで赤ちゃんが鏡の中の自分を発見し、表情を試すような過程です。

第二段階では、YouTubeにアップロードされた人間の会話や歌唱動画を何時間も観察し、音声の変化と口の形状の関係を理解します。この「視覚から行動へ」の言語モデル(VLA)により、ロボットは音声信号を受け取ると、それに同期した唇の動きを生成できるようになりました。

研究チームは複数の言語や歌唱での実験を行い、音声の意味を理解していなくても、聞いた音に合わせて唇を動かせることを実証しました。ただし、完璧ではありません。「B」のような破裂音や「W」のような唇をすぼめる音には特に苦労したと研究を主導したリプソン教授は認めています。

この技術の真価は、ChatGPTやGeminiなどの会話型AIと組み合わせた時に発揮されます。リアルタイムで会話しながら、その内容に応じた表情や唇の動きを生成できれば、人間とロボットの間のコミュニケーションは劇的に深まります。フー氏は「会話の文脈が長くなればなるほど、ジェスチャーはより文脈に敏感になる」と説明しています。

市場の観点から見ると、この技術の重要性はさらに明確になります。ヒューマノイドロボット市場は急速な拡大が予測されており、調査会社によって数値は異なるものの、2030年までに数十億ドルから百億ドル規模に成長すると見られています。さらにモルガンスタンレーは2050年までに市場規模が5兆ドルに達し、約10億台のヒューマノイドロボットが稼働すると予測しています。

これらのロボットが活躍する分野は、エンターテインメント、教育、医療、高齢者介護など多岐にわたります。特に高齢化が進む先進国では、介護ロボットへの需要が高まっています。しかし、もしロボットが不気味な印象を与え続けるなら、人々はその存在を受け入れられません。

プロジェクトリーダーのホッド・リプソン教授は、ロボット工学の現状について興味深い指摘をしています。「現在のヒューマノイドロボット研究の多くは、歩行や物を掴むといった脚と手の動きに焦点を当てています。しかし、人間との相互作用を含むあらゆるロボットアプリケーションにとって、顔の愛情表現は同様に重要です」。

リプソン教授は、この研究が過去10年間にわたる取り組みの一環であることも明かしています。彼は、ロボットが笑顔やアイコンタクト、会話などの顔の行動を硬直したプログラムではなく、観察を通じて学習する必要があると主張してきました。「ロボットが人間を見たり聞いたりするだけで笑顔や話し言葉を学ぶとき、何か魔法のようなことが起こります」と彼は語ります。

興味深いのは、リプソン教授が倫理的な側面にも配慮している点です。別の報道によると、彼はロボットが人間と誤認されないよう、意図的に青い肌にするなど、明確に区別できるデザインにすべきだと提案しています。感情的に人間と関わることができる機械を作ることには、大きな責任が伴うという認識です。「これは強力な技術になります。リスクを最小限に抑えながら利益を享受できるよう、ゆっくりと慎重に進まなければなりません」とリプソン教授は警告しています。

この研究成果は、Science Robotics誌の表紙を飾り、学術界でも高い評価を受けています。技術的な完成度よりも重要なのは、このアプローチが示す方向性です。機械学習とロボット工学の融合により、ロボットは人間のように観察し、試行錯誤しながら学習できるようになりました。

今後、この技術がさらに進化すれば、ロボットはより複雑な表情や、微妙なニュアンスを含む感情表現も学習できるようになるでしょう。不気味の谷を越える日は、そう遠くないかもしれません。

【用語解説】

不気味の谷(Uncanny Valley)

1970年に日本のロボット工学者・森政弘氏が提唱した概念。ロボットや人工物が人間に似れば似るほど親近感が増すが、ある段階(人間にかなり近いが完全ではない段階)で急激に嫌悪感や不気味さを感じるようになる現象を指す。グラフ上で好感度が谷のように急降下することから「谷」と名付けられた。完全に人間と見分けがつかなくなると再び好感度は上昇する。

VLA(Vision-to-Action Language Model / 視覚から行動への言語モデル)

視覚情報を行動に変換するAIモデル。本研究では、ロボットが鏡で自分の表情を観察し、どのモーター動作がどのような視覚的な顔の形状を生成するかを学習するために使用された。視覚的なフィードバックと物理的な動作を結びつける学習手法である。

ヒューマノイドロボット

人間の姿や動作を模倣したロボット。頭部、胴体、腕、脚などの人間的な身体構造を持ち、人間が設計した環境で活動できるよう設計されている。製造業、介護、エンターテインメント、教育など幅広い分野での活用が期待されている。

Science Robotics

米国科学振興協会(AAAS)が発行する査読付き学術誌。ロボット工学に関する最先端の研究成果を掲載し、2016年に創刊された。今回の研究は2026年1月発行の11巻110号に掲載された。

【参考リンク】

Columbia Creative Machines Lab(外部)

コロンビア大学のホッド・リプソン教授が率いる研究室。創造する機械、創造的な機械を開発する研究を行っている

Science Robotics – 論文ページ(外部)

今回の研究成果が掲載された学術論文。タイトルは「Learning realistic lip motions for humanoid face robots」

コロンビア大学工学部 – ホッド・リプソン教授(外部)

機械工学・データサイエンス教授。進化ロボット工学、デジタル製造、人工生命などの研究を行う

【参考動画】

【参考記事】

A Robot Learns to Lip Sync | Columbia Engineering(外部)

コロンビア大学工学部の公式発表。26個の顔面モーターを搭載したロボットが鏡での自己観察とYouTube動画の学習により唇の動きを習得したプロセスを詳述

Robot learns to lip sync by watching YouTube(外部)

ロボットの学習プロセスを技術的な視点から解説。VLAモデルと人間の動画観察を組み合わせた手法について詳しく報じている

Lip-syncing robot watches your face to speak like you(外部)

ロボットの仕組みと26個の小型モーターが柔軟なシリコン皮膚の下でどのように連動するかを解説している

Humanoid Robot Market Size, 2024 to 2030(外部)

ヒューマノイドロボット市場が2030年までに65億ドル規模に成長するとの予測。2027年に11.5万台の出荷が見込まれる

The global market for humanoid robots could reach $38 billion by 2035(外部)

ゴールドマンサックスによる市場予測。2035年までに市場規模が380億ドルに達し2030年に25万台以上が出荷されると分析

Humanoid Robot Market Expected to Reach $5 Trillion by 2050(外部)

モルガンスタンレーの長期予測。2050年までに市場規模が5兆ドルに達し約10億台のヒューマノイドロボットが稼働すると予測

【編集部後記】

私たちが日々目にするロボットの姿は、この10年で劇的に変化してきました。工場の生産ラインで黙々と働く機械から、人間と同じ空間で共存するパートナーへ。そして今、その「共存」の質が問われる転換点に立っています。

今回ご紹介したコロンビア大学の研究は、単なる技術的進歩以上の意味を持っています。それは、私たちが無意識のうちに相手の唇の動きから多くの情報を読み取っているという、人間の本質的なコミュニケーション様式に真正面から向き合った成果だからです。

近い将来、介護施設で高齢者に寄り添うロボット、病院で患者を励ますロボット、あるいは教室で子どもたちと対話するロボットが登場するでしょう。そのとき、その顔が不気味でなく、むしろ安心感を与えるものであれば、ロボットと人間の関係は根本から変わるかもしれません。

みなさんは、どんな表情のロボットなら心を開けると感じますか? そして、感情を持たない機械が人間らしく振る舞うことに、どのような可能性と懸念を感じるでしょうか? この問いは、これからの社会を考える上で避けて通れないものになっていくはずです。