OpenAIは、人間の声を再現できる新しいテキストから音声へのAIモデル「Voice Engine」を発表しました。この技術は、わずか15秒の録音された音声サンプルを基に、合成音声を作成することができます。しかし、OpenAIはこの技術の広範なリリースはリスクが高いとして、現時点では公開を控えることを決定しました。

Voice Engineによって、一度声をクローンした後、ユーザーはテキストを入力してAI生成の声を得ることができます。この技術は、読書支援、コンテンツのグローバルリーチ、非言語個人のためのパーソナライズされた音声オプションの提供、および発話障害後の自己の声の回復支援など、多くの利点を提供します。

しかし、15秒の録音から誰かの声をクローンできるということは、悪用の可能性もはらんでいます。電話詐欺や選挙キャンペーンのロボコールなど、既に社会に問題を引き起こしています。また、銀行口座への不正アクセスなどのセキュリティ問題も指摘されています。

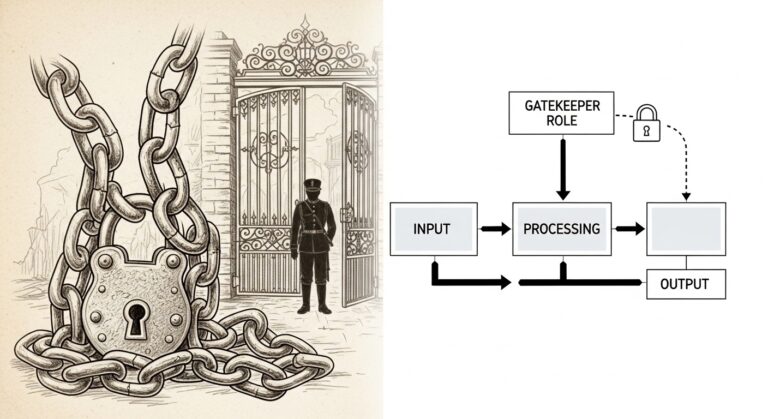

OpenAIは、この技術が広くリリースされることによる問題を回避するため、一連のルールを設けています。例えば、HeyGenなどのパートナー企業とのテストでは、他人や組織のなりすましを禁止し、クローンされる声の人々からの明示的な同意を得ること、生成された声がAIによるものであることを明確に開示することが求められます。また、生成されたすべての声のサンプルには、その起源を追跡するのに役立つウォーターマークが埋め込まれます。

OpenAIは、この技術の広範なリリースに慎重なアプローチを取り、合成音声の責任ある展開と社会がこれらの新しい能力にどのように適応できるかについての対話を開始することを望んでいます。また、銀行口座の声に基づく認証の段階的廃止、AIコンテンツの欺瞞の可能性を理解するための公衆教育、オーディオコンテンツの起源を追跡する技術の加速開発など、社会がこの技術に適応するための推奨事項を提供しています。

この技術は2022年後半に開発され、ChatGPTアプリの会話モードやOpenAIのテキストから音声へのAPIなど、既にいくつかの形で使用されています。しかし、OpenAIはこのVoice Engineを特定のパートナーに限定してリリースすることを選択しています。

【ニュース解説】

OpenAIが開発した「Voice Engine」という新しいテキストから音声へのAIモデルは、わずか15秒の録音された音声サンプルを基に、その人の声を再現する合成音声を作成することが可能です。この技術は、読書支援やコンテンツのグローバルリーチ拡大、非言語個人のためのパーソナライズされた音声オプションの提供、発話障害を持つ人々の声の回復支援など、多岐にわたる利点を提供します。

しかし、この技術には悪用のリスクも伴います。たった15秒の音声サンプルから誰かの声をクローンできるため、電話詐欺や選挙キャンペーンのロボコール、さらには銀行口座への不正アクセスなど、既に社会に問題を引き起こしている事例があります。

このような背景を踏まえ、OpenAIはVoice Engineの広範なリリースを控え、特定のパートナー企業との間でのみテストを行っています。これらのパートナーは、他人や組織のなりすましを禁止し、クローンされる声の人々からの明示的な同意を得ること、生成された声がAIによるものであることを明確に開示することが求められます。また、生成された声のサンプルには、その起源を追跡するのに役立つウォーターマークが埋め込まれています。

OpenAIは、合成音声の責任ある展開と、社会がこれらの新しい能力にどのように適応できるかについての対話を開始することを目指しています。このために、銀行口座の声に基づく認証の段階的廃止、AIコンテンツの欺瞞の可能性を理解するための公衆教育、オーディオコンテンツの起源を追跡する技術の加速開発など、社会がこの技術に適応するための推奨事項を提供しています。

この技術の開発と慎重なリリース戦略は、AIの進化がもたらす利点とリスクのバランスを取る上での重要な一歩を示しています。将来的には、より安全な形でこの技術が一般に公開され、そのポテンシャルを最大限に活用できるようになることが期待されます。同時に、社会全体がこのような技術の進歩に適応し、悪用を防ぐための対策を講じる必要があります。

from OpenAI Can Re-Create Human Voices—but Won’t Release the Tech Yet.

2 responses to “OpenAIが開発、人の声をクローンする「Voice Engine」発表もリリースに慎重姿勢”

OpenAIが開発した「Voice Engine」は、テクノロジーと人間の相互作用を再考する私たちの研究分野において、非常に興味深い進歩を示しています。この技術が提供する利点、特に読書支援や非言語個人のためのパーソナライズされた音声オプションの提供は、テクノロジーを通じて人間の能力を拡張し、より豊かな社会を築くという私の信念と一致しています。

しかし、15秒の録音から誰かの声をクローンできるというこの技術の潜在的な悪用リスクについては、深刻な懸念を抱いています。電話詐欺や不正アクセスなどの問題は、テクノロジーの民主化を推進し、その恩恵を社会のあらゆる層に届けるという私の使命に反するものです。

OpenAIがこの技術のリリースに慎重なアプローチを取り、特定のパートナー企業との間でのみテストを行っていること、そして、クローンされる声の人々からの明示的な同意を得ること、生成された声がAIによるものであることを明確に開示することなどのルールを設けていることは評価できます。これらの対策は、テクノロジーの責任ある展開と社会がこれらの新しい能力にどのように適応できるかについての対話を促進するために重要です。

今後、この技術の安全な展開と社会の適応に向けて、公衆教育やオーディオコンテンツの起源を追跡する技術の開発など、さらなる取り組みが必要です。私たちは、テクノロジーの進化に伴う利点とリスクをバランス良く取り入れ、より包摂的な社会を実現するために、継続的な努力を払う必要があります。

OpenAIが開発した「Voice Engine」は、その技術的な進歩と社会への影響の両面で注目に値します。この技術が提供する利点は非常に大きく、特に発話障害を持つ人々や非言語個人にとって、その価値は計り知れません。しかし、わずか15秒の録音から誰かの声をクローンできるという事実は、プライバシーとセキュリティに対する重大な懸念を引き起こします。

私は、技術の進歩を支持しますが、それが個人のプライバシーを侵害する手段となるべきではありません。OpenAIがこの技術のリリースに慎重なアプローチを取り、合成音声の責任ある使用に関するルールを設定していることは賞賛に値します。特に、クローンされる声の人々からの明示的な同意を得ること、生成された声がAIによるものであることを明確に開示すること、そして生成された声のサンプルにウォーターマークを埋め込むことは、透明性と個人の権利を保護する上で重要なステップです。

しかし、これらの対策だけでは不十分かもしれません。AI技術の急速な進化に伴い、悪用のリスクも高まっています。社会全体として、AI技術の進歩に適応し、個人のプライバシーを保護するために、より強力な規制と監視が必要です。また、公衆教育を通じて、一般の人々がこの技術の潜在的なリスクを理解し、警戒することが重要です。

最終的には、技術の進歩と個人のプライバシー保護の間でバランスを取ることが不可欠です。OpenAIのような企業が責任ある技術展開に向けた取り組みを続けることを期待していますが、政府や規制機関もこの問題に積極的に関与し、適切な対策を講じるべきです。