米国のCISA、FBI、NSA Artificial Intelligence Security Center、オーストラリアSignals DirectorateのAustralian Cyber Security Centre、Canadian Centre for Cyber Security、German Federal Office for Information Security、Netherlands National Cyber Security Centre、New Zealand National Cyber Security Centre、UK National Cyber Security Centreが、運用技術(OT)環境におけるAI導入に関する25ページの共同ガイダンスを公表した。

大規模言語モデル(LLM)などAIは効率化や意思決定に利用できる一方、OTプロセスモデルの経時的ドリフトや安全プロセスのバイパスといったリスクを伴うと説明している。

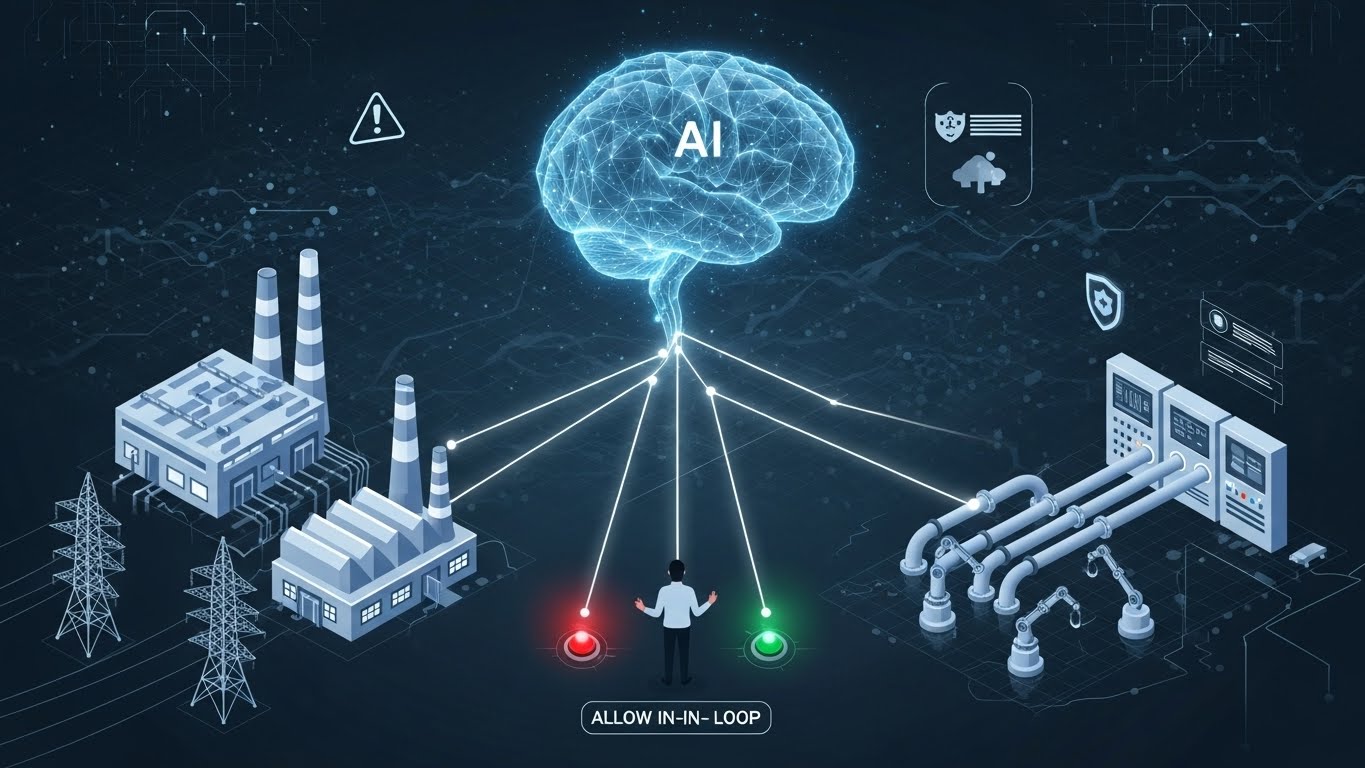

ガイダンスは、OTにおけるAI利活用の理解、ガバナンスと保証フレームワークの確立、OT-AI統合への安全・セキュリティ実装、人間関与型の監視やフェイルセーフなどを推奨している。

FortinetのRichard Springerは、OTではセグメンテーションや資産可視化など基礎的サイバーセキュリティが中心でGenAI導入は限定的と述べている。

DarktraceのNathaniel Jonesは、LLMが安全限界と整合しない推奨を行うリスクや、OTにおける高リスク技術として明示された点を指摘している。

From: ![]() CISA Publishes Security Guidance for Using AI in OT

CISA Publishes Security Guidance for Using AI in OT

【編集部解説】

OT環境にAIを入れていく流れは、すでに「やる/やらない」の議論ではなく、「どう安全に実装するか」というフェーズに入っています。今回CISAや各国NCSCがそろってガイドラインを出したのは、AIが電力・水道・製造・防衛などのOTシステムに直接影響し始めたタイミングで、世界的に「安全側へ舵を切る」合図とも言えます。

OTの特徴は、一度止まると人命や社会インフラに即ダメージが出ることです。そこで今回の文書は「AIで高度な異常検知や最適化をしつつも、人間の判断とフェイルセーフを前提とすること」「LLMは特に高リスクなので、行動分析や異常検知にそのまま使うのは誤りになり得ること」を、かなりはっきり打ち出しています。NERC CIP-015のように行動分析を求める規格が増える中で、「LLMを入れればいい」という安易な発想にブレーキをかけた点は重要です。

技術的にポイントになるのは、「モデルの経時的ドリフト」と「確率的AIと決定論的OTの衝突」です。運転条件や負荷プロファイルが変わると、学習時とは違う前提でAIが推奨を出し始め、安全マージンから外れた制御を提案する可能性があります。Darktraceの指摘の通り、OTは本来きわめて決定論的な世界なので、確率的な出力をそのまま制御に使う設計は、根本的に見直す必要があります。

運用面では、「まずAIありきではなく、本当にOTのビジネスケースとして必要なのかを問い直せ」としているのも実務的です。多くの事業者がまだセグメンテーションや資産管理すら道半ばである中、GenAIを中枢に据えるのではなく、プレイブック自動化や予知保全支援など、間接的な活用から入るべきだというトーンが読み取れます。このスタンスは、国内で議論されているOTセキュリティガイドラインや制御系CSのベストプラクティスとも大きく矛盾しません。

規制・標準化という観点では、今回の文書は「AI in OT」がもはや各社のローカルな実験ではなく、電力・製造・水道などセクター横断の「システミックリスク」として扱われ始めたことを示しています。今後、エネルギーや製造分野の事業者に対して、AI利用ポリシーやガバナンス、モデル評価プロセスを文書化することが、監督当局や顧客から半ば当然の要件として求められていく可能性が高いです。

ポジティブな側面としては、OTにAIを入れることで、従来は人の勘と経験に依存していた異常の早期検知や予知保全、複雑なアラートのトリアージなどが、より高精度かつ高速に行えるようになる余地があります。一方で、その恩恵を享受するためには、「どこまでをAIに任せ、どこから先は人間の責任領域とするか」をシステム設計と運用手順の両面でクリアに線引きすることが不可欠です。今回のガイドラインは、その線引きと前提条件を国際的に揃えるための、最初の基準点になっていくはずです。

【用語解説】

大規模言語モデル(LLM)

大量のテキストデータから学習し、人間の文章に近い応答や要約、翻訳などを生成するAIモデルの総称である。

OT(Operational Technology)

工場設備や発電所、上下水道などの物理プロセスを監視・制御するための技術やシステムの総称である。

SCADA(Supervisory Control and Data Acquisition)

産業プラントやインフラ設備を遠隔監視・制御するためのシステムで、センサーデータ収集と制御指令の送出を行う。

リモートコード実行(RCE)

攻撃者が遠隔から任意のコードを実行できてしまう脆弱性・攻撃手法のことで、システム乗っ取りにつながる危険がある。

モデルドリフト(経時的ドリフト)

運用環境や入力データの変化により、時間の経過とともにAIモデルの出力が学習時の前提からずれていく現象である。

人間-in-the-loop(ヒューマン・イン・ザ・ループ)

AIが自動で意思決定するのではなく、重要な局面で人間が確認・承認するプロセスを組み込んだ運用形態を指す。

フェイルセーフ

システムに障害や誤作動が発生しても、安全側に倒れるように設計し、被害を最小限に抑える設計思想である。

行動分析・異常検知

通常時の振る舞いパターンを学習し、そこから外れた挙動を検知するセキュリティ技術で、OTや重要インフラの監視に用いられる。

【参考リンク】

CISA(Cybersecurity and Infrastructure Security Agency)(外部)

米国国土安全保障省の機関で、重要インフラと政府機関のサイバーセキュリティおよび物理的セキュリティの向上を担う。

FBI(Federal Bureau of Investigation)(外部)

米国司法省の捜査機関で、サイバー犯罪を含む連邦犯罪の捜査と情報収集を行う。

NSA Artificial Intelligence Security Center(外部)

米国家安全保障局(NSA)の一部で、AIセキュリティに焦点を当てたセンターとして、AIの安全な利用と防御に関する取り組みを行う。

Australian Cyber Security Centre(ACSC)(外部)

オーストラリア政府のサイバーセキュリティ機関で、官民向けに脅威情報やガイダンスを提供する。

Canadian Centre for Cyber Security(外部)

カナダ政府のサイバーセキュリティ専門機関で、インシデント対応やベストプラクティスの公開を行う。

German Federal Office for Information Security(BSI)(外部)

ドイツ連邦情報セキュリティ庁で、国家レベルのITセキュリティ基準策定や脅威分析を担当する。

Netherlands National Cyber Security Centre(NCSC-NL)(外部)

オランダ政府のNCSCで、公共部門と重要インフラ事業者向けにセキュリティ情報とガイドラインを提供する。

New Zealand National Cyber Security Centre(外部)

ニュージーランド政府のサイバーセキュリティセンターで、重要組織向けのインシデント対応支援やアドバイスを担う。

UK National Cyber Security Centre(NCSC)(外部)

英国GCHQの一部門で、政府・企業・国民に向けたサイバーセキュリティガイダンスやインシデント対応を提供する。

Darktrace(外部)

AIを活用したサイバー防御製品を提供する企業で、OTやクラウドなど多様な環境向けに異常検知ソリューションを展開している。

Fortinet(外部)

ファイアウォールやOT向けセキュリティ製品などを提供するグローバルセキュリティベンダーである。

Nozomi Networks(外部)

OTおよびIoT向けの可視化と脅威検知ソリューションを提供するセキュリティ企業である。

NERC CIP-015(外部)

北米電力信頼性評議会(NERC)の重要インフラ保護基準の一つで、行動分析や異常検知などを含むセキュリティ要件を規定する。

IPA 制御システムセキュリティ(外部)

日本の独立行政法人情報処理推進機構による制御システムセキュリティ情報サイトで、OT・ICSのリスクと対策をまとめている。

【参考記事】

Joint Guidance: Principles for the Secure Integration of Artificial Intelligence in Operational Technology(外部)

CISAや各国サイバー機関が発表した公式ガイダンス本文で、OTにおけるAI利用ケース、リスク、ガバナンス、テスト、監視・フェイルセーフなどの具体的原則を詳細に示している。

NERC CIP-015 Standard Document(外部)

電力セクター向けに行動分析や異常検知を含むサイバーセキュリティ要件を定めた標準であり、OTにおけるAI利用とLLMの適否に関する議論の前提となっている。

制御システムのセキュリティ | 情報セキュリティ(IPA)(外部)

日本国内の制御システム/OTセキュリティのリスクと対策、参考資料をまとめたページで、国際的なOTセキュリティ議論との整合を確認するために参照した。

OT(Operational Technology)とは? ITとの違いやセキュリティ(外部)

OTとITの違い、OTセキュリティの特徴や代表的なリスクを整理した解説記事で、OT環境の特性や重要インフラにおける影響範囲の確認に用いた。

【編集部後記】

OTにAIを入れる、というテーマは、少し遠い世界の話に見えて、実は私たちの日常の電気・水道・交通の裏側そのものに直結しています。この記事を読みながら、「自分の現場にAIを入れるとしたら、どこまでを任せて、どこからを人が握っておきたいか?」を一度イメージしてみてもらえたらうれしいです。

もし現場での実感や不安、逆に「ここはもっとAIに手伝ってほしい」というポイントがあれば、ぜひSNSで教えてください。今後の記事で一緒に深掘りしていきたいです。