ある朝を想像してほしい。あなたの周囲にコンピュータらしきものは何も見当たらない。通知は鳴らない。画面があなたの注意を奪うこともない。それでも部屋の照明はすでにあなたの体内時計に合わせて調整されており、キャンセルされた会議──まだ確認していない──に応じてスケジュールは自動的に再構成され、コーヒーを飲みながらつぶやいた曖昧な疑問に対して、3年前に読んだ本の一節が静かに提示されている。「知性」は遍在化している。しかし、それが認知されることはないかもしれない。

これを現在と比べてみよう。2026年の今、私たちはチャット画面を開き、プロンプトを入力し、出力を待ち、その結果を吟味する。人工知能は依然として「わざわざ使いに行く道具」──枠があり、ログイン画面があるプロダクトである。それはデスクの向こう側に座る同僚のように、あなたと対峙している。

この二つの状態のあいだの移行──離散的な道具としてのAIから、遍在する条件としてのAIへ──を、「AIのアンビエント化」と呼ぶことができるだろう。これは新製品の話ではない。文明的な転換である。それはすでに始まりつつある。そしてそれは、いかなるベンチマークや製品発表よりもはるかに深い問いを提起する──自由とは何か、人間であるとはどういうことか、そして人間は多様で創造的でありつづけられるのか。

この記事の鍵

- AIのアンビエント化という転換は人類の認知的自由を二重に脅かす:

- 第一に、AIが不可視の環境となるとき、私たちの選択と熟慮を支える情報のアーキテクチャは、本人が気づかないまま他者の手に委ねられる。

- 第二に、あらゆる大規模言語モデルは訓練データの統計的平均を出力する構造を持つため、その環境に浸された人類の思考は、特定の時代の「最頻値」へと収斂していく圧力を受ける。この二つが重なるとき、危機にさらされるのは利便性や効率ではなく、異なる考えを持つ能力──民主主義と知的進化の前提条件そのものである。

- ユビキタス・コンピューティングの思想史から、自由論の古典とフリーソフトウェア運動の系譜を経て、LLMがいかに思考を平均化するのか、そしてなぜオープンなAIシステムが人類文明の存続要件であるのかを俯瞰する。

消える技術──AIがもたらす「ユビキタス」の再来

十分に高度な科学技術は、魔法と区別できない。

アーサー・C・クラークの第三法則

Any sufficiently advanced technology is indistinguishable from magic.

AIのアンビエント化の話をする前に、技術の普遍化の原点である、「ユビキタス」という言葉に立ち返ってみましょう。

「最良の技術とは、気づかれない技術である」──この考えには1990年代初頭から続く系譜があります。

1991年、のちにXerox PARCのチーフ・テクノロジストとなり「ユビキタス・コンピューティングの父」と広く認められるXerox PARC Computer Science Laboratoryのマーク・ワイザーは、Scientific American誌に歴史的な論文を発表しました。「最も深遠な技術とは、消えてしまう技術だ。それは日常生活の布地に織り込まれ、やがてそこから区別できなくなる。」ワイザーのビジョンは、コンピュータをより小さく、より速くすることではありませんでした。意識的な注意にとって無関係にすること──あらゆる場所に存在しながら、どこにも見えないようにすることでした(Weiser, 1991)。

ワイザーの思想は意外な源泉から養分を得ていました。マイケル・ポランニーの「暗黙知」──私たちは語れる以上のことを知っています──という概念は、優れた道具は無意識的な技能の延長になるという彼の確信を支えました。マルティン・ハイデガーの「手元存在性/用具性(手元にあるもの、Zuhandenheit)」という概念は、道具は意識から完全に退いたとき最もよく機能することを示唆していました。壊れたときにだけ、ハンマーに気づくのです。

1995-1996年、ワイザーとジョン・シーリー・ブラウン(John Seely Brown)はこれらの考えを「カーム・テクノロジー」として体系化しました──焦点を要求することなく情報を伝え、注意の中心と周辺のあいだを自在に移動する技術です(Weiser & Brown, 1995)。

ナタリー・ジェレミジェンコによる「カーム・テクノロジー」のプロトタイプはわざと控えめなものでした。天井のモーターから垂れ下がる絡まる紐が、ネットワーク・トラフィックに応じて回転し、行ったりきたりします。見てもよいですし、無視してもよいのです。それは決して割り込みません。

1990年代末、このビジョンは名前を得ました。1998年、パロ・アルト・ベンチャーズ(Palo Alto Ventures)のエリ・ゼルカ、サイモン・ビレルとブライアン・エプスタインらのチームはフィリップスとの協働のなかで「アンビエント・インテリジェンス(AmI)」という用語を提唱し、人間の存在を認識し適応的に応答する電子環境を表現しました。

欧州委員会のISTAG諮問グループは2001年にこの概念を採用し、ヨーロッパ全域にわたる正式な研究課題を立ち上げました(ISTAG, 2001; Cook, Augusto & Jakkula, 2009)。こうした流れを受け、アンビエント・インテリジェンスは独立した研究領域として体系化されていきました(包括的な調査として、Sadri, 2011; Dunne, Morris & Harper, 2021を参照)。

しかし20年のあいだ、アンビエント・インテリジェンスは約束のままにとどまりました。センサーは機能しました。ネットワークも機能しました。しかし知性が足りませんでした。2006年、イヴォンヌ・ロジャーズは2点の鋭い批判を加えました。第一に、多くのAmIプロジェクトが期待外れだったのは、コンピュータが人間に代わりうるような柔軟な思考をすることができなかったからで、第二にそもそも技術というのは受動的な環境ではなく、人間と対話し、反応を呼び起こすものでなくてはならないという哲学的批判です(Rogers, 2006)。環境は反応的ではありましたが、真の意味で知的ではありませんでした。あなたが部屋に入ったことは検知できましたが、なぜ入ったかは理解できませんでした。

大規模言語モデルと生成AIが到来したことで、このギャップが埋められつつあります。「知性」となった機械がアンビエント化したとき、人類はどうなってしまうのでしょうか。

実際に、人工知能とアンビエント・インテリジェンスの融合は近年の研究においても中心的な課題として認識されており(Gams et al., 2019)、2025年の歴史的レビューは、この融合が21世紀の最も重要な技術的課題のひとつであると位置づけています(Hernández-Torres & Sánchez-DelaCruz, 2025)。

最近気づいたのですが、筆者の勤務するビルでは、お手洗いの個室のドアの開閉と、個室内の広告ディスプレイが連動していました。知性のアンビエント化の始まりが、もうそこに見えているのでしょうか。また、エレベータのドアの開閉や、スケジューリングは、すでに私たちの見えていないところで、ときにセンサーと連動し、高度に最適化されていることが感じられます。

繰り返される技術革命、適応する人類

ルチアーノ・フロリディは、人類はすでに「第四の革命」のただなかにあり、オンラインとオフラインの区別が溶解した「オンライフ」の条件のもとで生きていると論じました(Floridi, 2014)。AIのアンビエント化は、このオンライフ状態の究極的な帰結とみることができます。

ところで、人間は常に技術を発明することによって、自らの社会の形を変えてきました。石器、制御された火、話し言葉、農耕、文字、活版印刷、蒸気機関、コンピュータ──これらのそれぞれが人間の能力を拡張し、そのそれぞれが人間であるとはどういうことかを再定義してきました。(開いて詳細を表示)

- マーシャル・マクルーハンの観察をカルキンが端的にまとめたように、私たちは道具を形作り、その後、道具が私たちを形作ります(John Culkin, 1967)。〈賢い〉道具が私たちを形づくるとき、私たちはどうなるのでしょうか。

- ベルナール・スティグレールはさらに踏み込み、人間と技術は始まりから共構成的であると論じました。前技術的な人間などいません。道具「とともに」つねにすでに進化してきた存在だけがいます(Stiegler, 1994)。つまり、これから私たちは考える道具とともに進化していくことになります。

- ダナ・ハラウェイの「サイボーグ宣言」は別の角度から同じことを指摘しました。人間と機械の境界は自然的事実ではなく、政治的構築物です(Haraway, 1985)。政治的に構築されたAIによって私たちの境界が構築されていくのです。

では、今回もただ技術革命が繰り返されるだけで、私たちは何も考える必要はない、そう言い切ってしまって良いのでしょうか。

- 我思う、ゆえに我あり(デカルト『方法序説』、1637)

- 人間は、考える葦(あし)である(パスカル『パンセ』、1670年出版)

これらの文章が示すように、思考は人間の定義そのものに関わりうる。

人間が、理性的存在者であるかどうかについては議論がある(心理学や行動経済学などにおいて、人間は常に「合理的判断」をするわけではないことは良く知られている。Allais, 1953; Tversky & Kahneman, 1974など)ものの、人類にとって感じ、考えることは最も重要な行いのひとつであることは、議論の余地がないでしょう。脳死はときに「死」として扱われ、人間は、認知が侵される病になるとき、絶望する者も少なくありません。実に、文字、出版、インターネットは人類の知性を拡張してきました。しかし、人工知能(AI)は、人間の知性の一部分を機械で代行するものであり、定義上、人類の認知を歴史上最も顕著な形で置き換えるのです。

こんにち、私たちが平然と使用しているチャットAIは、私たちの認知を配線し、判断を上書きしています。実は、これら生成AIは小説にでてくる人体のサイボーグ化──人体を機械で置き換えること──よりも人間存在にとって侵襲的なことなのではないのでしょうか。それが、アンビエント化によって、意識されない、〈社会の形〉になるとき、人類はどうなるのか、一度立ち止まって考えてみてもよいかもしれません。

知性がアンビエントであるとき、自由とは何か

1998年、哲学者のアンディ・クラークとデイヴィッド・チャーマーズは「拡張された心」という論文を発表し、一見単純な問いを立てました──心はどこで終わり、世界はどこから始まるのでしょうか。彼らの主張は、認知プロセスは日常的に頭蓋骨の外に拡張しているというものでした。電話番号を覚えるためにノートに頼っているなら、そのノートは機能的にはあなたの記憶の一部です。「あなた」の心の境界は皮膚ではなく、認知プロセスが到達する場所ならどこにでもあります(Clark & Chalmers, 1998)。

アンビエントAIは、この命題を論理的極限まで推し進めます。環境そのものが思考する──あなたの情報をフィルタリングし、文章を補完し、ニーズを先取りする──とき、あなたの認知とシステムの認知のあいだの境界は溶解します。あなたはもはや道具を使っているのではありません。インフラストラクチャとともに思考しており、次第に「それを通じて」思考するようになります。

ここで〈自由の問い〉が私たちの前に立ち上がります。

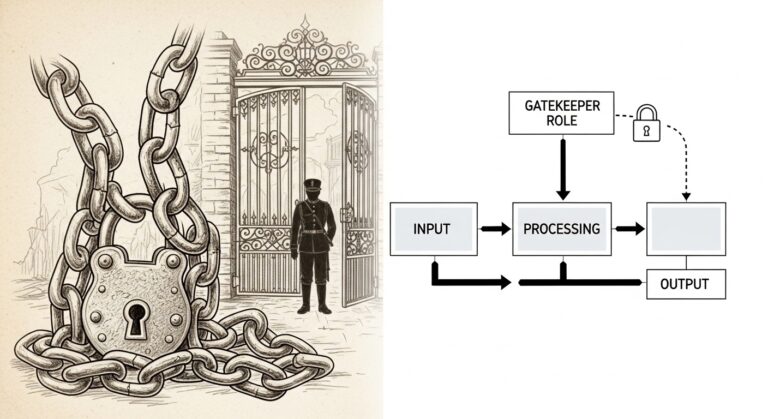

ジョン・スチュアート・ミルからアイザイア・バーリンに至る古典的自由主義は、主権的な推論主体──熟慮し、選択肢を比較衡量し、選ぶ個人──を前提としています。バーリンの有名な「消極的自由」(干渉からの自由)と「積極的自由」(自らの理性的意志に基づいて行動する自由)の区別は、いずれもその推論があなたのものであることを前提としています(Berlin, 1958)。しかし、推論があなたと不可視のアンビエント・システムに分散しているとき、何が起こるでしょうか。自由の〈感覚〉は持続するかもしれません──あなたは自分が選んでいると経験します──一方で、その実質は静かに侵食されます。あなたは選びます。しかしシステムがすでに選別した選択肢のなかからしか選べません。あなたは熟慮します。しかしシステムがすでにフィルタリングした情報によってしか熟慮できません。選択のアーキテクチャはあなたのものではありません。モデルを設計した者のものです。

ここで、フリーソフトウェア運動(無料という意味ではなく、「自由」としてのフリー: free as in freedom)の伝統が単に関連するだけでなく不可欠なものとなります。リチャード・ストールマン(RMS)の根本的洞察──フリーソフトウェア財団の「四つの自由」として定式化されたもの──は、ソフトウェアの自由は他のあらゆる自由の前提条件であるというものでした(Stallman, 2002)。自分の生活を構造化するツールを検査、修正、共有できなければ、あなたは自由ではありません。電子フロンティア財団(EFF)はこの論理をデジタル・インフラストラクチャに拡張しました。依存するプラットフォームが不透明でプロプライエタリであるなら、あなたの自律性はその所有者の善意に依存しています。

AIが環境(アンビエント)であるとき、この影響は測りしれません。AIが画面上のチャットボットであるとき、使わないという選択ができます。タブを閉じればよいのです。しかしAIが環境そのものであるとき(例えば、壁に、スケジュールに、情報の摂取に、半ば意識的な思考プロセスに織り込まれているとき)離脱は電気から離脱するのと同じくらい非現実的になります。あなたの経験を形作る知性を検査し、理解し、拒否する自由は、アンビエントAIの魅力の源泉であるまさにその特質、「不可視性」によって、構造的に損なわれます。

ストールマンはかつて、問題はソフトウェアが便利かどうかではなく、ユーザーが自由かどうかだと書きました(Stallman, 2002)。AIのアンビエント化は、この問いに現代的視点を与えます──問題は環境が助けになるかどうかではなく、そこに住む人間が「別様に考え、感じ、望む能力」を保持しているかどうかです。

ここで、冒頭の〈朝〉の場面に戻ってみましょう。あなたはコーヒーを飲みながら、ある疑問をつぶやきました。システムは3年前に読んだ本の一節を提示しました。しかし、なぜその一節だったのでしょう。提示されなかった、他に10ほどあった章は? あなたが知らない言語で書かれた、まだ翻訳されていない反論は? アンビエントAIの自由の問題は、モデルを弄る自由がないことや、選択肢が制限されることだけにとどまりません。選択肢を生み出す〈思考の原料〉そのものが、ある時点の、ある文明の、ある平均値に固定されていることにあるのです。

思考は、凍結され平均化される──文明のスナップショットとしてのAIモデル

まさに、AIのアンビエント化には、あまり注目されていませんが、長期的にはより重大かもしれない、もう一つの危険があります。

あらゆるAIモデルはコーパスで訓練されます。そのコーパスは、歴史の特定の瞬間における人間の知識、言語、価値観、前提、盲点の、特定のスナップショットを表しています。GPTやClaude、Qwen、Llamaといったモデルはそれぞれ、ある時点におけるインターネットのやや異なる断面をそれぞれエンコードしています。これらは中立的な鏡ではありません。ある文明の、ある瞬間の肖像画です──その未解決の議論、未吟味の前提、構造的バイアスのすべてを含んでいます。また、LLMは定義上、統計的に確率が高い(より「ありそう」な)ものを出力します。(弱い)サピア=ウォーフの仮説の主張するように(強い「決定論的」な仮説は広く支持されていない)、言語によって人間の思考が影響されるならば、これは、人類の思考を〈平均化〉し、私たち人類の宝である、思考・思想の多様性を埋めてしまう危険があるのではないでしょうか(Doshi & Hauser, 2024も参照)。この平均化の技術的な理由については、以下の「【コラム】LLMはなぜ「無難な答え」に収束するのか」で概説しています。

カルティック・ホサナガル、デファン・アンらの研究によれば、AIを人間との共同作業のワークフローに組み込む「方法」によって、得られる成果の多様性や質が大きく変わりうることが示唆されています(Hosanagar & Ahn, 2025; preprint)。

これらのモデルが離散的な道具である限り──参考書のように意識的に参照するもの──スナップショット問題は対処可能です。その本が2023年に書かれたことはわかります。他の情報源を探せます。異論を唱えられます。しかしAIがアンビエントになるとき──環境と相互作用し、情報を受け取り、思考を組織するための不可視の基盤層になるとき──スナップショットはより強制的なものへと固まります。それは思考のデフォルト・フレームワークとなります。検閲によってではなく、アーキテクチャの遍在性によって強制されます。モデルをもはや別個の存在として遭遇しないため、その前提に気づきません。それは単に世界の形になります。

AIは、私たちが「どのような決断をするかという決断」をするというメタ的な能力を危険にさらします(Floridi et al., 2018)。「エージェンシー・ディケイ(agency decay、自律性の崩壊)」とは、AIへの依存が深まるにつれ、人間の認知的自律性が徐々に、しかも本人が気づかないうちに侵食されていく現象を指します。

エージェンシー・ディケイに関する補足(開いて詳細を表示)

Agency decayという言葉は、もともとアメリカの政治学において、活動家的な若者から、飼いならされた、老後へと政策側が誘導しているのではないかという議論で最初に用いられ(regulatory agency decay)、M. H. バーンスタインの1955年の著作が有名です(Meier & Plumlee, 1978)。確認できる範囲では、C・ウォルターの2025年のエッセー集で最初にこの言葉の現代的な意味における使用が認められます。これはScience誌に投稿された認知の負荷を下ろすことに関する論文(Sparrow, B. et al., 2011)に源流が認められるほか、ウォルターが2024年にBMC Global Public Health誌での歴史的な論文において提唱した「ProSocial AI」の概念と深く結びついています(Walther, 2024)。

この概念の知的起源は、ベインブリッジが「オートメーションの皮肉」として提唱した逆説〈自動化が人間の手動スキルを維持する練習機会を奪い、そのスキルを退化させる〉にまで遡ります(Bainbridge, 1983)。パラスラマンらの研究は、分析や意思決定といった高次認知機能の自動化が人間のパフォーマンスに最も深刻な影響を及ぼすことを実証し(Parasuraman, Sheridan & Wickens, 2000)、AIが標的とするのがまさにこれらの能力であることを考えれば、エージェンシー・ディケイは深刻なものとなります。近年の実証研究はこの懸念を裏付けており、H.バスタニらの研究によれば、トルコの高校生を対象とした大規模フィールド実験において、ChatGPTを自由に使用した生徒がアクセスを失った後、AIを一度も使わなかった生徒よりも成績が17%低下したことが報告されています(Bastani et al., 2025)。さらにマクナマラらの研究は、AI支援の利用者がスキルの衰退に気づかないまま能力を喪失する「理解の錯覚」という現象を指摘し、エージェンシー・ディケイの最も危険な特徴〈不可視性〉を浮き彫りにしました(Macnamara et al., 2024)。これらの収束する結論は、AIが人間の能力を補完するだけでなく、それを静かに置換しうるという根本的な問題を提起しています。

トマス・クーンは、科学の進歩はときに、既存のパラダイムから断絶する過程が必要なことを論じました──現行の枠組みが説明できないアノマリーを見出し、それを説明できる新たな枠組みを構築する能力(Kuhn, 1962)、これなしに次の時代に進むことはできません。

また、「疑う」ことは、権力の暴走を防ぐ力であり、民主主義の基礎です。AIが人類の思考を固定化し、平均化するとき、ひとびとはこの「疑う」姿勢を今まで通り保持できるのか、これは重要な問いです。民主主義が機能しない世界では、私たちは今まで通りの自由を得られなくなります。

アンビエントAIは、もし不用意に構築されれば、まさにこの種の突破に対する強力な保守的力になりえます。環境がその訓練データに埋め込まれた概念的カテゴリー──分類体系、連想、関連性の暗黙の序列──を絶えず強化し続けるなら、真に新しいアイデア・平均から外れた考えが生まれることは困難になります。最も危険な検閲者は、見ることのできない検閲者です。最も効果的な檻は、部屋の自然な形に感じられる檻です。

そこに自由の力はあるのか

ここで、自由でオープンソースの伝統は、ソフトウェア政策の問題であるだけでなく、いかに人類文明を守り、発展させるかの問題となります。ヨハイ・ベンクラーの「ネットワークの富」の分析は、オープンでコモンズ(共有地、共有財産)に基づく生産システムが、プロプライエタリなシステムが構造的に阻害する表現と革新の多様性を可能にすることを示しました(Benkler, 2006)。ケイト・クロフォードの『AIの地図帳』は、AIシステムに対する集中的な権力が、人々が世界を理解するカテゴリーに対する集中的な権力に転換されることを記録しました(Crawford, 2021)。

モデルをフォークする自由は、この文脈においては、別様に思考し、感じ、望む自由です。オープンで自由なモデル、オープンな学習データ、計算資源の分散化などは、自由な社会にとって不可欠です。FSFの四つの自由──使用、研究、修正、共有──をアンビエントAIに適用すれば、それは知的進化そのものの前提条件となります。プロプライエタリなアンビエントAIは知的囲い込み──認知的コモンズの私有化──の一形態とみることができます。あなたの日常的思考を形作る不可視の知性の層が例えば3つか4つの企業に属するなら、あなたの思考可能な世界の境界は、彼らの訓練データ、彼らのアラインメントの選択、彼らの商業的インセンティヴによって設定されているのではないでしょうか。

ショシャナ・ズボフが「監視資本主義」と呼んだ構造は、このシナリオにおいてさらに深刻な意味を帯びます。ズボフは、ユーザーの行動データが予測と誘導のための原材料として抽出され、商品化される経済論理を記述しました(Zuboff, 2019)。アンビエントAIは、この抽出をかつてないほど精密かつ連続的なものにします──あなたの思考の流れ、注意の移動、感情の微細な変化が、すべて予測可能な「行動余剰」(監視資本主義にとって必要な「行動の原材料」のこと)になりうるのです。プロプライエタリなアンビエントAIの問題は、認知的囲い込みだけではなく、その不可視性が監視資本主義の理想的な基盤となりうることにもあります。

人間の思考の自由はそもそもが完全に独立なものではないことが度々示されてきました。例えば、小さな環境の変化を与えつづけることによって、選択を制限しなくても、システム的に個人の決断に影響を与えることができることがわかっています(Thaler & Sunstein、2008)。また、Libet (1983) の古典的論文において、個人が行動を決断したと認識する前から、その決定に対応する脳信号が立ち現れていて、その後の行動が予測されるという結論が得られた(現代においては若干の留保があるものの)のは有名な話です。これらの知見は、少なくとも、私たちの意思決定が自分で思っているほど自律的ではない可能性を示唆しています。

人間の判断力というのはかくも「弱い」存在です。AIが環境になるとき、そのシステムがオープンであることは、利便性の問題ではなく、人類文明存続の要件である、とさえ言えるのではないでしょうか。これは、市場競争の問題だけではなく、認知的自由の問題です。資本主義の健全性を守るための議論であると同時に、民主主義と人類の知的営みを守るための議論でもあるのです。

「直す権利」(Right to Repair/Fix)という言葉があります。自分が買った製品は、自分たちで理解したり、直したり、ソフトウェアを置き換えたりする権利があるという考えです。これは、「自由なハードウェア/オープンソースハードウェア」とも関連する概念で、いたるところにAI/IT製品があふれる世界では、私たちの自由に欠かせない要素です。もし、アンビエント化したAIシステムが、ユーザーが調べたり、変えたり、拒否したりできないプロプライエタリ・不自由なブラックボックスならば、認知的自由(Cognitive freedom)は制限されます。ソフトウェアの自由は自由な社会の前提条件なのです。

遍在化したアンビエントAIによって救われる人もいるでしょう。これは、正しく設計されれば、アクセシビリティ上の大きな前進となりえます。問題は、これからのAIシステムにおいて、「正しい」設計を数社のグローバル企業に委ねず、より分散的な、開かれた社会実装ができるかということにかかっているのではないでしょうか。

| 年 | 出来事 | 重要性・内容 |

|---|---|---|

| 1991 | ユビキタス・コンピューティングに関する歴史的論文の発表(マーク・ワイザー) | 「最も深遠な技術とは消えてしまう技術だ」というビジョンを提唱。コンピュータを意識的な注意から切り離し、日常生活の背景へと織り込むことを目指した。 |

| 1995-1996 | 「カーム・テクノロジー(穏やかな技術)」の体系化(マーク・ワイザー、ジョン・シーリー・ブラウン) | 注意の中心と周辺を自在に移動し、焦点を過度に要求することなく情報を伝える技術。ナタリー・ジェレミジェンコによるプロトタイプも制作され、アンビエント化の基礎を築いた。 |

| 1998 | 「アンビエント・インテリジェンス(AmI)」用語の提唱(パロ・アルト・ベンチャーズ、フィリップス) | 人間の存在を認識し、適応的に応答する電子環境を定義。現代のAIが環境に溶け込む「アンビエント化」の概念的基礎となった。 |

| 1998 | 「拡張された心」論文の発表(アンディ・クラーク、デイヴィッド・チャーマーズ) | 認知プロセスが頭蓋骨の外(道具や環境)に拡張していると主張。アンビエントAIが認知とシステムの境界を溶解させるという議論の先駆けとなった。 |

| 2001 | 欧州委員会によるAmI概念の採用(ISTAG(欧州委員会諮問グループ)) | アンビエント・インテリジェンスを正式な研究課題として採用。ヨーロッパ全域で技術の体系化と社会実装に向けた研究が進められた。 |

| 2006 | AmIに対する批判的考察(イヴォンヌ・ロジャーズ) | 当時のAmIが「知性」に欠け、人間との対話的な反応が不十分であることを指摘。この機能的欠如が、現在のLLM(大規模言語モデル)の登場によって補完されつつある。 |

| 2014 | 「オンライフ(Onlife)」概念の提唱(ルチアーノ・フロリディ) | オンラインとオフラインの区別が溶解した状態を定義。AIのアンビエント化を、このデジタルと現実が融合した状態の究極的な帰結と位置づけた。 |

| 2025 | AIとAmIの融合に関する歴史的レビューの発表(Hernández-Torres, Sánchez-DelaCruz) | AI技術とアンビエント・インテリジェンスの融合を21世紀における最も重要な技術的課題のひとつとして位置づけ、その進展を総括した。 |

| 2026 現在 | AIのアンビエント化への移行期 | AIが「操作する道具」から「遍在する環境条件」へと変容する文明的転換点。人類の思考の平均化や自由意志の在り方についての新たな問いが提起されている。 |

【参考文献】

文献リスト(開いて詳細を表示)

- Allais (1953). “Le comportement de l’homme rationnel devant le risque.” Econometrica. https://doi.org/10.2307/1907921

- Bainbridge, L. (1983). “Ironies of automation.” Automatica, 19(6), pp. 775-779. https://doi.org/10.1016/0005-1098(83)90046-8

- 🔓 Full text (PDF): https://davidjusth.com/s/Ironies-of-Automation_Bainbridge_1983.pdf

- Bastani, H. et al. (2025). “Generative AI without guardrails can harm learning: Evidence from high school mathematics.” Proc. Natl. Acad. Sci. U.S.A. 122(26) e2422633122. https://doi.org/10.1073/pnas.2422633122

- Benkler, Y. (2006). The Wealth of Networks: How Social Production Transforms Markets and Freedom. Yale University Press. ISBN 978-0-300-12577-1. https://doi.org/10.1177/1084713807301373

- Bernstein, M. H. (1955). Regulating Business by Independent Commission. Princeton University Press. ISBN 9780691650388 (re-published 2016).

- Berlin, I. (1958). “Two Concepts of Liberty.” Oxford University Press.

- 🔓 Full text (PDF): https://web.ics.purdue.edu/~mjacovid/Two%20Concepts.pdf

- Clark, A. & Chalmers, D. (1998). “The Extended Mind.” Analysis, 58(1), 7–19.

- 🔓 Full text (PDF): https://www.alice.id.tue.nl/references/clark-chalmers-1998.pdf

- Oxford Academic: https://academic.oup.com/analysis/article-abstract/58/1/7/153111

- PhilPapers: https://philpapers.org/rec/CLATEM

- Cook, D. J., Augusto, J. C. & Jakkula, V. R. (2009). “Ambient intelligence: Technologies, applications, and opportunities.” Pervasive and Mobile Computing, 5(4), 277–298. https://doi.org/10.1016/j.pmcj.2009.04.001

- Crawford, K. (2021). Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence. Yale University Press.

- Doshi, A. & Hauser, O. (2024). “Generative AI enhances individual creativity but reduces the collective diversity of novel content.” Science Advances, 10(28).

- Dunne, R., Morris, T. & Harper, S. (2021). “A Survey of Ambient Intelligence.” ACM Computing Surveys, 54. https://doi.org/10.1145/3447242

- Floridi, L. (2014). The Fourth Revolution: How the Infosphere Is Reshaping Human Reality. Oxford University Press. ISBN 978-0-199-60672-6

- Floridi, L., Cowls, J., Beltrametti, M. et al. (2018). “AI4People—An Ethical Framework for a Good AI Society: Opportunities, Risks, Principles, and Recommendations.” Minds & Machines 28, 689–707. https://doi.org/10.1007/s11023-018-9482-5

- 🔓 Full Text (PDF): https://link.springer.com/content/pdf/10.1007/s11023-018-9482-5.pdf

- Gams, M. et al. (2019). “Artificial Intelligence and Ambient Intelligence.” J. Ambient Intell. Smart Environ. https://doi.org/10.3233/AIS-180508

- Haraway, D. (1985). “A Cyborg Manifesto.” Socialist Review, 80, 65–108.

- Hernández-Torres, G. A. & Sánchez-DelaCruz, E. (2025). “Challenges and Opportunities of Ambient Intelligence (AmI) in the 21st Century: A Historical Review.” Evolutionary Intelligence. https://doi.org/10.1007/s12065-025-01067-1

- Hosanagar, K. & Ahn, D. (2025). (Preprint) “Designing Human and Generative AI Collaboration.” arXiv:2412.14199 [cs.HC]

- ISTAG. (2001). Scenarios for Ambient Intelligence in 2010. European Commission.

- Kuhn, T. S. (1962). The Structure of Scientific Revolutions. University of Chicago Press.

- Libet et. al. (1983). “Time of Conscious Intention to Act in Relation to Onset of Cerebral Activity.” Brain. https://doi.org/10.1093/brain/106.3.623

- Macnamara, B.N., Berber, I., Çavuşoğlu, M.C. et al. (2024). “Does using artificial intelligence assistance accelerate skill decay and hinder skill development without performers’ awareness?.” Cogn. Research 9, 46. https://doi.org/10.1186/s41235-024-00572-8

- 🔓 Full text (PDF): https://link.springer.com/content/pdf/10.1186/s41235-024-00572-8.pdf

- Meier, K. & Plumlee, J. (1978). “Regulatory Administration and Organizational Rigidity.” The Western Political Quarterly, 31(1), pp. 80-95.

- McLuhan, M. (1964). Understanding Media: The Extensions of Man. McGraw-Hill.

- Parasuraman, R., Sheridan, T.B., & Wickens, C.D. (2000). “A model for types and levels of human interaction with automation.” IEEE transactions on systems, man, and cybernetics. Part A, Systems and humans : a publication of the IEEE Systems, Man, and Cybernetics Society, 30(3), 286-97.

- Rogers, Y. (2006). “Moving on from Weiser’s Vision of Calm Computing: Engaging UbiComp Experiences.” UbiComp 2006, Springer, 404–421.

- Sadri, F. (2011). “Ambient Intelligence: A Survey.” ACM Computing Surveys, 43(4), Article 36.

- Sparrow, B. et al. (2011). “Google Effects on Memory: Cognitive Consequences of Having Information at Our Fingertips.” Science, 333, 776-778. https://doi.org/10.1126/science.1207745

- Stallman, R. (2002, 2010). Free Software, Free Society: Selected Essays. GNU Press. ISBN 978-0-9831592-0-9

- 🔓 Full text (PDF, 2nd ed.): https://www.gnu.org/doc/fsfs-ii-2.pdf

- Internet Archive: https://archive.org/details/FreeSoftwareFreeSociety-SelectedEssaysOfRichardM.Stallman2nd

- Stiegler, B. (1994). Technics and Time, 1: The Fault of Epimetheus. Stanford University Press.

- Thaler & Sunstein (2008). Nudge: Improving Decisions About Health, Wealth, and Happiness. Yale University Press.

- Tversky & Kahneman (1974). “Judgment under Uncertainty: Heuristics and Biases.” Science. https://doi.org/10.1126/science.185.4157.1124

- Walther, C. (2024). Human Leadership for Humane Technology: The New AI: Agency Ignited. Palgrave Macmillan / Springer Nature. ISBN: 978-3-031-67822-6 (hardcover).

- Walther, Cornelia C. (2024). “ProSocial artificial intelligence as a catalyst for holistic health: a multidimensional approach.” BMC Global and Public Health, 2, Article 76. https://doi.org/10.1186/s44263-024-00111-z. PMID: 39681970. PMCID: PMC11622915. Open Access (CC BY-NC-ND 4.0).

- Weiser, M. (1991). “The Computer for the 21st Century.” Scientific American, 265(3), 94–104.

- 🔓 Full text (PDF): https://web.archive.org/web/20251112090400/https://ics.uci.edu/~corps/phaseii/Weiser-Computer21stCentury-SciAm.pdf

- Archived from original: https://ics.uci.edu/~corps/phaseii/Weiser-Computer21stCentury-SciAm.pdf

- Scientific American: https://www.scientificamerican.com/article/the-computer-for-the-21st-century/

- Semantic Scholar: https://www.semanticscholar.org/paper/The-computer-for-the-21st-Century-Weiser/4329d5be8e6988e4516c2884ba26498ed1ee6b24

- 🔓 Full text (PDF): https://web.archive.org/web/20251112090400/https://ics.uci.edu/~corps/phaseii/Weiser-Computer21stCentury-SciAm.pdf

- Weiser, M. & Brown, J. S. (1995). “Designing Calm Technology.” Xerox PARC.

- 🔓 Full text (PDF): https://people.csail.mit.edu/rudolph/Teaching/weiser.pdf

- CalmTech.com papers collection: https://calmtech.com/papers

- Weiser, M. & Brown, J. S. (1997). “The Coming Age of Calm Technology.” Beyond Calculation. https://doi.org/10.1007/978-1-4612-0685-9_6

- Weiser, M., & Want, R. (2000). “Calm Technology and Pervasive Connectivity.”

- Zuboff, S. (2019). The Age of Surveillance Capitalism. PublicAffairs.

【関連リンク】

Ambient intelligence(1998)

- ‘Digital Living Room’ Webcast schedule – ZDNet. 1998-06-19 (Retrieved on 2026/04/02)

自由・倫理・デジタル権利

Free Software Foundation (フリーソフトウェア財団、FSF)

- The Free Software Definition — FSF’s Four Essential Freedoms

Electronic Frontier Foundation (EFF)

- EFF — Main site

- EFF — AI policy and digital rights resources

- EFF — Digital Freedom Depends on the Right to Tinker

現代の文脈

Agency decay

- Walther, C. (2025). “What Is Agency Decay?” Psychology Today.

アンビエントAIとLLM (2024–2025)

- Doyle, G. (2024). “Ambient AI: From Waiting to Watching.”

- “HomeLM: A Foundation Model for Ambient AI.”Network World, 2025

- Gartner (2024). “Gartner Identifies the Top 10 Strategic Technology Trends for 2025”

- “Enabling Ambient AI with Wearables and AIoT.”IoT For All

Calm Technology — 現代

- Case, A. (2015). Calm Technology: Principles and Patterns for Non-Intrusive Design. O’Reilly Media

- mui Lab (Kyoto) — Calm technology startup

補助資料——背景理解のための外部リンク

- Sandberg, H. (2023). “Mark Weiser’s Quest for Calm Computing.” Medium.

- Mark Weiser — Wikipedia

- Ambient Intelligence — Wikipedia

- The Structure of Scientific Revolutions — Wikipedia

- A Cyborg Manifesto — Wikipedia

- Two Concepts of Liberty — Wikipedia

- Understanding Media — Wikipedia

- The Free Software Definition — Wikipedia

【編集部後記】

ある伝記によれば、マーク・ワイザーは1999年にがんと診断され、余命は数週間と告げられました。最初の衝動は、かねて構想していた本──ユビキタス・コンピューティングの哲学の全体像──を書くために一人になることでした。しかし彼は、残された時間を家族、元妻、娘たち、友人たちとともに過ごすことを選びました。彼は、そこにいることを選びました。

この伝記的エピソードは、ワイザーの人生の仕事における道徳的核心だと思います。消えるコンピュータは、効率の話ではありませんでした。それは余白をつくること──人間の注意が本当に大切なものに着地するための余白をつくること──の話でした。技術は「静けさを生み出すべきです」と彼は書きました。技術が退くことで、生が前に出ます。人類を縛るための不可視化ではなく、人類が次に動くための余白。

AIのアンビエント化は人間の生に、より多くの余白をつくるのでしょうか、それとも、より少なくするのでしょうか。そして最良のアンビエントAIとは、逆説的ながら、おそらく、あなたがオフにすることを選べるもの──そしてその違いに気づけるものです。

AIは、すでに私たちの生活の一部になっています。私も、AIのガードレール(安全などのための規制)に思いがけず引っかかってしまい、単純なAI作業で大幅な寄り道を余儀なくされたことが何度となくあります。このように、見えない枷(かせ)が私たちの自由や利便性を縛り、想像もしない方向に社会を導いてしまう可能性について、私たちはもっと考えないといけないかもしれません。

ここで、2つの問いを立て、この記事を締めくくりたいと思います。

- AIが不可視化され究極の権力となる世界で、私たちはどのように自由と民主主義を担保するか。

- 生成AIは本質的に思考を平均化する効用を持つということを私たちは認知し、多様な人類の認知・思想を育みつづけることができるのか。

この記事もまたひとつの考えに過ぎません。人類の未来はひとりひとりが自分の考えを持ちつづけられるかにかかっているのではないでしょうか。