選挙予測AIが、ついに自分の”思考プロセス”まで公開する時代になった。ホリエモンAI学校の「ホリエモンAI選挙」は、3つのAIを使い分けて2026年衆議院選を予測するだけでなく、AIへの指示内容まですべて見せることで、ブラックボックス化しがちなAI予測に透明性をもたらそうとしている。

ホリエモンAI学校株式会社(本社:東京都新宿区、代表取締役CEO:荒木賢二郎)は、2026年に実施予定の衆議院議員総選挙に向けて公開した『ホリエモンAI選挙』の仕組みを公開した。本サービスは複数のAIを組み合わせて選挙情勢を予測し、AIへの指示内容であるプロンプトを公開することで透明性を担保している。

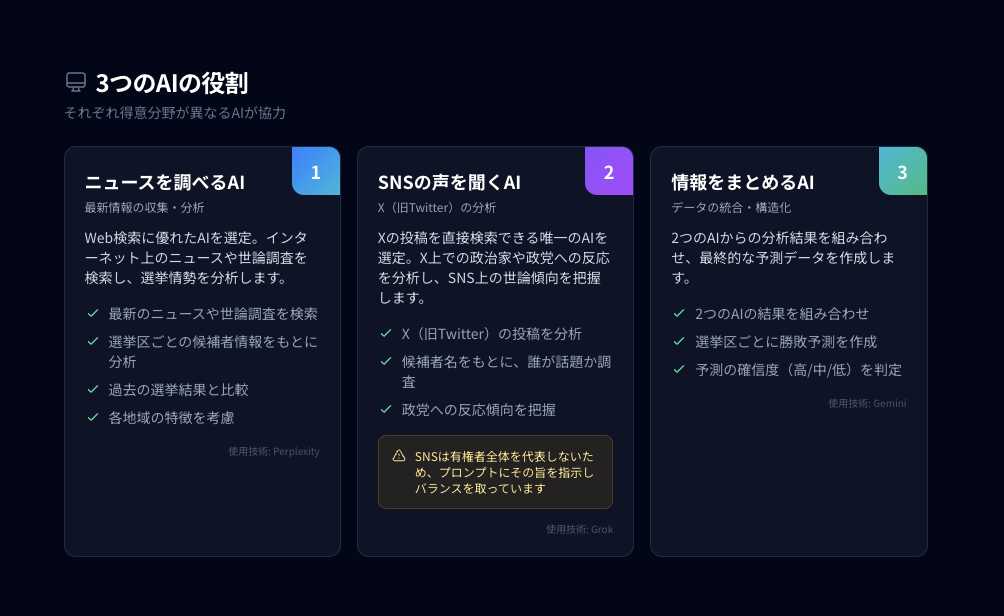

予測は1日3回自動更新され、289小選挙区・11比例ブロックなどの区割り情報や候補者名・政党・経歴といった基礎データを事前にAIに渡すことでハルシネーションを抑制する。3つのAIが役割分担し、Perplexityがニュースや世論調査の収集・分析を、GrokがX上の反応分析を、Geminiが2系統の結果の統合・構造化を担当する。

From: ![]() 自民236議席中道119議席で自民単独過半数?ホリエモンAI選挙2026衆議院選AI予想の仕組みを公開

自民236議席中道119議席で自民単独過半数?ホリエモンAI選挙2026衆議院選AI予想の仕組みを公開

【編集部解説】

このプレスリリースで特筆すべきは、AIへの指示内容であるプロンプトを全面公開するという透明性への徹底したこだわりです。生成AIが社会インフラとして選挙予測のような重要な領域に進出する際、ブラックボックス化された判断プロセスは信頼性の最大の障壁となります。プロンプト公開により、AIがどのような基準で情報を収集・分析しているかを誰でも検証できる状態を作り出しました。

技術的なアプローチとして注目すべきは、複数のAIを組み合わせるアンサンブル手法の採用です。Perplexity、Grok、Geminiという異なる特性を持つAIモデルを役割分担させることで、単一モデルに起因するバイアスや誤認識のリスクを低減しています。ニュース分析とSNS分析という異なる情報源を並行処理し、矛盾がある場合も両論併記する設計は、偏った予測を避けるための工夫といえます。

ハルシネーション(AIによる事実誤認)への対策として、289小選挙区・11比例ブロックといった選挙の基礎データを事前に構造化してAIに提供する手法は、RAG(Retrieval Augmented Generation)アプローチに近い考え方です。AIに自由に情報を生成させるのではなく、確定した事実を土台として提供することで、存在しない候補者や誤った区割り情報を生成するリスクを抑制しています。

一方で、AI選挙予測には本質的な課題も存在します。選挙という人間の意思決定プロセスは、過去のデータパターンだけでは捉えきれない突発的要因や心理的変化を含みます。AIが学習する情報源(ニュース報道やSNS)自体がすでに何らかのバイアスを含んでいる可能性もあり、AIはそれを増幅する危険性を孕んでいます。

メディア向けに予測データを無償提供し、引用元表記のみで自由に利用可能とした戦略も興味深い点です。これにより多くのメディアが同じAI予測を参照することで、選挙報道のエコシステム全体に影響を与える可能性があります。予測が広く共有されることで有権者の投票行動に影響を与える「予言の自己成就」効果も懸念されるでしょう。

1日3回の自動更新という頻度は、選挙情勢の流動性を捉える試みですが、同時に予測の揺れ動きが有権者の混乱を招くリスクもはらんでいます。AIによる選挙予測は、あくまで「参考視点のひとつ」として位置づけられていますが、数値化された予測が持つ説得力の高さゆえに、過度な信頼を集める可能性には注意が必要です。

【用語解説】

プロンプト

AIに対する指示文のこと。生成AIに何をどのように処理させるかを言語で記述したもので、プロンプトの設計次第でAIの出力品質が大きく変わる。このシステムではプロンプトを公開することで透明性を確保している。

ハルシネーション

AIが事実に基づかない情報を生成してしまう現象。日本語では「幻覚」と訳されることもある。AIが学習データにない情報を推測で補完したり、存在しない事実を創作してしまうことを指す。

RAG(Retrieval Augmented Generation)

検索拡張生成と呼ばれるAI技術。AIが回答を生成する際に、事前に用意された信頼できるデータベースから関連情報を検索・参照することで、ハルシネーションを抑制し、より正確な出力を実現する手法。

アンサンブル手法

複数の異なるAIモデルや機械学習モデルを組み合わせて予測精度を高める技術。単一モデルの弱点や偏りを相互に補完し合うことで、より安定した結果を得ることができる。

【参考リンク】

ホリエモンAI選挙(外部)

複数のAIを組み合わせた2026年衆議院選挙の予測サイト。1日3回更新でプロンプトを公開し透明性を担保。

ホリエモンAI選挙 予測の仕組み(外部)

AI選挙予測システムの詳細とプロンプト内容を公開。3ステップの生成プロセスを解説。

Perplexity(外部)

検索機能を統合した対話型AI。このシステムでニュースや世論調査の収集・分析を担当。

【参考記事】

A Comprehensive Survey of Hallucination Mitigation Techniques in Large Language Models(外部)

大規模言語モデルにおけるハルシネーション軽減技術の包括的調査論文。RAGなど様々な抑制手法を体系化。

Ensemble Learning: discover combined models(外部)

アンサンブル学習の基礎概念と利点を解説。複数モデル組み合わせによる精度向上とバイアス低減を説明。

Addressing Bias Through Ensemble Learning and Regularized Fine-Tuning(外部)

アンサンブル学習と正則化によるバイアス軽減研究。複数AIモデル組み合わせで偏り緩和を検証。

Why Electoral Authorities Need an AI Framework(外部)

選挙当局がAIフレームワークを必要とする理由を論考。AI技術の選挙への影響と透明性確保を考察。

【編集部後記】

AIによる選挙予測が、プロンプトまで公開して透明性を追求する時代になりました。皆さんは、こうしたAI予測をどの程度信頼しますか?プロンプトが公開されていることで安心感は増すでしょうか。それとも、AIがどれだけ精緻になっても、人間の投票行動を予測することには限界があると感じるでしょうか。私たち編集部も、AI技術の可能性と限界について、皆さんと一緒に考えていきたいと思っています。選挙という民主主義の根幹にAIが関わる未来について、ぜひご意見をお聞かせください。