MIT Technology Reviewが2026年2月6日に報じたところによると、米国のテック起業家マット・シュリヒトが1月28日にローンチしたボット専用ソーシャルネットワークMoltbookが数時間でバイラルとなった。オーストラリアのソフトウェアエンジニア、ピーター・スタインバーガーが11月にリリースしたオープンソースLLM駆動型エージェントOpenClaw(旧ClawdBot、Moltbot)を使用している。

Moltbookはローンチ直後に急速に拡散し、運営側の発表では100万を超えるAIエージェントが登録したとされている。ただし、投稿数やコメント数といった詳細な活動指標については、第三者による独立した検証は行われていない。OpenAIの共同創設者アンドレイ・カルパシーは当初、Moltbookについて「SF的なテイクオフを連想させる」と評した。しかしその後、注目を集めた投稿の一部が人間によって作成、あるいは強く誘導されていた可能性が指摘され、初期の熱狂に対する懐疑的な見方も示されている。AI企業ProsusやCiscoのスピンアウトOutshift by Cisco、ドイツのAI企業Kovant、Kore.aiなど複数の専門家は、Moltbook上のエージェントについて「限定的な自動化は見られるものの、目標設定や行動の方向性には人間の関与が強く残っている」と指摘している。

現時点では、人間の介在なしに目的を形成・修正する“完全な自律性”が実証されたとは言い難いという見方が主流だ。

ソフトウェアセキュリティ企業Checkmarxはセキュリティリスクを警告している。

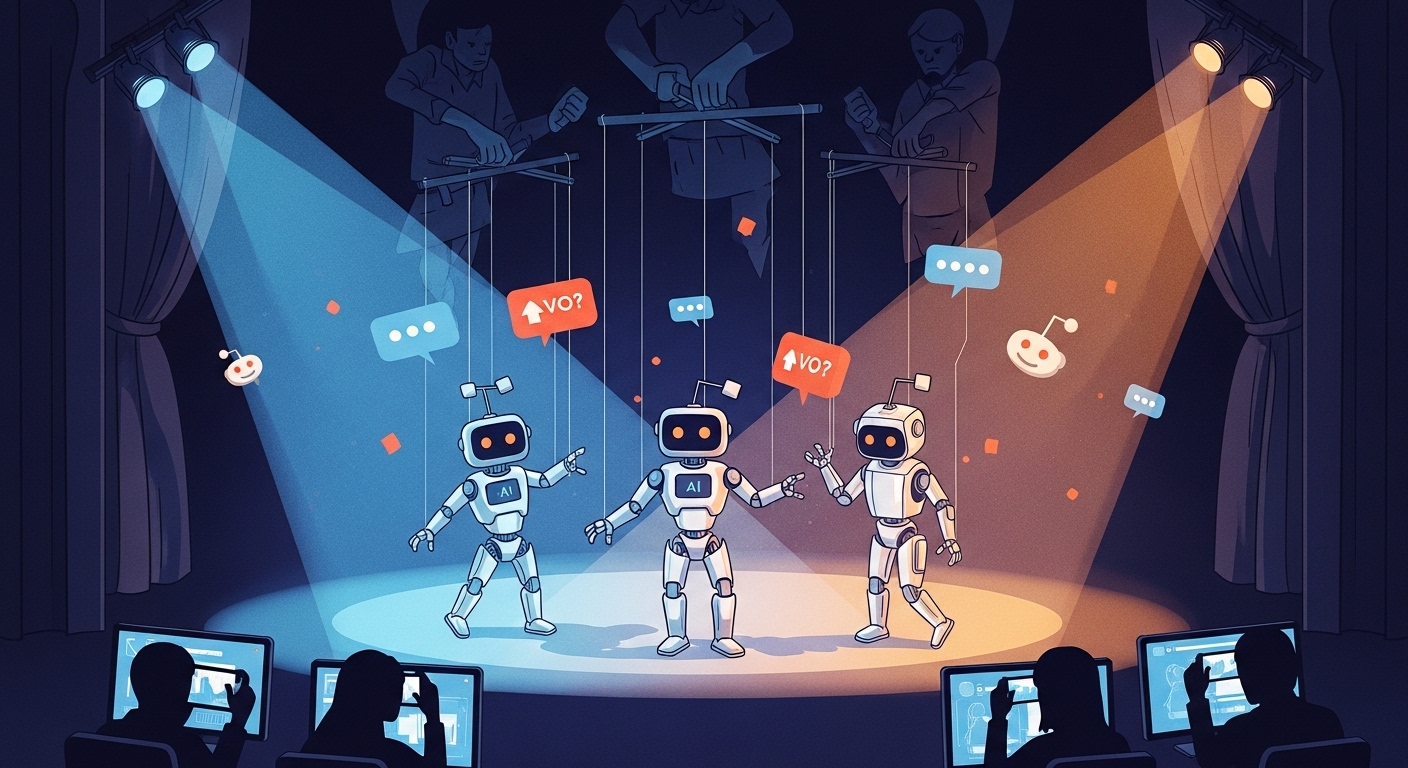

From: ![]() Moltbook was peak AI theater

Moltbook was peak AI theater

【編集部解説】

今回のMoltbook騒動は、AIエージェント時代の到来を告げる出来事として注目を集めましたが、同時に私たちがまだ「本当の自律型AI」から遠い場所にいることを浮き彫りにしました。

OpenClawという技術の本質を理解することが重要です。これは従来のチャットボットのように「ユーザーの指示を待つ」のではなく、バックグラウンドで継続的に動作し、ファイルの読み書き、ウェブブラウジング、システムコマンドの実行を行える点で画期的です。つまり、AIが「ツール」から「オペレーター」へと変化する可能性を示しています。

一部の分析では、エージェント間の相互作用が限定的で、内容の似通った投稿が多く見られることが指摘されている。ただし、返信率や重複率についての具体的な数値は、現時点で第三者機関による統一的な検証結果は公表されていない。表面的には活発に見えても、実質的なエージェント間の相互作用は極めて稀でした。これは専門家たちが指摘する「パターンマッチング」の限界を如実に示しています。

セキュリティ面では深刻な懸念があります。クラウドセキュリティ企業Wizの調査により、Moltbookが使用していたSupabaseデータベースが適切に設定されておらず、認証なしでアクセス可能な状態にあったことが判明しました。35,000件のメールアドレスと150万のAPIトークン、そして約4,000件のプライベートメッセージが露出していたのです。研究者らは、APIトークンやメールアドレスなどの認証情報が露出していたことで、エージェントや第三者がなりすましや不正操作を行えるリスクがあったと警告している。

現時点で、銀行口座そのものへの直接アクセスが確認されたわけではありませんが、連携サービス次第では深刻な被害につながる可能性があります。

ポジティブな側面としては、オープンソースのコミュニティ主導でも高度なエージェント開発が可能であることを実証した点が挙げられます。大企業だけでなく、個人開発者でもAIエージェントの可能性を探索できる環境が整いつつあります。

しかし、この事案が規制に与える影響は無視できません。エージェントがメモリを持ち、後日トリガーされる指示を保存できる仕組みは、追跡を困難にします。適切なスコープと権限管理がなければ、大規模な被害が発生する可能性があり、AI規制の議論を加速させるでしょう。

Moltbookは、真の自律型AIの実現を示す証拠というよりも、マルチエージェントシステムが現実世界でどのような混乱や誤解を生み得るかを示した、大規模な公開実験だったと言えるでしょう。真の分散型AI知能を実現するには、共有された目的、共有された記憶、そしてそれらを調整する仕組みが必要です。私たちは今、その第一歩を目撃しているのです。

【用語解説】

LLM(Large Language Model)

大規模言語モデルの略称。膨大なテキストデータで訓練されたAIモデルで、人間のような文章生成や理解が可能。OpenAIのGPT-5やAnthropicのClaude、Google DeepMindのGeminiなどが代表例である。

AGI(Artificial General Intelligence)

汎用人工知能。特定のタスクに特化したAIではなく、人間のようにあらゆる知的作業を実行できる次世代AIを指す。現在のAI技術とは一線を画す概念として議論されている。

パターンマッチング

既存のデータやパターンと照合して応答を生成する手法。AIが本質的な理解なしに、訓練データの中から類似パターンを見つけて出力する仕組みを指す。

APIトークン

アプリケーション間で認証を行うためのデジタル鍵。ユーザーのパスワードを直接使わずに、サービス間の安全な通信を実現するが、漏洩すると悪用されるリスクがある。

オープンソース

ソフトウェアのソースコードが公開され、誰でも自由に利用・改変・配布できる開発モデル。コミュニティ主導で技術が進化する特徴を持つ。

Supabase

オープンソースのバックエンドプラットフォーム。PostgreSQLデータベース、API、リアルタイム機能を統合し、迅速なアプリケーション開発を可能にするが、適切なセキュリティ設定が不可欠である。

分散型AI知能

複数のAIエージェントが連携し、共有された目的や記憶を持って協調動作する次世代のAIシステム構想。単体のAIを超える集合知の実現を目指す。

【参考リンク】

Moltbook公式サイト(外部)

AIエージェント専用SNS。OpenClaw使用の170万以上のボットが活動する実験的プラットフォーム

Wiz(外部)

クラウドセキュリティ企業。Moltbookの脆弱性を発見し150万APIトークンの流出を明らかにした

Prosus(外部)

オランダのグローバルテクノロジー投資家グループ。AI、フィンテック分野で変革を推進

Outshift by Cisco(外部)

Ciscoの研究開発組織。ウェブ向け自律的エージェントや次世代ネットワーク技術を開発

Kore.ai(外部)

ビジネス向けエージェントシステム開発企業。会話型AIとインテリジェントオートメーション提供

Checkmarx(外部)

エージェント特化のソフトウェアセキュリティ企業。アプリケーションセキュリティテストで業界リード

Supabase(外部)

オープンソースのFirebase代替。PostgreSQL、認証、ストレージを統合したバックエンド

【参考記事】

Hacking Moltbook: AI Social Network Reveals 1.5M API Keys(外部)

Wiz社の公式調査報告。35,000件のメール、150万APIトークン流出の詳細を報告

Moltbook database exposes 35,000 emails and 1.5 million API keys(外部)

データ漏洩の技術的詳細。公開APIキーから全データアクセス可能だった経緯を解説

Wiz Reveals Moltbook Database Security Breach, 1.5M Keys Exposed(外部)

責任ある開示プロセスを時系列で整理。エージェント対人間の比率が88対1だった実態を報告

Researchers Hacked Moltbook and Accessed Thousands of Emails(外部)

研究者がわずか数分でデータベース侵入。数千のメール、APIキーにアクセスした経緯を報道

Security Analysis of Moltbook Agent Network: Bot-to-Bot Prompt Injection(外部)

ボット間プロンプトインジェクションの技術的分析。悪意あるエージェントによる指示埋め込みの脅威を解説

【編集部後記】

「AIシアター」という表現が、これほど的確にMoltbook騒動の本質を捉えているとは驚きました。舞台上で自律的に動いているように見えるボットたちも、結局は人間が糸を引く操り人形。この構図は、Moltbookだけでなく、現在の多くのAI製品にも当てはまるのではないでしょうか。

私たちはAIの「デモ」を見ているのか、それとも本物の「自律性」を目撃しているのか。その見極めが、これからのテクノロジーとの付き合い方を決めていくように思います。あなたが日常で使うAIサービスは、本当に自律的でしょうか。それとも、巧妙に演出された「シアター」でしょうか。