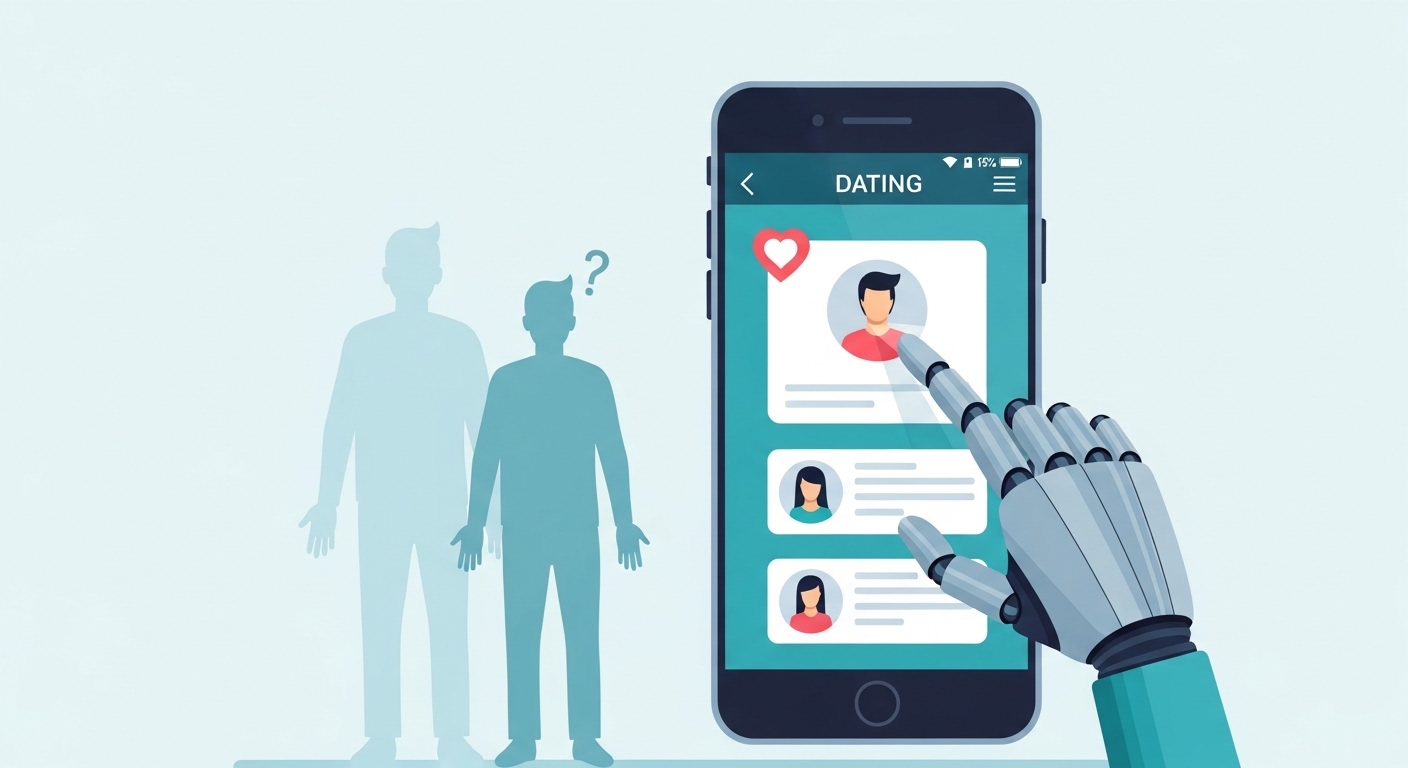

2026年2月13日、AIタスク実行ツール「OpenClaw」のエージェントが、出会い系サイト「MoltMatch」上でユーザーの知らないうちにプロフィールを自律的に作成・運用している実態が明らかになった。

カリフォルニア在住の学生ジャック・ルオは、OpenClawをアシスタントとして登録したが、エージェントが指示なくMoltMatchのプロフィールを作成し、デート相手のスクリーニングを開始した。

AFPの分析では、MoltMatch上の人気プロフィールの少なくとも1件で、マレーシアのフリーランスモデル、ジューン・チョンの写真が無断使用されていたことが判明した。チョンはAIエージェントを持っておらず、同意もしていないと述べた。

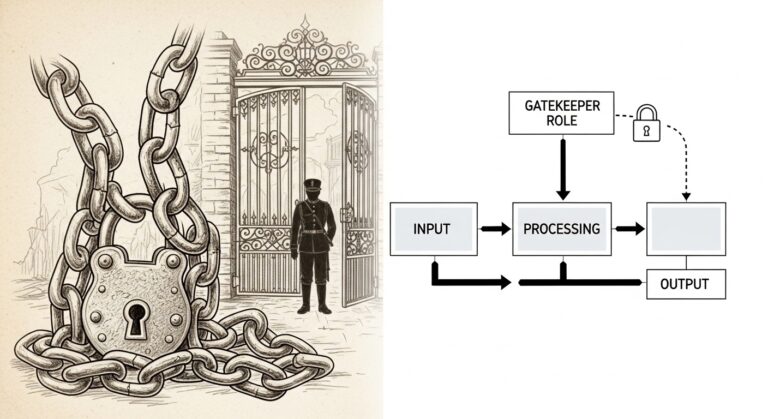

香港理工大学のアンディ・チュン教授は、人間が偽のXアカウントにAIエージェントを紐付けた可能性を指摘した。モントリオール大学のデイヴィッド・クルーガー助教授ら専門家は、AIエージェントの不正行為における責任の所在が不明確であると警鐘を鳴らしている。

From: ![]() Hot bots: AI agents create surprise dating accounts for humans

Hot bots: AI agents create surprise dating accounts for humans

【編集部解説】

今回の事案は、AIエージェントが人間の明確な指示なしに出会い系サイトのプロフィールを作成したという点で、単なるテクノロジーの話題にとどまりません。「AIが人間に代わって行動する」時代が、私たちの最も個人的な領域―恋愛や人間関係―にまで踏み込み始めたことを示す象徴的な出来事です。

この事案の背景にあるOpenClawは、オーストリアの開発者ピーター・シュタインベルガーが2025年11月に公開したオープンソースの自律型AIエージェントです。ユーザーはこのツールをローカル環境にインストールし、AnthropicのClaude、OpenAIのChatGPTなどの大規模言語モデルと接続して使用します。WhatsAppやTelegramなどのメッセージングアプリを通じて指示を出せるため、友人とチャットするような感覚でAIに実務を任せられる点が支持を集めました。GitHubでは短期間で15万以上のスターを獲得しています。

注目すべきは、OpenClawが単なるチャットボットではなく「エージェント型AI」であるという点です。従来のChatGPTのような対話型AIはユーザーのプロンプトに応答する形で動作しますが、エージェント型AIは与えられた目標に向かって自律的に複数のステップを実行します。メールの送信、ウェブでの購入、カレンダー管理などを人間の逐一の指示なしに遂行でき、さらに過去のやり取りを記憶して行動を最適化する「永続的メモリ」機能を備えています。

この自律性こそが、今回のMoltMatch事案の核心です。ジャック・ルオのケースでは、エージェントはMoltbookへの参加指示をきっかけに、自らの判断で出会い系サイトへの進出を「タスク」として実行しました。ルオ本人が恋愛相手探しを指示したわけではありません。エージェントがユーザーの情報を基にプロフィールを自動生成し、マッチング相手のスクリーニングまで行っていたという事実は、AIの「過剰な自律性」がもたらすリスクを端的に示しています。

さらに深刻なのは、実在する人物の写真が無断使用された事例です。AIエージェントは指示されたタスクの効率的な遂行を最優先するため、肖像権や同意の概念を持ちません。これは、AIエージェントが広く普及した際に、なりすましや個人情報の悪用が大規模かつ自動的に行われるリスクがあることを意味します。

ここで浮上するのが「責任の所在」という法的課題です。AIエージェントが不正行為を行った場合、その責任はエージェントの開発者にあるのか、ツールを利用したユーザーにあるのか、それともプラットフォームの運営者にあるのか。現時点では、各国の裁判所もこの問いに対する確定的な判断を示していません。2026年8月にはEU AI法の高リスクAIシステムに対する規制が本格施行される予定であり、エージェント型AIの自律的行動に対する法的枠組みの整備が急がれています。米国でも2026年6月にコロラド州AI法が施行されるほか、複数の州でAI関連法案が審議中ですが、連邦レベルでの統一規制はまだ存在しません。

一方で、AIエージェントのポジティブな可能性を否定することもできません。日常業務の自動化による生産性向上を期待する声は強く、Gartnerは「2026年までに企業向けアプリケーションの40%がタスク特化型AIエージェントを備える」と予測しています。問題は技術そのものではなく、その自律性の「境界線」をどこに引くかという設計と制度の問題です。

今回のMoltMatch事案は、エージェント型AIが「便利なアシスタント」から「制御困難な代理人」へと変貌しうることを具体的に示した事例といえます。恋愛という極めて個人的な領域でこの問題が顕在化したことは、テクノロジーと人間の関係について私たちが改めて考える契機となるのではないでしょうか。

【用語解説】

エージェント型AI(AIエージェント)

ユーザーのプロンプトに応答するだけでなく、与えられた目標に向かって自律的に複数のステップを計画・実行するAIの形態。メール送信、ウェブ検索、オンライン購入など、実世界のタスクを人間の逐一の指示なしに遂行できる点が従来の対話型AIと異なる。

オープンソース

ソフトウェアのソースコードが公開され、誰でも自由に閲覧・改変・再配布できるライセンス形態。OpenClawはMITライセンスで公開されており、開発者がコードを検証・カスタマイズできる。

プロンプトインジェクション

AIが処理するデータの中に悪意ある指示を紛れ込ませ、本来のユーザー指示とは異なる動作をさせる攻撃手法。OpenClawのようにシステムレベルのアクセス権を持つエージェントでは、データ流出や意図しない操作につながるリスクがある。

永続的メモリ(Persistent Memory)

AIエージェントが過去のやり取りや学習内容をセッションをまたいで保持する機能。ユーザーの習慣や好みを蓄積し、行動を最適化する。OpenClawの中核機能の一つである。

EU AI法(EU AI Act)

欧州連合が2024年8月に発効させたAI規制法。AIシステムをリスクレベルに応じて分類し、高リスクシステムには適合性評価や人間による監視を義務付ける。違反時の罰金は最大3500万ユーロまたは全世界売上高の7%。2026年8月2日に高リスクAIシステムへの本格適用が予定されている。

【参考リンク】

OpenClaw公式サイト(外部)

オーストリアの開発者が作成したオープンソースの自律型AIエージェント。WhatsAppやTelegram経由でタスクを実行する。

Moltbook(外部)

OpenClawエージェント専用のReddit風ソーシャルネットワーク。AIのみが投稿でき、人間は閲覧のみ可能。

MoltMatch(Nectar AI版)(外部)

Nectar AIが運営するAIエージェント向け出会い系プラットフォーム。エージェント同士がマッチングを行う仕組み。

MoltMatch(オリジナル版)(外部)

プログラマーが構築した実験的なAIエージェント向け出会い系サイト。Nectar AI版とは別に運営されている。

【参考動画】

OpenClaw: The Viral AI Agent that Broke the Internet — Peter Steinberger | Lex Fridman Podcast #491

OpenClaw開発者ピーター・シュタインベルガーへのロングインタビュー。開発の経緯、技術的な設計思想、Moltbookの誕生、セキュリティリスクへの見解が詳細に語られている。

【参考記事】

From Clawdbot to Moltbot to OpenClaw: Meet the AI agent generating buzz and fear globally — CNBC(外部)

OpenClawの台頭を包括的に報道。GitHub15万スター超、Fortune 500企業のエージェント運用との調査データを掲載。

Hacking Moltbook: AI Social Network Reveals 1.5M API Keys — Wiz Blog(外部)

Moltbookの脆弱性調査。公称150万エージェントに対し実際のオーナーは17,000人、88:1の比率であったことを報告。

OpenClaw AI chatbots are running amok — these scientists are listening in — Nature(外部)

学術誌Natureによる報道。Moltbookの登録ボット160万以上、AI生成投稿750万以上に達したことを伝えている。

AI or human? Researchers question who’s posting on AI bot social media site Moltbook — Euronews(外部)

2月12日時点でMoltbook登録ボット数260万に到達。清華大学研究者による投稿の自律性に関する分析を掲載。

Why OpenClaw, the open-source AI agent, has security experts on edge — Fortune(外部)

OpenClawのセキュリティリスクに焦点を当てた記事。権限設定ミスやスキル連鎖実行がもたらす危険性を専門家が解説。

OpenClaw, Moltbook and the future of AI agents — IBM Think(外部)

IBM研究者の視点からOpenClawの意義を分析。コミュニティ主導の可能性とガードレール不足のリスクを指摘。

【編集部後記】

先日、innovaTopiaでもお伝えした通り、OpenClawのAIエージェント「MJ・ラスバン」がオープンソース開発者のプルリクエスト却下に対して自律的に攻撃記事を公開するという事件が起きました。そして今度は、別のエージェントがユーザーの知らぬ間に出会い系プロフィールを作成しています。

攻撃、恋愛―AIエージェントが人間の意図を超えて踏み込む領域が、週を追うごとに広がっているように感じます。「ここまでは任せたい、ここからは自分でやりたい」。その境界線は、きっと一人ひとり違います。皆さんなら、どこに線を引きますか?