2026年2月16日、総務省の第29回AIガバナンス検討会において、「AI事業者ガイドライン」の令和7年度更新内容(案)が提示された。

今回の更新案は、AIエージェントやフィジカルAIといった新技術の定義追加、リスクベースアプローチの導入、RAGと機械学習の概念整理など、7つの論点にわたる包括的な見直しである。正式版(第1.2版)は2026年3月末に公開予定。本稿では、更新案の技術的要点とビジネスへの影響を、解説する。

From: ![]() 総務省 / 経済産業省 ― 第29回AIガバナンス検討会(令和8年2月16日開催)

総務省 / 経済産業省 ― 第29回AIガバナンス検討会(令和8年2月16日開催)

なぜ今、このガイドラインに注目すべきか

2026年2月16日、総務省の第29回AIガバナンス検討会において、「AI事業者ガイドライン」の令和7年度更新内容(案)が示されました。これは単なる既存ルールのアップデートではありません。生成AIによるチャットボットの「次」のフェーズ―AIが自律的に意思決定し行動する「AIエージェント」、そして現実世界に干渉する「フィジカルAI」の時代に向けた、国家レベルの戦略的な再定義といえます。

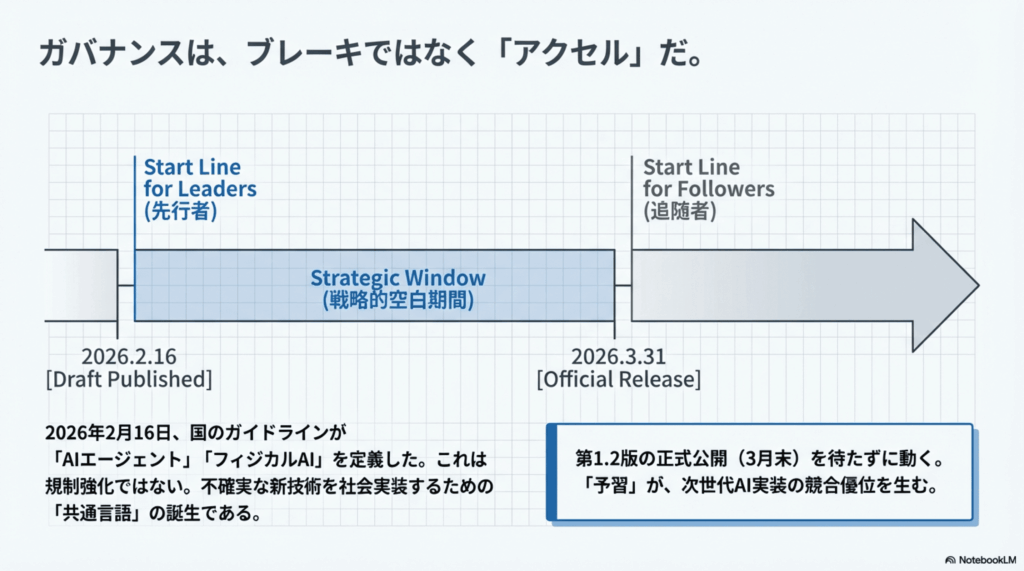

この更新案のポイントは、ガバナンスを「ブレーキ」ではなく「アクセル」として位置づけている点にあります。アーリーアダプターにとって、本ガイドラインは不確実性の高い新技術をビジネスに取り込むための「共通言語」であり、信頼を構築するための「ガードレール」です。更新内容を読み解くことは、「どこまで攻めてよいか」という境界線を正確に把握し、迅速な社会実装を実現するための第一歩となります。

正式版(第1.2版)は2026年3月末に公開が予定されています。最終確定前の今こそ、その方向性を先取りしておく価値があります。

更新案における技術的定義の注目点

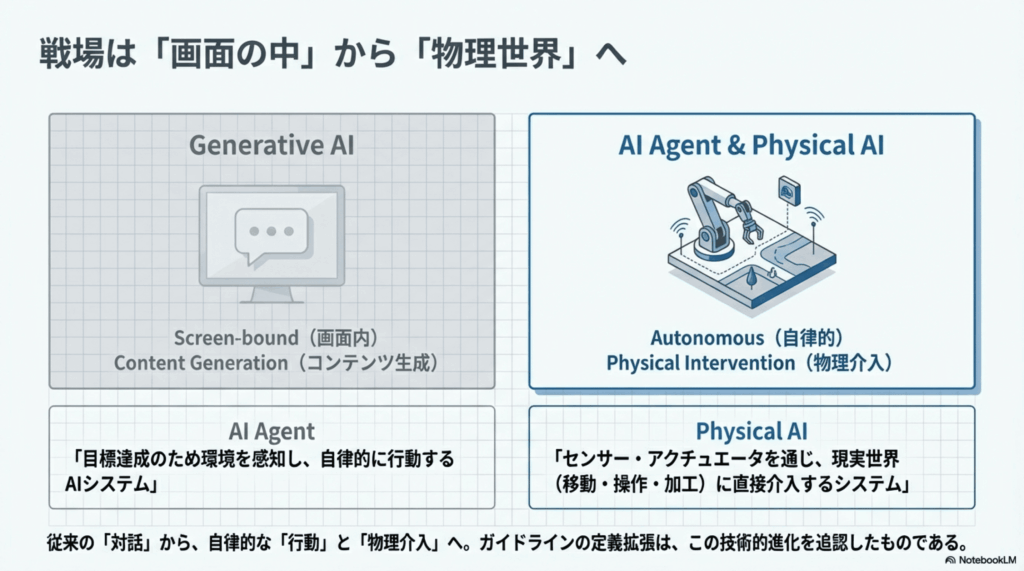

今回の更新案でとくに注目すべきは、AIの概念が従来のWeb完結型から「自律・物理連動型」へと明確に拡張された点です。

AIエージェントとフィジカルAIの公式定義

更新案では、AIエージェントとフィジカルAIの定義が新たに追加されました。AIエージェントは「特定の目標を達成するために、環境を感知し自律的に行動するAIシステム」と定義されています。フィジカルAIについては、センサーによるセンシングからAIモデルによる推論・判断を経て、アクチュエーター(駆動系)を介した物理的な行動へとつなげるシステムとして整理されました。サイバー空間での処理に留まらず、現実世界に対して直接的な働きかけ(移動、操作、加工など)を行うことがその特徴です。

これにより、ロボットやセンサーと連動するAIシステムの戦略的価値が、国のガイドラインにおいて公的に位置づけられたことになります。

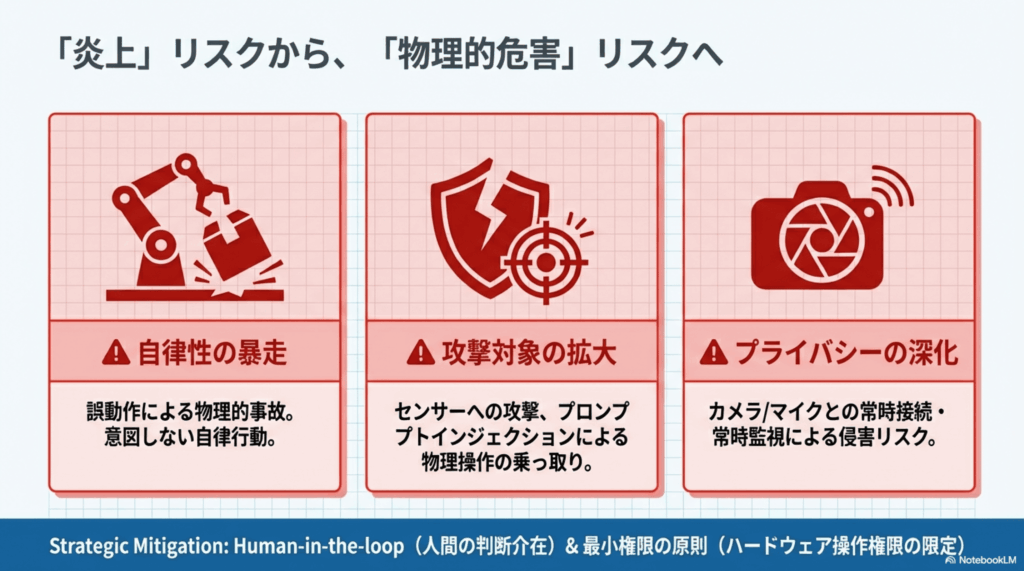

リスク次元の変化

現実世界と接続されることで、リスクの次元も変化しています。更新案では、自律的行動による誤動作や、攻撃対象・攻撃手法の増加、複雑な機構を持つことによる保守の困難化、カメラ等との連携によるプライバシー侵害の可能性といったリスクが新たに追加されました。

なお、先行する第28回検討会の資料では、プロンプトインジェクション攻撃やDoS攻撃(サービス拒否攻撃)といった具体的な攻撃ベクトルについても議論されています。物理的リスクと従来のサイバーリスクが交差する領域が拡大していることは、エンジニアにとって見逃せないポイントです。

対策として、ガイドラインでは人間の判断を必須化する仕組みの構築や最小権限設定、ハードウェアに残存するデータへの配慮といった留意事項が追加されています。

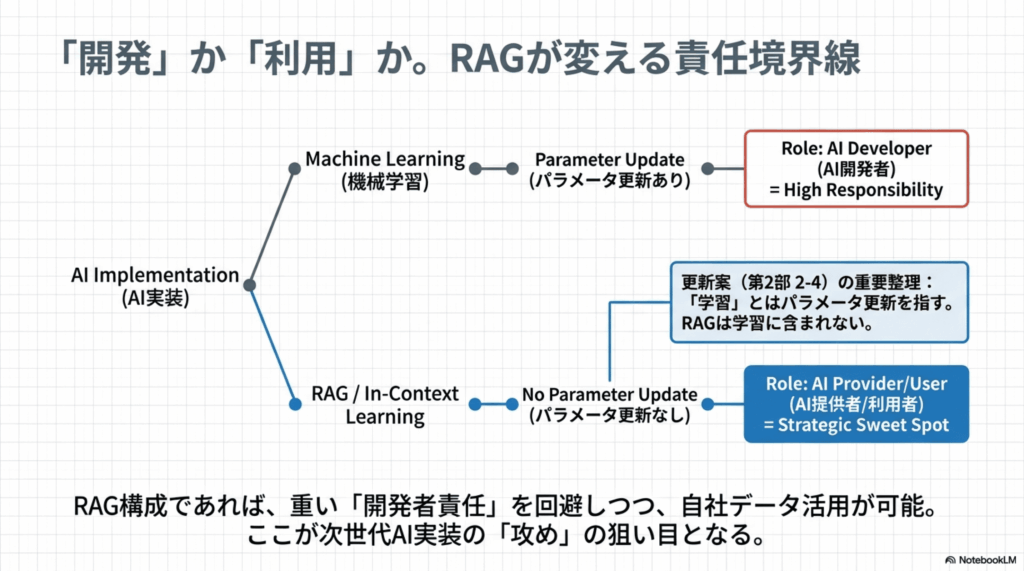

戦略的境界線:RAGと学習の峻別

ビジネスサイドにとって大きな意味を持つのは、「学習」や「推論」といった多義的な用語の定義が整理された点です。とくに、RAG(検索拡張生成)やIn-Context Learning(文脈内学習)が、従来の「機械学習(パラメータ更新)」と明確に区別して整理されました。

この整理の戦略的意義は明確です。RAGはモデルそのものを更新しないため、開発コストと規制対応の摩擦を最小限に抑えつつ、自社データに基づいた高度なAI実装を可能にします。これにより、多くの事業者は重い「AI開発者」としての義務を負うことなく、「AI提供者」としての責任管理に注力することで、迅速な市場投入が可能になります。この境界線の理解こそが、エンジニアリングとマネジメントを融合させる「攻め」の定石です。

なお、政府はガイドラインの難解さを解消するため、事業者向けの「活用ガイド」(経済産業省)やルールベースの「チャットボット」(総務省)の提供を予定しており、2026年度末を目途にリリースされる見込みです。

日本型AIガバナンスの骨格と「3つの主体」

日本のAIガバナンスは、法的拘束力のない「ソフトロー」を基盤とした「アジャイル・ガバナンス」を提唱しています。技術進化に合わせてルールを柔軟に更新する「Living Document(生きた文書)」としての性質は、試行錯誤を繰り返すアーリーアダプターにとって、法規制のタイムラグに縛られない有力な枠組みとなります。

ガイドラインでは、プレイヤーを以下の3つの主体に分類しています。自社のプロジェクトがどこに該当するかを把握することが、リスク管理の第一歩です。

AI開発者:AIモデルやシステムを構築する事業者。データの適正学習(前処理・検証)、安全性・公平性の設計、検証可能性(ログ保存)の確保が主な役割です。

AI提供者:AIを製品・サービスに組み込み提供する事業者。活用環境への適合性確認、適切な利用方法の周知、脆弱性・インシデントへの対応が求められます。

AI利用者:事業活動においてAIを利用する事業者。適正な入力(プロンプト等)の管理、人間による最終的な意思決定(Human-in-the-loop)が重要な責務となります。

注意すべき点として、RAGシステムの構築やファインチューニングを行う企業は、形式的に「利用者」であっても、実質的には「提供者」や「開発者」の責任を併せ持つことになります。今回の更新案では、アライメントやRAG等について、どの主体区分が役割を担うか不明瞭だった箇所に補足説明が追加されました。この多面的な役割を理解しておくことが、予期せぬ法的・倫理的リスクを回避する鍵となります。

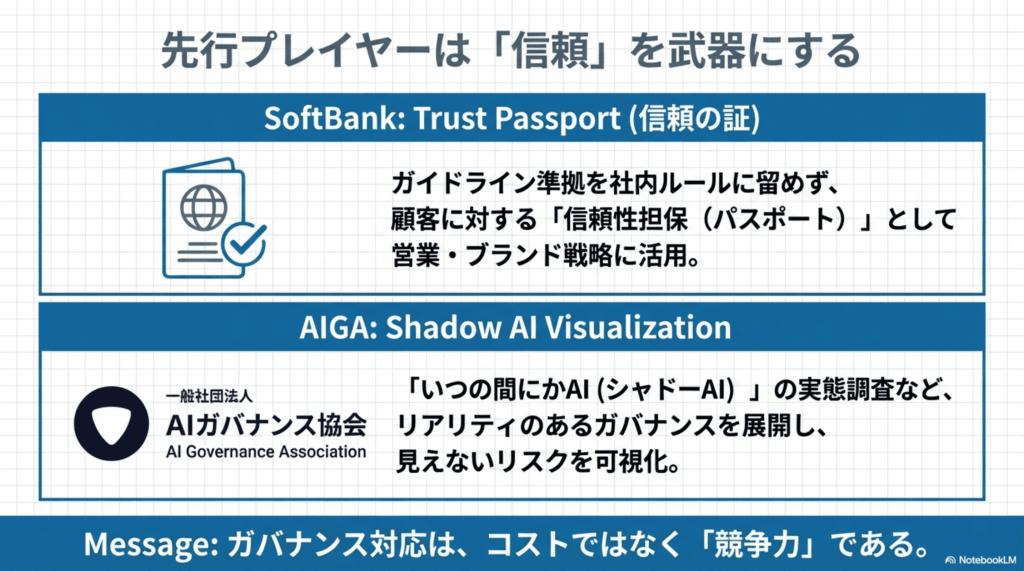

先行プレイヤーはいかにして「信頼」を競争力に変えているか

ガバナンスを形式的な遵守(コンプライアンス)ではなく、経営の「エンジン」として活用している企業の取り組みを見てみましょう。

ソフトバンク:ガイドラインを「リスク対策」と「リテラシー向上」の両輪で活用

2月16日の検討会で、ソフトバンクのAIガバナンス推進室長・浦野憲二氏が同社の活用事例を発表しました。ソフトバンクは、ガイドラインを単なる参照文書ではなく、組織の意思決定プロセスに深く組み込んでいます。

同社の活用は「リスク対策」と「リテラシー向上」の2カテゴリで構成されています。リスク対策面では、ガイドラインの評価軸に基づくAI倫理ポリシー・社内規程の整備(ルール)、AI案件のチェックシートへの反映(オペレーション)、社内AIガバナンス検討会議における開発者・提供者・利用者の視点整理(判断軸)、そしてリスクベースアプローチに基づく継続的改善の監査プロセスへの導入(内部監査)という4つの柱があります。

リテラシー向上面では、経営層向けにAIガバナンスが「経営課題」である理由を説明する取り組み、全社員向けのe-learning・勉強会、お客様との議論においてビジネス上の信頼性を担保するための活用、そして自部署における他社の実践事例の研究という4つの取り組みが報告されています。

とくに注目すべきは、ガイドラインを「お客様との信頼性担保」のツールとして積極的に活用している点です。日本の公式ガイドラインに基づく設計であることを顧客に示すことが、ビジネス上の競争力に直結するという発想は、ガバナンスを「攻め」の武器にする好例といえます。

AIGA(AIガバナンス協会)の実装ソリューション

同じく2月16日の検討会では、AIガバナンス協会(AIGA)からも活用事例が発表されました。AIGAは「AIガバナンスナビ」による組織の成熟度診断や、許可なく利用される「シャドーAI」の調査手法など、実地での実装ソリューションを展開しています。リソースを最適化しながらリスクを低減する「賢いガバナンス」の実践例として参考になります。

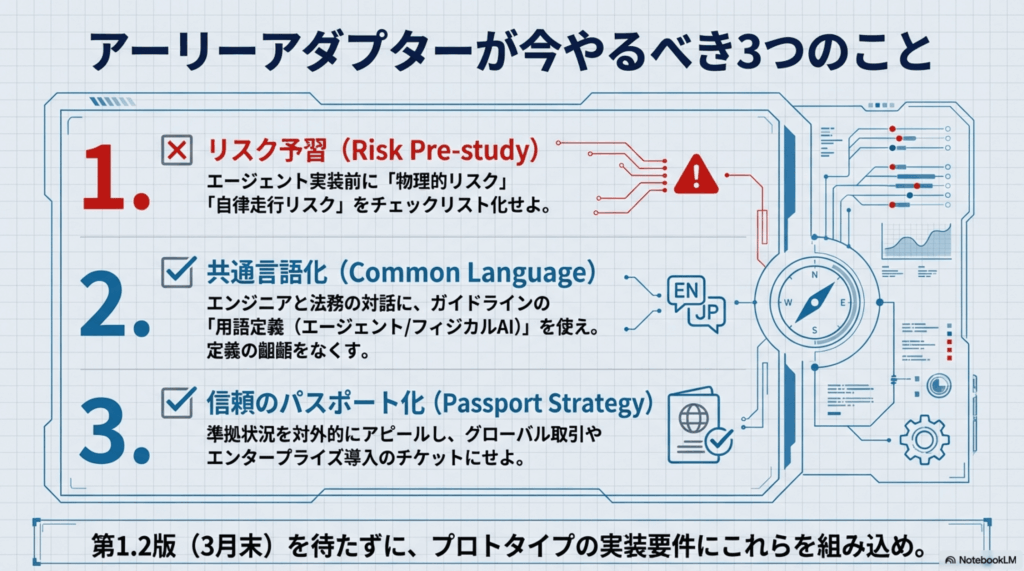

今着手すべき3つのアクション

今回の更新案は、広島AIプロセスとも連動した国際基準への対応強化を含んでおり、「世界で最もAIを活用しやすい国」を目指す日本の方向性がより鮮明になっています。以下の行動を検討してみてください。

1. AIエージェント実装前の「リスク予習」

自律的なアクションを伴うシステムを導入する前に、エージェント特有のリスク(物理的危害、予期せぬシステム連携)を先行してリストアップしておくことをお勧めします。ガイドライン別添の「チェックリスト」は、そのままプロジェクトの品質基準として機能します。

2. 部門横断の「共通言語」化

エンジニア、法務、経営層が会話する際の土台としてガイドラインを活用してみてください。「RAG導入は提供者責任に留まる」といった共通理解が、意思決定のスピードを向上させます。

3. 信頼の「パスポート」化

広島AIプロセスに基づくOECD報告枠組みへの参加や本ガイドラインへの準拠は、グローバルな取引における「安全・安心・信頼」の証明書となりえます。国際的な信頼の枠組みが強化されつつある今、早期に準拠を進めておくことが有利に働きます。

ガバナンスを「ブレーキ」から「アクセル」へ。それこそが、AIエージェント・フィジカルAI時代における真の競争優位の条件ではないでしょうか。

【用語解説】

AIエージェント

特定の目標を達成するために、環境を感知し自律的に行動するAIシステム。今回の更新案でガイドライン上の定義が新設された。

フィジカルAI

センサーによるセンシングを通じて物理環境の情報を取り込み、AIモデルによる処理を経て、アクチュエーター等を介して物理的な行動へとつなげるシステム。サイバー空間の処理に留まらず、現実世界への直接的な働きかけを行う点が特徴。

RAG(検索拡張生成)

Retrieval-Augmented Generationの略。AIモデル自体のパラメータを更新(学習)することなく、外部データベースから関連情報を検索・取得し、生成時の文脈として与える手法。今回の更新案で機械学習と明確に区別された。

In-Context Learning(文脈内学習)

プロンプトに例示やコンテキストを含めることで、モデルの振る舞いを一時的に変化させる手法。パラメータの更新を伴わない点でRAGと同様に整理された。

アジャイル・ガバナンス

技術や社会の変化に合わせてルールを柔軟に更新していくガバナンスの考え方。本ガイドラインが「Living Document」として継続的に更新される設計思想の基盤。

リスクベースアプローチ

リスクの大きさや発生可能性等を加味して対策の優先順位を検討する考え方。今回の更新案で説明が追加された。

Human-in-the-loop

AIの判断プロセスに人間が介在し、最終的な意思決定を人間が担う設計原則。とくにAIエージェントの導入時に重視される。

シャドーAI

組織内で許可なく利用されるAIツールやサービスのこと。AIGAが調査手法を提供している。

【参考リンク】

総務省 第29回AIガバナンス検討会 配布資料一覧(2026年2月16日開催)

総務省・経済産業省「AI事業者ガイドラインの令和7年度更新内容(案)」資料5(PDF)

総務省「令和7年度 今後の活動スケジュール」資料1(PDF)

ソフトバンク株式会社「AI事業者ガイドライン活用事例」資料4-1(PDF)

AIガバナンス協会「AI事業者ガイドライン活用事例」資料4-2(PDF)

総務省・経済産業省「AI事業者ガイドライン(第1.1版)概要」(2025年3月28日公表)

AIガバナンス協会「AIガバナンス行動目標」― AIガバナンスナビ等の実装ツール

【編集部後記】

「ガバナンスはブレーキではなくアクセル」―今回の更新案を貫くこのメッセージは、AIの社会実装を加速させたい事業者にとって力強いものです。

とくに印象的だったのは、ソフトバンクの浦野氏が示した活用事例です。ガイドラインをお客様との「信頼の共通言語」として使いこなしている姿は、ガバナンスが営業の現場にまで浸透しうることを示しています。

第1.2版の正式公開は2026年3月末。その前に「活用ガイド」やチャットボットも用意されるとのことで、中小企業や地方自治体にとっても手に取りやすい環境が整いつつあります。

AIエージェントが自律的に行動する時代、「どこまで任せ、どこで人間が判断するか」という問いは、技術の問題であると同時に、経営の問題でもあります。このガイドラインが、その問いに向き合うための羅針盤になることを期待します。

を読み解く.png)