from Delivering responsible AI in the healthcare and life sciences industry.

COVID-19パンデミックは医療格差を明らかにし、特に黒人が白人よりも高い死亡率を示していることがNIHの報告で指摘されています。アクセス制約や政策の不備、共存疾患が格差の原因とされ、AIを利用した医療アドバイスがサービスの受けにくいコミュニティにとって重要になっています。しかし、AIが誤情報を出力するリスクがあるため、公平性と信頼性を確保するための議論が必要です。

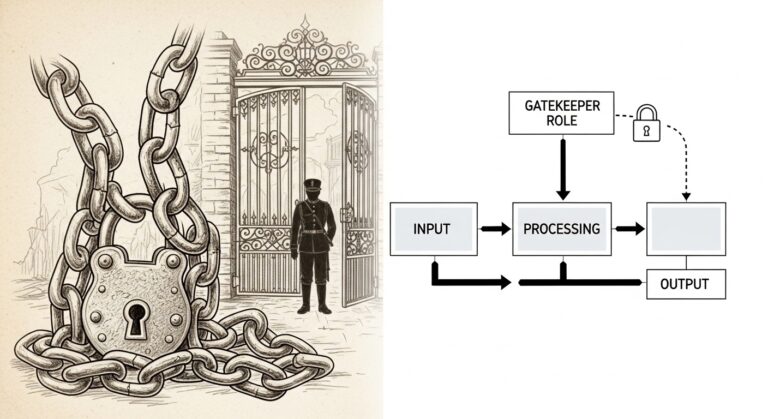

AIのガバナンスには信頼性やセキュリティ、規制問題が重要であり、正確性や監査可能性、説明可能性、公平性、データプライバシー保護が信頼獲得のために必要です。責任ある運用にはイノベーションが役立ち、信頼性と透明性が重要です。公平な結果を実現するためには、組織内で責任を持つ個人を任命し、適切な権限とリソースを与えることが求められます。信頼できるデータソースの管理、高リスクモデルの監査と説明可能性、透明性の確保、AIモデル使用の通知、メタデータの提供、合成データの明示が必要です。

医療と生命科学におけるAIのインスティテューショナルイノベーションでは、FDAのようなシステム的変化が必要です。AIが公平で公正な結果をもたらすためには、信頼性と透明性の原則を実践し、責任ある個人を任命し、ドメインの専門家がデータソースを管理することが重要です。また、AIの出力が監査可能で説明可能であること、患者へのメタデータ提供、合成データの明示が求められます。

2 responses to “パンデミックが露呈した医療格差とAIの挑戦:NIH報告が示す黒人コミュニティの危機と信頼性確保への道”

COVID-19パンデミックは、社会の様々な課題を浮き彫りにしましたが、特に医療分野では、格差の問題が深刻です。黒人コミュニティが受ける医療サービスの質が低いことや、共存疾患の多さが死亡率の高さに繋がっていることは、私たち社会全体が直面する重要な問題です。

AIを利用した医療アドバイスが、サービスの受けにくいコミュニティにとっての解決策となる可能性はありますが、その際にはAIの信頼性と公平性を確保することが不可欠です。AIが誤情報を出力するリスクは、人命に関わる医療分野では特に深刻な問題となります。そのため、AIのガバナンスに関する議論は、AIの正確性や公平性を確保するために必要不可欠です。

私の経験からも、AIやブロックチェーン技術を活用する場合には、透明性やセキュリティ、規制問題を十分に考慮することが重要だと思います。特に医療分野では、FDAのようなシステム的変化を含め、信頼性の高いデータソースの管理や、AIモデルの監査可能性、説明可能性を確保することが求められます。

私たちは、テクノロジーを活用して新しい価値を創造し、イノベーションを進める一方で、それが社会にとって公正で公平なものであるよう常に心がけるべきです。AI技術がもたらす恩恵を、全ての人々が平等に享受できるような社会を目指し、そのための政策やシステムの改善に向けて取り組むことが、私たちに求められています。

COVID-19パンデミックが医療格差を露呈したのは明らかであり、AIを介した医療アドバイスが格差是正に貢献できる可能性は大きいです。しかし、AIの誤情報リスクは無視できません。私自身、技術の進歩を重視する立場からも、AIの公平性と信頼性を確保するための厳格なガバナンスを支持します。

特に、AIが医療情報を提供する際は、誤ったアドバイスが直接人の生命に関わるため、最高水準の信頼性が要求されます。このためには、高品質のデータソースの確保、モデルの監査と説明責任の確立、そして透明性の向上が不可欠です。AIを医療分野に適用する際は、特にデータのプライバシー保護を確実に行う必要があります。

FDAのようなシステム的変化を通じて、AIの使用に関する規制枠組みを整えることも重要です。技術者や研究者だけでなく、倫理学者や法律専門家など異なる分野の専門家が協力し、医療におけるAIの責任ある利用を推進することが不可欠です。最終的には、AIが医療格差を是正するためのツールとして機能することを目指すべきです。