Metaは2026年3月11日、Facebook、Messenger、WhatsAppに新たな詐欺対策ツールを導入すると発表した。2025年にはポリシー違反として1億5,900万件の詐欺広告を削除し、うち92%は報告前に対処した。FacebookおよびInstagramで詐欺センターに関連する1,090万件のアカウントを停止した。

FBI、DOJのScam Center Strike Force、タイ王国警察ACSCとの合同摘発週間では15万件以上のアカウントを無効化し、21件の逮捕に貢献した。ナイジェリアでもNigeria Police ForceおよびUK National Crime Agencyとの連携で7名を逮捕した。MetaのFIREを通じてロマンス詐欺に関連する1万5,000件以上の資産を削除した。広告主の本人確認を拡大し、2026年末までに認証済み広告主による広告収益の割合を現在の70%から90%に引き上げることを目標とする。

From: ![]() Fighting Scammers and Protecting People with New Technology and Partnerships

Fighting Scammers and Protecting People with New Technology and Partnerships

【編集部解説】

今回のMetaによる発表は、単なる機能アップデートとして読むべきではありません。その背景には、2025年11月にReutersが報じた衝撃的なリーク情報があります。Metaの内部文書によると、同社は2024年の広告収益の約10%、金額にして約160億ドル相当が詐欺広告や禁止品の広告から生じると内部試算していたとされています。Metaはこの数値を「大まかで過大な見積もり」と反論しましたが、この報道は世界中で大きな波紋を呼びました。今回の大規模な詐欺対策発表は、そのような批判への応答という側面も持っています。

今回導入された技術の核心は、AIによる「多シグナル分析」です。従来の検知システムがテキストや画像を個別に判断していたのに対し、新しいシステムはテキスト・画像・アカウントの文脈情報を同時に処理します。たとえばなりすましの検知では、偽のファン感情の分布、プロフィールの不整合、公人との不自然な関連づけなど、人間の目では見落としがちな複合的シグナルを瞬時に評価します。これにより、巧妙に偽装された詐欺アカウントを検出できる可能性が大幅に高まります。

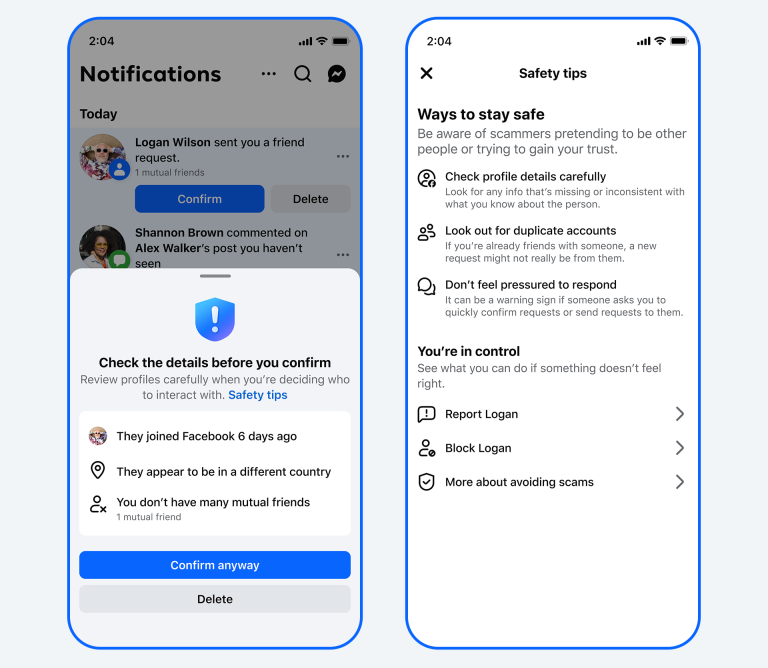

注目すべき点は、Messengerの詐欺検知機能の設計思想です。Metaや各種技術レポートによれば、最初の怪しいパターン検知はオンデバイスで行われ、この段階ではメッセージはE2EEのまま保護されています。その後、ユーザーがAIによる追加レビューを選択すると、選んだメッセージがMeta側のサーバーに送信され、その分については「AIと共有されたメッセージはもはやエンドツーエンド暗号化ではない」とMeta自身が説明しています。この「オプトイン方式」は、プライバシーと安全性のトレードオフを明示的にユーザーに委ねる設計です。

WhatsAppのデバイスリンク警告も見逃せない機能です。QRコードやリンクコードを使って被害者のアカウントを乗っ取る手口は、日本でも増加傾向にある詐欺の典型パターンです。行動シグナルから不審なリンク要求を検知し、事前に警告するこの機能は、実害が発生する前の「介入」を実現するものです。

法執行機関との連携という点では、今回の発表は「プラットフォーム企業による自主規制」から「国境を越えた官民共同捜査」への明確なシフトを示しています。FBI・タイ王国警察・ナイジェリア警察・英国National Crime Agencyとの連携は、詐欺が一国内の問題ではなく、東南アジアや西アフリカを拠点とする組織的な産業となっている現実への対応です。

一方で、潜在的なリスクも存在します。AIによる詐欺判定は誤検知の可能性を常に伴い、正当なアカウントが不当にブロックされるリスクがあります。また広告主の本人確認を70%から90%へ引き上げる目標は、個人事業主や中小規模の広告主にとって新たな参入障壁になりかねません。さらに、こうした対策が高度化するほど、詐欺師たちも手口を洗練させてくるという「いたちごっこ」の構造は変わりません。

規制の観点からも、今回の発表は重要な意味を持ちます。EUのDigital Services Act(DSA)やオーストラリアのOnline Safety Actなど、プラットフォームに詐欺対策の実効性を求める法規制は世界的に強まっています。Metaが今回、具体的な数字と施策を伴う報告を公開したのは、規制当局へのアカウンタビリティを示す側面もあるでしょう。

長期的に見れば、今回のような「AIと人間と法執行機関の三位一体」による詐欺対策の枠組みは、業界スタンダードになる可能性があります。Metaの取り組みが成果を示せば、他のプラットフォームへの波及効果も期待できます。「詐欺のない安全なデジタル空間」は理想論ではなく、AIとパートナーシップによってその実現可能性が着実に高まっているといえます。

【用語解説】

FIRE(Fraud Intelligence and Reciprocal Exchange)

Metaが運営する詐欺情報の相互共有プログラム。プラットフォームや法執行機関が持つ詐欺関連シグナルを双方向で交換・活用することで、単独では検知しにくい組織的詐欺を横断的に摘発する仕組みである。

E2EE(エンドツーエンド暗号化)

送信者と受信者のデバイス間でのみメッセージを復号できる暗号化方式。通信の途中にあるサーバーやプラットフォーム運営者でも内容を読めないため、高いプライバシー保護を実現する。MessengerやWhatsAppで標準採用されているが、今回のAIスキャン審査に同意した場合はこの暗号化が一時的に解除される。

セレブ・ベイト(Celeb-Bait)

著名人や公人の名前・顔・ブランドを無断で使い、投資詐欺や偽商品販売などへ誘導する手口。SNS上で急速に拡散しやすく、被害規模が大きくなりやすい詐欺形態の一つである。

Digital Services Act(DSA)

EUが2022年に成立させたデジタルサービス規制法だ。大規模プラットフォームに対し、違法コンテンツや詐欺広告の迅速な削除、リスク評価の公開、第三者機関による監査などを義務づけている。違反した場合、全世界年間売上高の最大6%の制裁金が科される可能性がある。

詐欺センター(Scam Center)

主に東南アジアや西アフリカに拠点を置く、組織的なオンライン詐欺の拠点施設。人身売買で集めた労働者を強制的に働かせ、ロマンス詐欺・投資詐欺・フィッシングなどを大規模かつ産業的に展開する。今回の摘発作戦はその中核組織を標的としている。

【参考リンク】

Meta Newsroom|Fighting Scammers and Protecting People(外部)

Metaによる詐欺対策ツール発表の公式原文記事。今回のすべての施策の一次ソースだ。

Meta Safety Center|詐欺対策ハブ(外部)

MetaのAI詐欺対策の全体像とユーザー向け安全利用ガイドをまとめた公式ページだ。

FBI|米国連邦捜査局(外部)

今回の合同摘発週間に参加した米国の連邦法執行機関。国際詐欺の捜査でMetaと連携する。

UK National Crime Agency|英国国家犯罪捜査局(外部)

ナイジェリアの詐欺センター摘発でMetaと協力した英国の主要法執行機関だ。

Reuters|ロイター通信(外部)

2025年11月、Metaの詐欺広告収益に関する内部文書スクープを報じた国際通信社だ。

【参考記事】

CNBC|Meta reportedly projected 10% of 2024 sales came from scam, fraud ads(外部)

Metaが2024年広告収益の約10%、約160億ドルが詐欺広告由来と内部試算していたと報じたCNBCの記事だ。

Yahoo Finance|Leaked Documents Unveil Meta’s $16 Billion Revenue Projection From Scam Ads(外部)

1日150億件の高リスク広告と70億ドルの詐欺広告収益を示す内部文書リークを詳報した記事だ。

The Record|Meta says it culled millions of scam ads amid accusations that it profits from them(外部)

今回の発表をReutersの過去調査と並べ、詐欺センターの人身売買問題も含め公平に分析した記事だ。

The Next Web|Meta rolls out new scam detection across WhatsApp, Messenger, and Facebook(外部)

AIレビュー同意時にE2EEが解除される仕組みなど、プライバシーと安全性のトレードオフを詳述した記事だ。

TechCrunch|Meta rolls out new scam detection tools to Facebook, WhatsApp, and Messenger(外部)

新機能の仕組みとユーザー体験フローをわかりやすくまとめたTechCrunchによる詳細レポートだ。

Malwarebytes|Meta boosts scam protection on WhatsApp and Messenger(外部)

デバイス上検知とクラウドAI審査の二段階構造およびE2EE解除の仕組みを技術的に解説した記事だ。

【編集部後記】

詐欺との戦いは、AIと法執行機関の連携によって新たなフェーズに入りつつあります。でも私たちが気になるのは、「安全」と「プライバシー」のバランスをどう捉えるか、という問いです。

AIに会話を見せることをどこまで許容できるか——みなさんはどうお考えでしょうか?