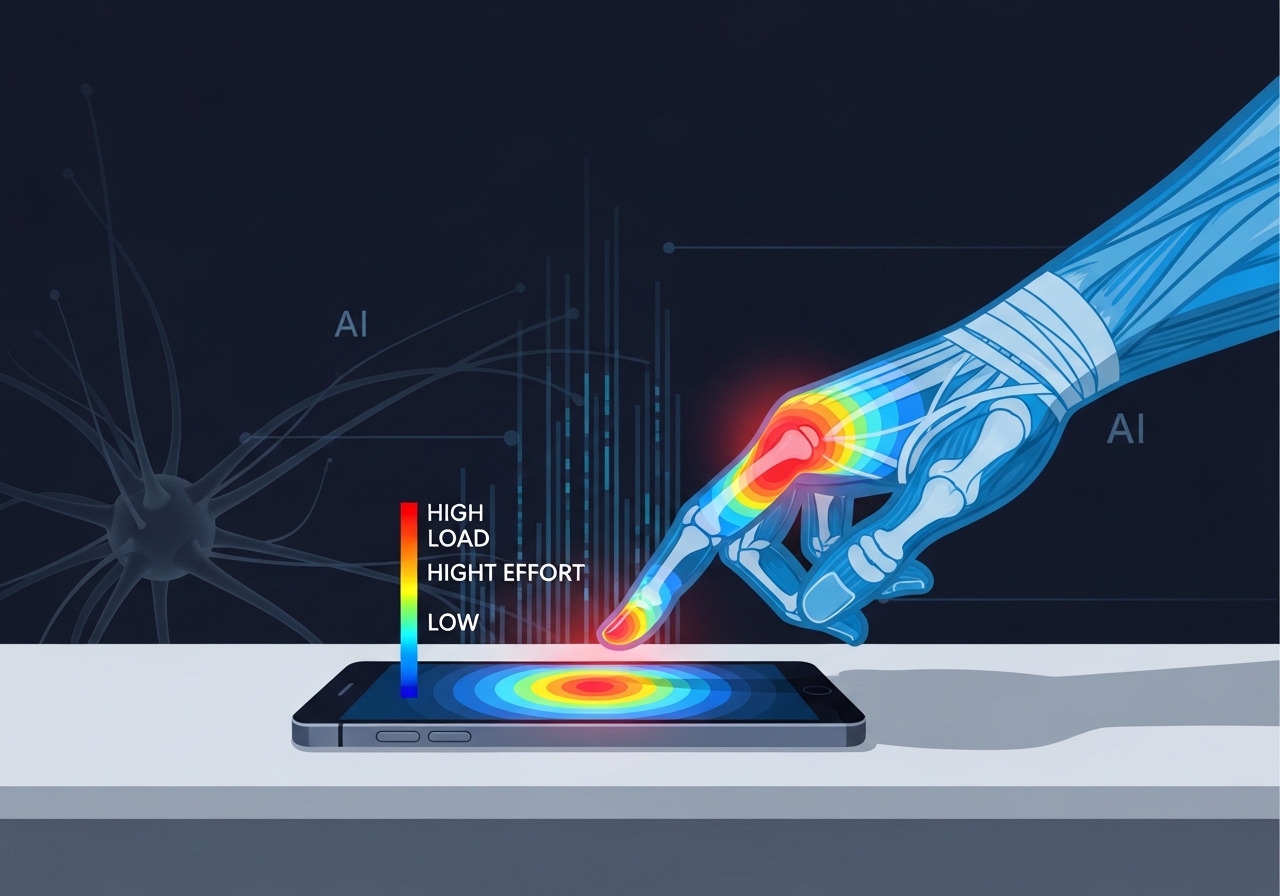

Aalto大学とライプツィヒ大学の研究者らは、スマートフォンのタッチログを人体の筋骨格シミュレーションに変換するAIモデル「Log2Motion」を開発した。同モデルはデジタルの骨と筋肉で構成された人体モデルを用いて、指の動き・速度・精度・身体的負荷を推定する。

上下方向のスワイプや画面角付近の操作は負荷が高いことが確認された。ライプツィヒ大学とAalto大学の共同研究チームによって開発され、Aalto大学教授のアンッティ・オウラスヴィルタ氏が共著者として参加している。

論文「Log2Motion: Biomechanical Motion Synthesis from Touch Logs」は2026年4月17日にヒューマン・コンピューター・インタラクション分野の学会「CHI 2026」で発表された。

論文はarxiv.orgにて2026年1月27日より公開されている(DOI: 10.1145/3772318.3790773)。

From: ![]() Tired of swiping? Now an AI simulation helps us understand why

Tired of swiping? Now an AI simulation helps us understand why

📋 編集部注(2026年4月20日更新):Log2Motionが生まれた背景にある大型研究プログラム「Artificial User」(ERC Advanced Grant、2024〜2029年)の情報と、研究者本人によるスケールアップ発言を追記しました。

【編集部解説】

スマートフォンを長時間使うと手や腕が疲れる——そんな「当たり前の感覚」を、これまで科学は定量的に捉えられていませんでした。画面のタッチログはあくまで「どこを触ったか」を記録するだけであり、その操作がどれだけの筋肉負荷を生んでいたかは、ブラックボックスのままだったのです。

Log2Motionが解決したのは、まさにその空白です。技術的な核心は「強化学習(Reinforcement Learning)による筋骨格フォワードシミュレーション」にあります。これは、AIエージェントが試行錯誤しながら人間の筋肉活動パターンを学習し、タッチログから生体力学的に妥当な動作シーケンスを生成する仕組みです。人体モデルには「MyoSuite」というリアルな腕のシミュレーションモデルが採用されており、物理シミュレーターとソフトウェアエミュレーターを直結させた点が最大の技術革新といえます。

研究の主な成果は、「縦方向のスワイプ(上下・下上)」や「画面四隅の小さなアイコン」が特に身体的負荷が高いという発見です。これはUIデザイン上の示唆として非常に具体的で、実践に直結します。さらに注目すべきは、このツールが大規模なユーザー調査を実施しなくとも、UIプロトタイプのログだけで人間工学的な評価指標(疲労・エラー確率など)を推定できる点です。

影響が及ぶ範囲は、スマートフォンアプリのデザインにとどまりません。振戦(手の震え)のある方、筋力が低下した高齢者、義肢を使用するユーザーのアクセシビリティ評価にも応用できます。また将来的にはスマートフォンに限らず、タブレットやウェアラブルデバイス、さらにはソファでくつろいで寝転びながら片手操作するシナリオなど、多様な姿勢・状況へのスケールアップも研究者たちは視野に入れています。

一方、潜在的なリスクとして注視すべきなのは、「大規模ログからの身体動作の推定」という性質そのものです。ユーザーが意識しないうちに収集されたタッチログから、筋肉の使い方や身体的特性が推定できるとなれば、プライバシーの観点から新たな議論が生まれる可能性があります。EUでは「European Accessibility Act」が2025年6月に施行されており、デジタル製品のアクセシビリティ基準は今後さらに厳格化される方向です。Log2Motionのような客観的評価ツールは、その基準を満たすための根拠を提供できる反面、評価基準の策定や責任の所在という規制面での課題も浮上するでしょう。

長期的には、このシミュレーションが他のAI技術と組み合わされることで、個人の身体特性に合わせてUIを動的に最適化する「パーソナライズドUI」の実現が見えてきます。「使いやすい」という感覚を科学的・定量的な根拠で設計できる時代は、確実に近づいています。

【2026年4月20日 追記】

Log2Motionは、単独の研究成果にとどまらず、欧州研究会議(ERC)のAdvanced Grantによって支援された5年間の研究プログラム「Artificial User」(2024〜2029年、約250万ユーロ)の一環として生まれた成果です。このプログラムはオウラスヴィルタ教授が主導し、AIが人間の行動・認知特性を深く理解するための「人工的なユーザーモデル」の構築を目指しています。Log2Motionの筋骨格シミュレーションは、その方法論的な核を担う技術のひとつです。今後5年間にわたって同じ研究基盤から派生する成果が蓄積されていくと見られ、UIエルゴノミクス研究の継続的な進展が期待されます。

【用語解説】

筋骨格シミュレーション(Musculoskeletal Simulation)

デジタル上に骨・腱・筋肉を再現した人体モデルを用いて、人間の動作や筋肉の活動パターンをコンピューター上で物理的に模擬する技術だ。実際の被験者実験を行わずに身体的な負荷や運動特性を推定できる。Log2Motionでは63の筋腱ユニットで構成されたmyoArmモデルが採用されている。

強化学習(Reinforcement Learning)

AIが試行錯誤を繰り返しながら、報酬を最大化する行動パターンを自律的に学習する機械学習の手法だ。Log2Motionでは、タッチログに整合する筋肉の活動パターンをAIが探索・学習するために用いられている。

モーションキャプチャー

人体の動きをセンサーやカメラで記録し、デジタルデータとして取得する計測技術だ。Log2Motionの生体力学的シミュレーションの妥当性検証に、過去のモーションキャプチャー研究のデータが活用されている。

エルゴノミクス(人間工学)

人間の身体的・認知的特性に合わせて、道具や環境を設計する学問分野だ。UIデザインにおいては、操作の疲労度やエラー発生率を低減することを目的とした設計指針として参照される。

European Accessibility Act(EAA)

EU全域のデジタル製品・サービスに対してアクセシビリティ基準の遵守を義務付けるEUの法令であり、2025年6月に施行された。スマートフォンアプリやWebサービスの提供者にも適用対象が広がっている。

モーターノイズ(Motor Noise)

人間の動作には自然なばらつきや微細な誤差が伴うが、これを「モーターノイズ」と呼ぶ。Log2Motionはこの人間的な不完全性もシミュレーションに組み込んでおり、より現実に近い動作の再現を実現している。

【参考リンク】

Aalto University(アアルト大学)(外部)

フィンランド・エスポーに本拠を置く理工系大学。テクノロジーとデザインの融合を特色とし、HCI分野でも国際的に高い研究実績を持つ。

Log2Motion 原著論文(arXiv)(外部)

筋骨格フォワードシミュレーションの手法・実験設計・検証結果など、Log2Motionの技術的な詳細が記載されたプレプリント論文。2026年1月27日公開。

CHI 2026(ACM Conference on Human Factors in Computing Systems)(外部)

HCI分野で最も権威ある国際学会。2026年はスペイン・バルセロナで開催。Log2Motion論文は4月17日に発表される。

MyoSuite(Meta AI × University of Twente)(外部)

Meta AIとトゥウェンテ大学が共同開発したオープンソースの筋骨格シミュレーションフレームワーク。Log2MotionはmyoArmモデルを基盤として採用している。

ELLIS Institute Finland(外部)

欧州AI・機械学習研究ネットワーク「ELLIS」のフィンランド拠点。アンッティ・オウラスヴィルタ教授の研究活動拠点のひとつ。

【参考記事】

AI model simulates smartphone muscle effort, revealing which gestures are most tiring(TechXplore)(外部)

Log2Motionを独自取材で報じた科学メディアの記事。筆頭著者・研究の具体的知見・技術的背景をわかりやすく解説。2026年4月12日公開。

Scientists Figured Out What Endless Scrolling Is Really Doing to Your Body(VICE)(外部)

63の筋腱ユニットによるAI腕モデルの詳細と、モーターノイズをシミュレーションに組み込む手法を詳述した記事。2026年4月15日公開。

Tired of swiping? Now an AI simulation helps us understand why(EurekAlert!)(外部)

Aalto大学プレスリリースをベースに研究の背景・概要・将来展望をまとめた科学ニュース。研究者コメントの原文も収録。2026年4月12日公開。

Log2Motion paper – CHI 2026(LinkedIn / Patrick Ebel)(外部)

共著者パトリック・エーベル氏による投稿。強化学習×MyoSuite採用・Android-in-the-Wildデータセットでの検証など技術的補足情報を確認できる。2026年2月6日公開。

UT and Meta AI create digital humans that learn complex movements(University of Twente)(外部)

Log2Motionが採用するMyoSuiteの開発背景を解説。OpenSim比で最大4,000倍高速という性能が確認できる。2022年5月公開。

Antti Oulasvirta receives ERC Advanced Grant for Artificial User research(Aalto University)(外部)

Log2Motionが属する5年間の研究プログラム「Artificial User」(ERC Advanced Grant、2024〜2029年)の概要と研究者本人の解説。約250万ユーロの助成のもと、AIが人間行動をどのようにモデル化するかを探る。2024年4月公開。

【関連記事】

アアルト大学が開発、人間のようにタイピングする新技術

同じアンッティ・オウラスヴィルタ教授が主導し、CHI 2024で発表されたタイピングシミュレーション研究。人間のような打ち間違いや訂正プロセスを再現するAIモデルを開発した。Log2Motionへと続く、Aalto大学HCI研究ラボの系譜を知ることができる。

【編集部後記】

あなたは今日、スマートフォンを何回スワイプしましたか? その何気ない動作が、実は筋肉にどんな負荷をかけていたのか——そんな問いを、私たちはこれまで持ったことすらなかったかもしれません。

「使いやすい」という感覚は長い間、デザイナーの直感や大規模なユーザーテストに委ねられてきました。Log2Motionはその文脈を静かに、しかし確実に塗り替えようとしています。身体という最もプリミティブなインターフェースを科学で解析する試み——これは、テクノロジーが人間の側に歩み寄る、Tech for Human Evolutionの一歩ではないでしょうか。

「使いやすさ」が科学で測れる時代に、私たちユーザー自身はどんなインターフェースを求めているのでしょう。ぜひ、一緒に考えてみませんか。