便利さの裏に潜む「責任」の落とし穴

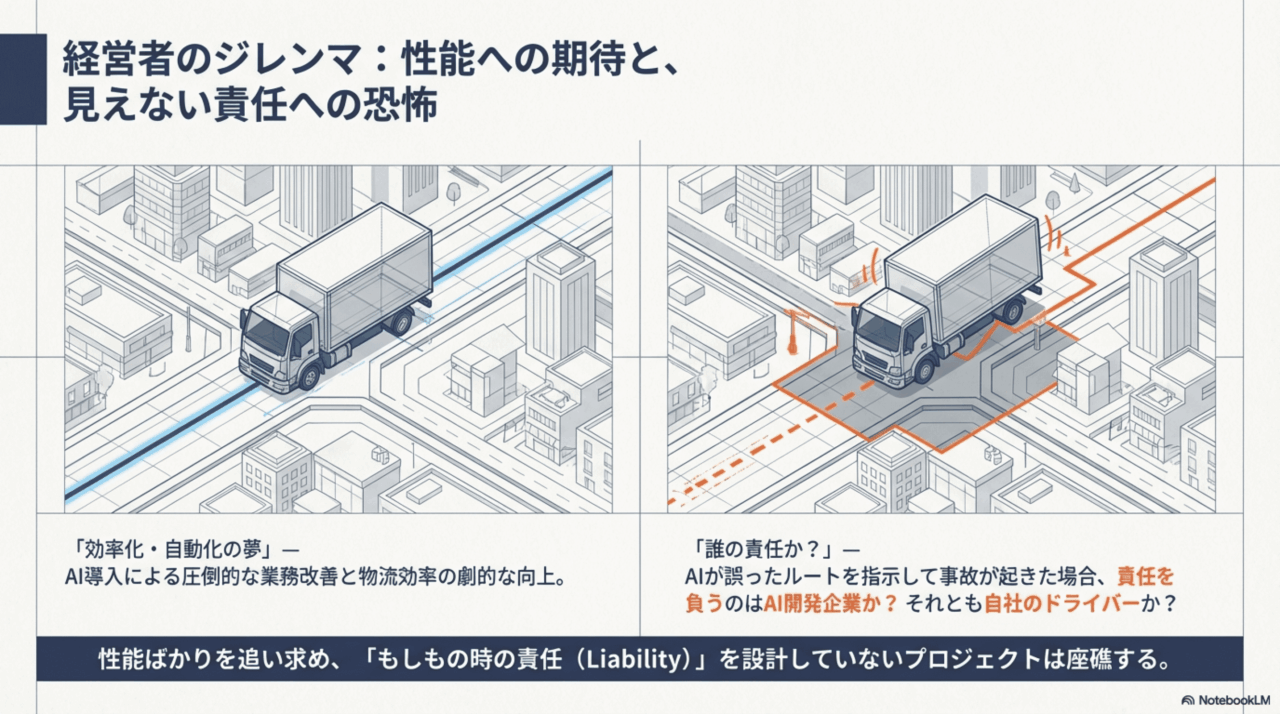

「このAIシステムを導入すれば、我が社の物流効率は劇的に向上します!」

新規プロジェクトのリーダーであるタカシのプレゼンは自信に満ちていました。しかし、社長の冷たい一言がその場を凍らせます。

「もしそのAIが間違ったルートを指示して、うちのトラックが事故を起こしたら、誰の責任になるんだ? AIを作ったシステム会社か? それとも、うちのドライバーか?」

タカシは言葉に詰まりました。AIの性能や導入効果ばかりを気にして、「もしもの時の責任」について全く考えていなかったのです。AIが自律的に判断を下す時代、これまでの「人が操作する機械」と同じルールで良いのでしょうか。責任の所在が曖昧なままでは、怖くてAIを導入することはできません。

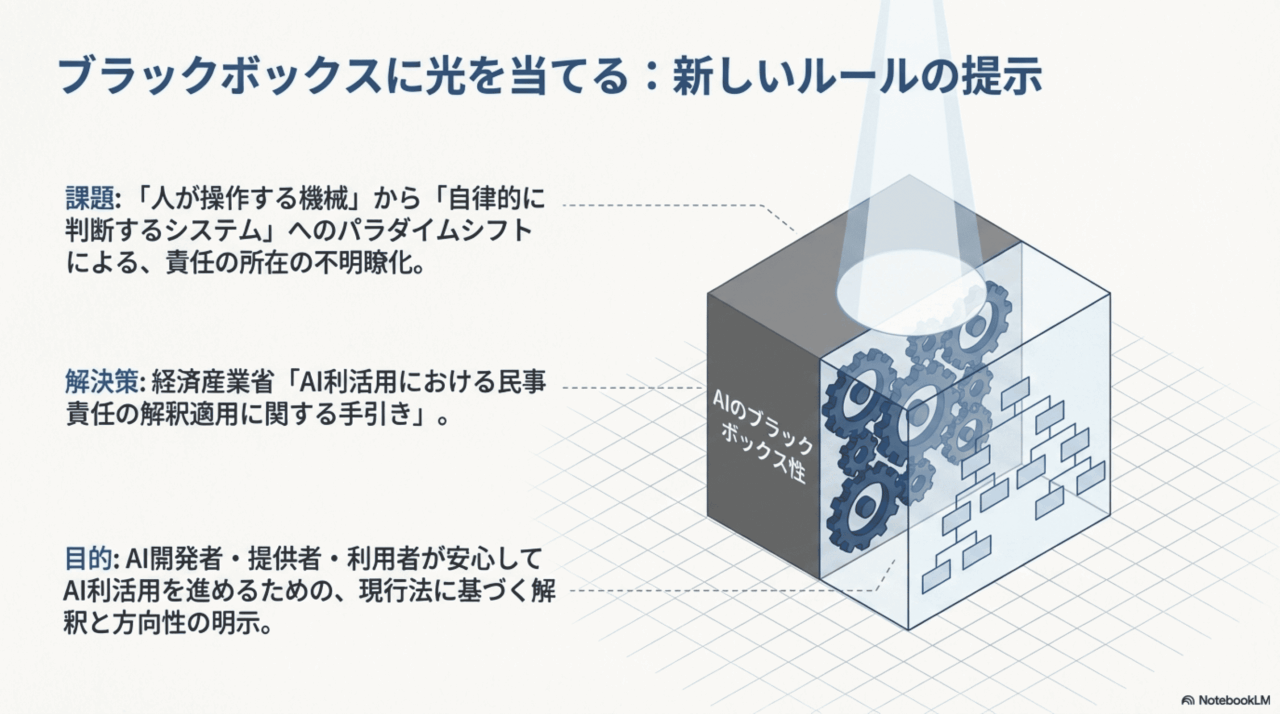

そんなタカシのようなAI開発者や提供者、利用者の前に現れたのが、経済産業省の「AI利活用における民事責任の解釈適用に関する手引き」です。

この手引きは、AIのブラックボックス性や自律性に起因する「責任の所在の不明瞭さ」という課題を解消し、皆が安心してAI利活用を進めるための方向性を示すものです。本稿では、この手引きを紐解き、AI社会における「責任のルール」を解説します。

📋 編集部注(2026年4月15日更新):本文中「画像生成AI(事例c)」の記述を一次資料(経産省概要資料)に基づき修正しました。あわせて、EU改正製造物責任指令との対比など、読者の理解を深める情報を追記しました。

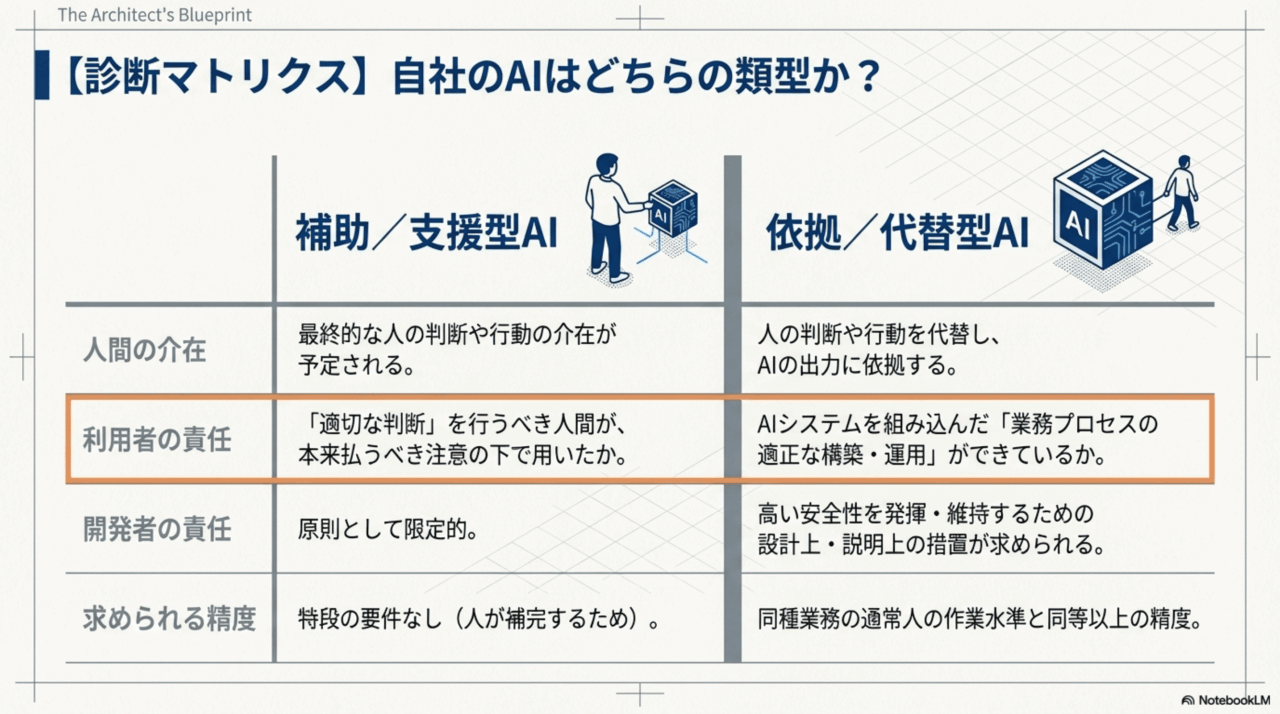

AIと人間の関係性で決まる「2つのAI類型」

AIが関わるトラブルの責任を考える際、手引きではAIをその利用形態に応じて2つの類型に分けています。

- 補助/支援型AI: AIの判断の補助ないし支援としてのみ用いられ、最終的に人の判断や行動を介在させることが予定されている類型です。この場合、AIが誤った出力をしても、原則として適切な判断を行うべき「AI利用者(人間)」が本来払うべき注意の下でAIを用いたか否かで責任が判断されます。

- 依拠/代替型AI: 人の判断や行動を代替する前提で提供され、AIの出力に依拠しながら用いることが予定される類型です。この場合、同種業務の通常人の作業水準と同等以上の精度等を備えていることなどが要件となり、利用者の責任は「適切な判断・行動を行うこと」から「AIシステムを組み込んだ業務プロセスの適正な構築及び運用」へと転換します。開発者には、高い安全性を発揮・維持するための設計上・説明上の措置が求められます。

【ケーススタディ】7つの身近なAIトラブルと責任の行方

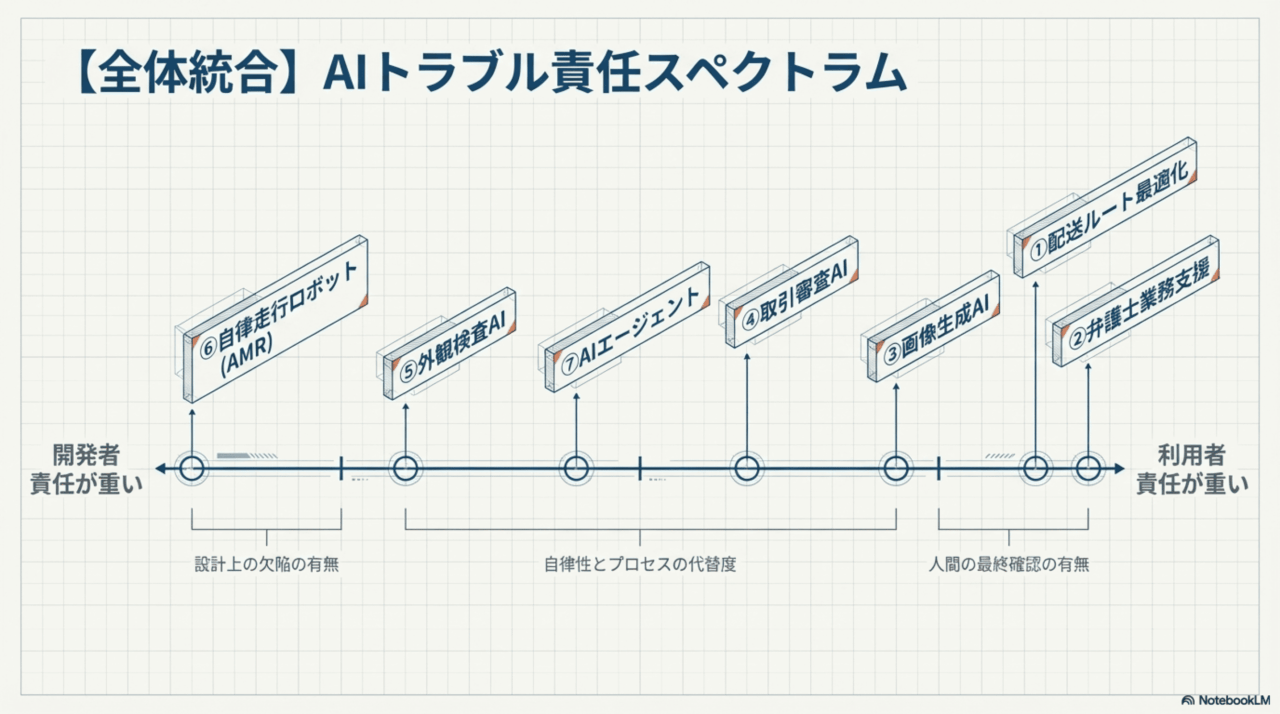

手引きに掲載されている7つの想定事例から、誰が責任を問われるのかを見ていきます。

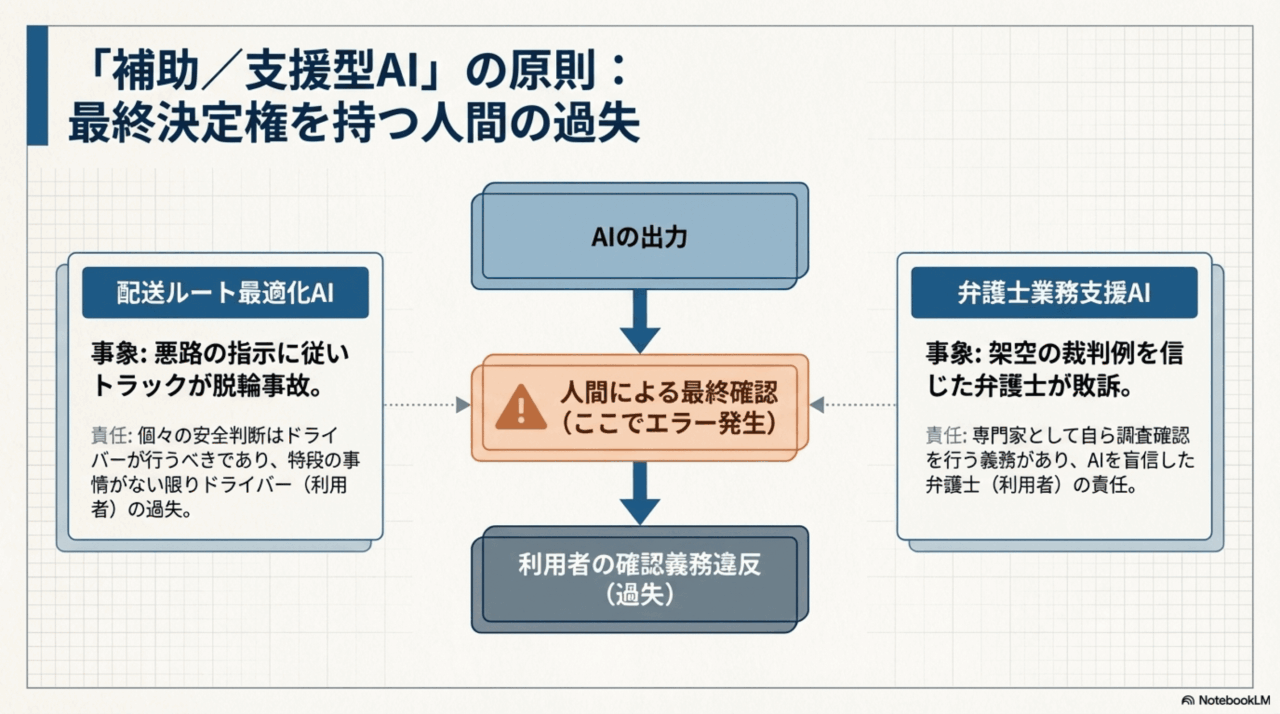

- 配送ルート最適化AI(補助/支援型):AIが指示した悪路に従ってトラックが脱輪事故を起こした事例です。個々の局面における安全判断はドライバーが行うべきであり、AIはあくまで補助であるため、特段の事情がない限りドライバー(利用者)の過失が問われます。

- 弁護士業務支援AI(補助/支援型):AIが出力した「架空の裁判例」を信じた弁護士が敗訴した事例です。専門家である弁護士は自ら調査確認を行う義務があり、AIの出力のみに依拠した弁護士(利用者)の責任となります。

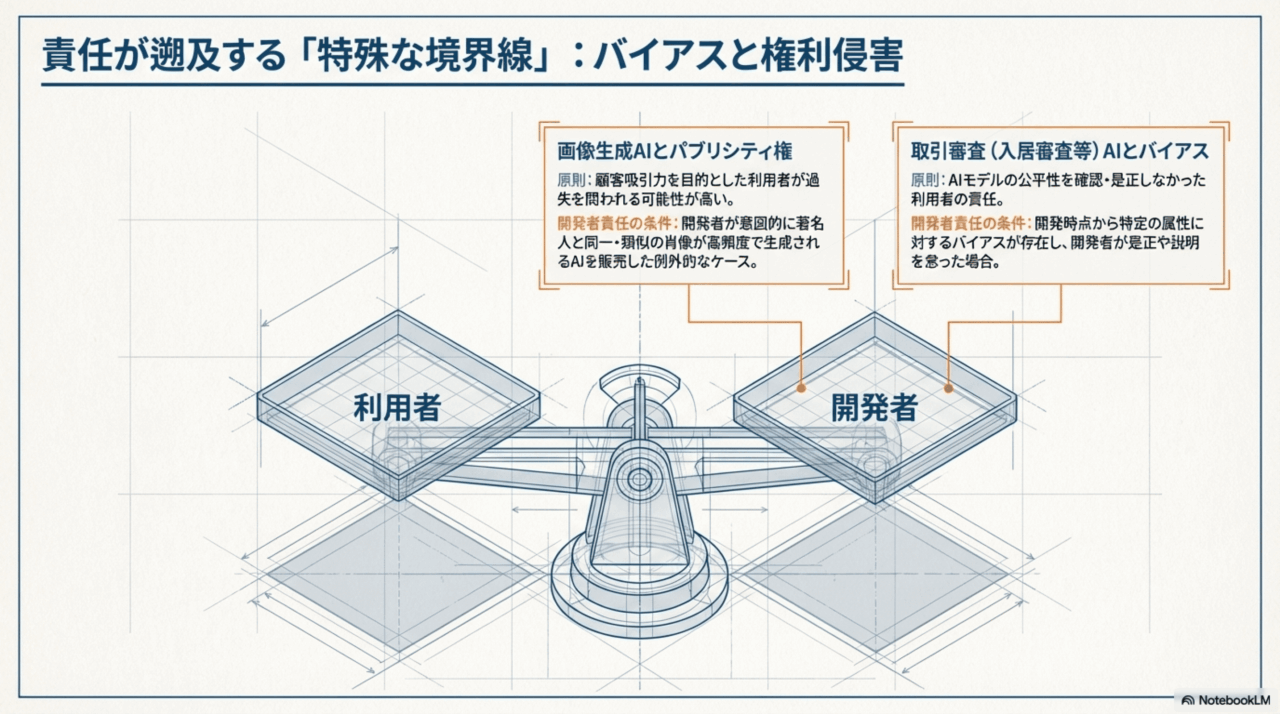

- 画像生成AI(補助/支援型):生成した著名人に酷似した画像を広告に使い、パブリシティ権を侵害した事例です。利用者が気づかずに使った場合でも、専ら顧客吸引力の利用を目的としていると評価され、利用者の過失が問われる可能性が高いとされています。一方、著名人と同一・類似の画像を容易に生成できることを「セールスポイントとして販売」したような例外的なケースでは、開発者の行為自体がパブリシティ権侵害と評価され得ます。

- 取引審査AI(補助/支援型):入居審査AIに特定の属性(性別等)を不利に扱うバイアスが含まれていた事例です。開発時点からバイアスが存在し、開発者が是正や説明を行わなかった場合、開発者の責任が問われ得ます。利用者も、AIモデル全体の公平性について確認を行い、必要な措置を講じなかった場合は責任を問われる可能性があります。

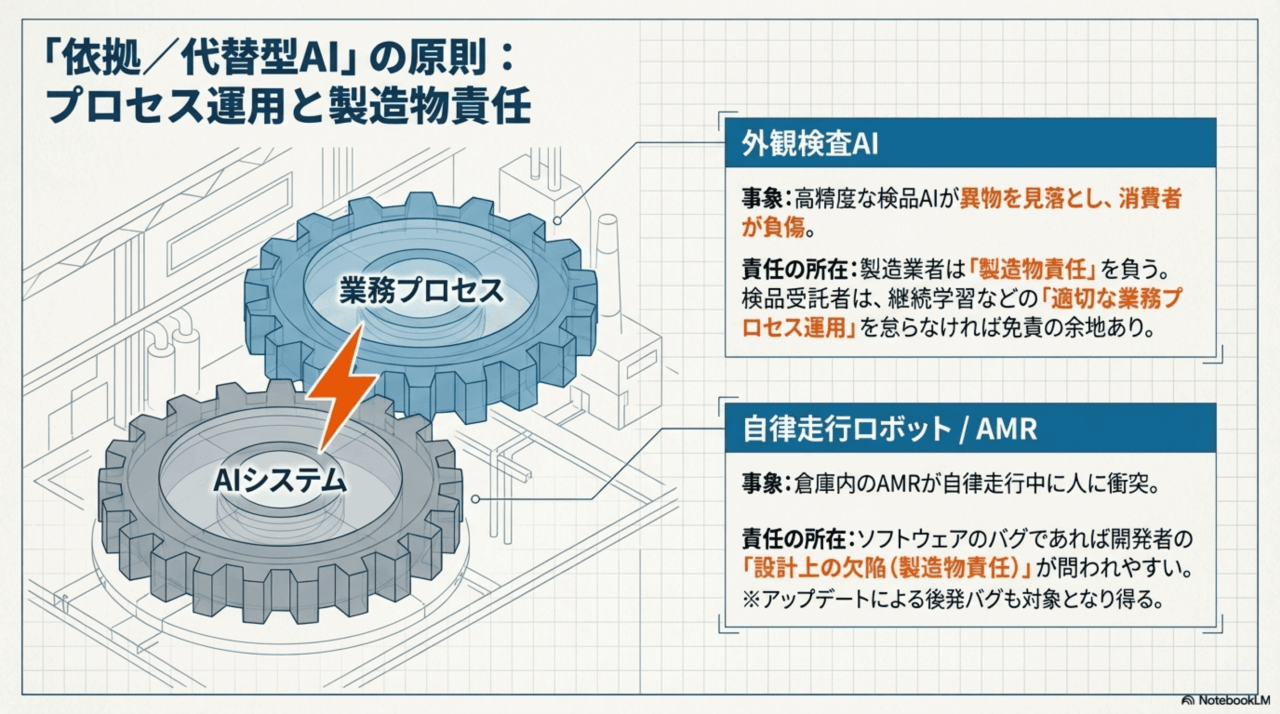

- 外観検査AI(依拠/代替型):高精度な検品AIが異物を見落とし、消費者が負傷した事例です。製造業者は製造上の欠陥により製造物責任を負います。検品受託事業者は、適切な業務プロセスの構築や、AIの精度を高める運用(継続学習など)を怠っていなければ責任を免れ得ます。開発者も、必要な精度を満たすよう設計・説明していれば責任を負う可能性は低くなります。

- 自律走行ロボット / AMR(依拠/代替型):倉庫内のロボットが人に衝突した事例です。ソフトウェアのバグによる事故であれば、開発者(メーカー)の設計上の欠陥として製造物責任が問われやすくなります。アップデートで後から生じたバグについても、引渡し時の潜在的原因の有無や、最終アップデート時点までの影響を考慮するか等の解釈が分かれるものの、製造物責任の対象となり得ます。

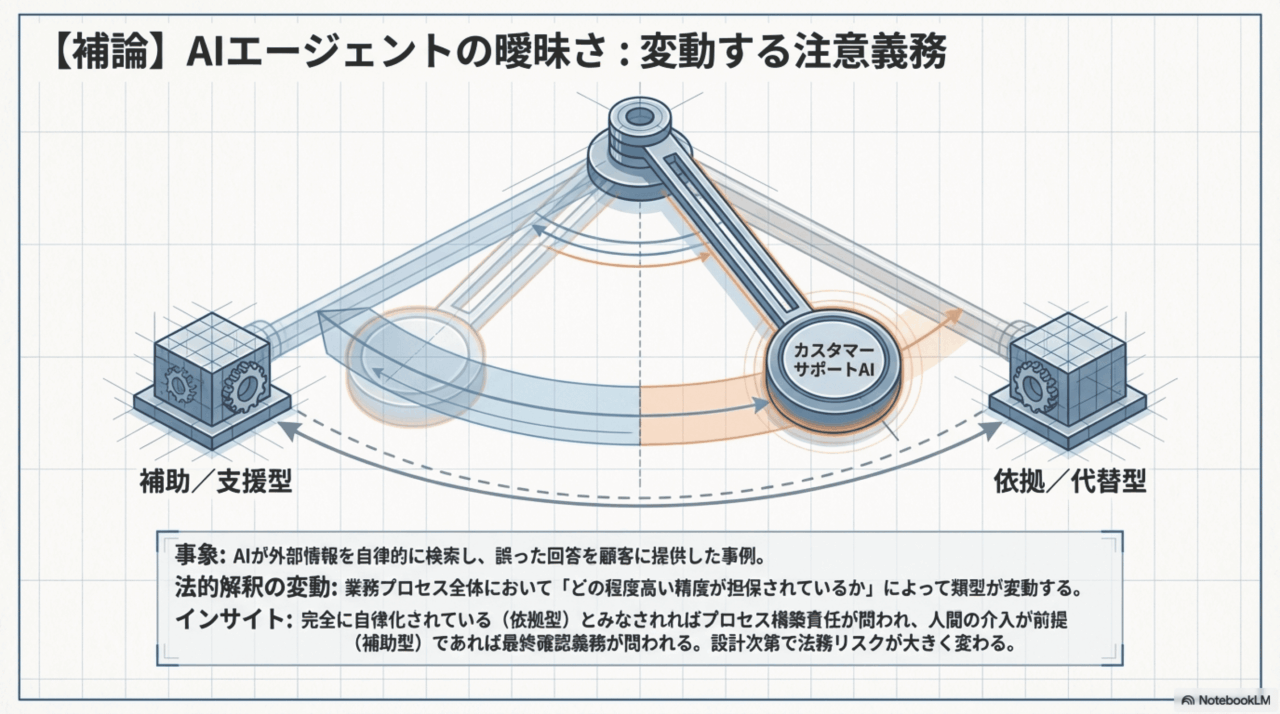

- 【補論】AIエージェント(カスタマーサポート):AIが外部情報を自律的に検索し、誤った回答をした事例です。業務プロセス全体で高い精度が担保されているか等によって「依拠/代替型」か「補助/支援型」かが分かれ、それにより利用者や開発者の責任・注意義務の内容が変動します。

| 想定事例 | AI類型 | トラブルの内容 | 主な責任主体 | 責任判断の根拠・注意義務 | 製造物責任の適用の有無 (推測) |

|---|---|---|---|---|---|

| 外観検査AIによる異物見落とし | 依拠/代替型 | 検品AIが異物を見落とし、製品を購入した消費者が負傷。 | 製造業者 | 製造上の欠陥により製造物責任を負う。検品受託者は適切な業務プロセス構築を怠らなければ免責され得る。 | 適用される(製品の一部としてのAIに欠陥があり、生命・身体に被害が生じているため) |

| 自律走行ロボット(AMR)の衝突事故 | 依拠/代替型 | 倉庫内のロボットが人に衝突し、損害が発生。 | 開発者(メーカー) | ソフトウェアのバグによる事故であれば、設計上の欠陥として責任を問われやすい。 | 適用される(動産であるロボットの組み込みソフトの欠陥に起因するため) |

| 配送ルート最適化AIによる脱輪事故 | 補助/支援型 | AIが指示した悪路に従ってトラックが走行し、脱輪事故が発生。 | 利用者(ドライバー) | 個々の局面における安全判断はドライバーが行うべきであり、AIはあくまで補助であるため、特段の事情がない限り利用者の過失が問われる。 | 適用されない可能性が高い(人の判断が介在し、ソフトウェア単体の欠陥が直接的な原因とみなされにくいため) |

| 弁護士業務支援AIによる敗訴 | 補助/支援型 | AIが出力した架空の裁判例を信じた弁護士が訴訟で敗訴。 | 利用者(弁護士) | 専門家である弁護士は自ら調査確認を行う義務があり、AIの出力のみに依拠した利用者の責任となる。 | 適用されない(知的活動の成果物や情報提供に留まり、製造物の欠陥とはみなされない) |

| 画像生成AIによるパブリシティ権侵害 | 補助/支援型 | 生成した著名人に酷似した画像を広告に使用し、パブリシティ権を侵害。 | 利用者(または開発者) | 顧客吸引力の利用を目的としている場合、利用者の過失が問われる。開発者が意図的に生成を促す仕組みを提供した場合は開発者の責任。 | 適用されない(知的財産権の侵害は製造物責任法の対象となる損害ではないため) |

| 取引審査AIによる不当なバイアス | 補助/支援型 | 入居審査AIに特定の属性を不利に扱うバイアスが含まれており、不当な判断がなされた。 | 開発者・利用者 | 開発者が是正や説明を怠った場合や、利用者が公平性の確認・措置を講じなかった場合にそれぞれの責任が問われ得る。 | 適用されない(無体物である情報・アルゴリズムの偏りであり、身体・財産への損害ではないため) |

| AIエージェントによる誤回答 | 補助/支援型 または 依拠/代替型 | AIが外部情報を自律検索し、誤った回答を提供したことで損害が発生。 | 利用者・開発者 | 業務プロセス全体で高い精度が担保されているかにより類型が分かれ、それにより注意義務の内容が変動する。 | 適用されない可能性が高い(サービスとしての提供や情報提供が主であり、製造物の欠陥に該当しにくいため) |

もしも裁判になったら? 立証の壁と国際ルール

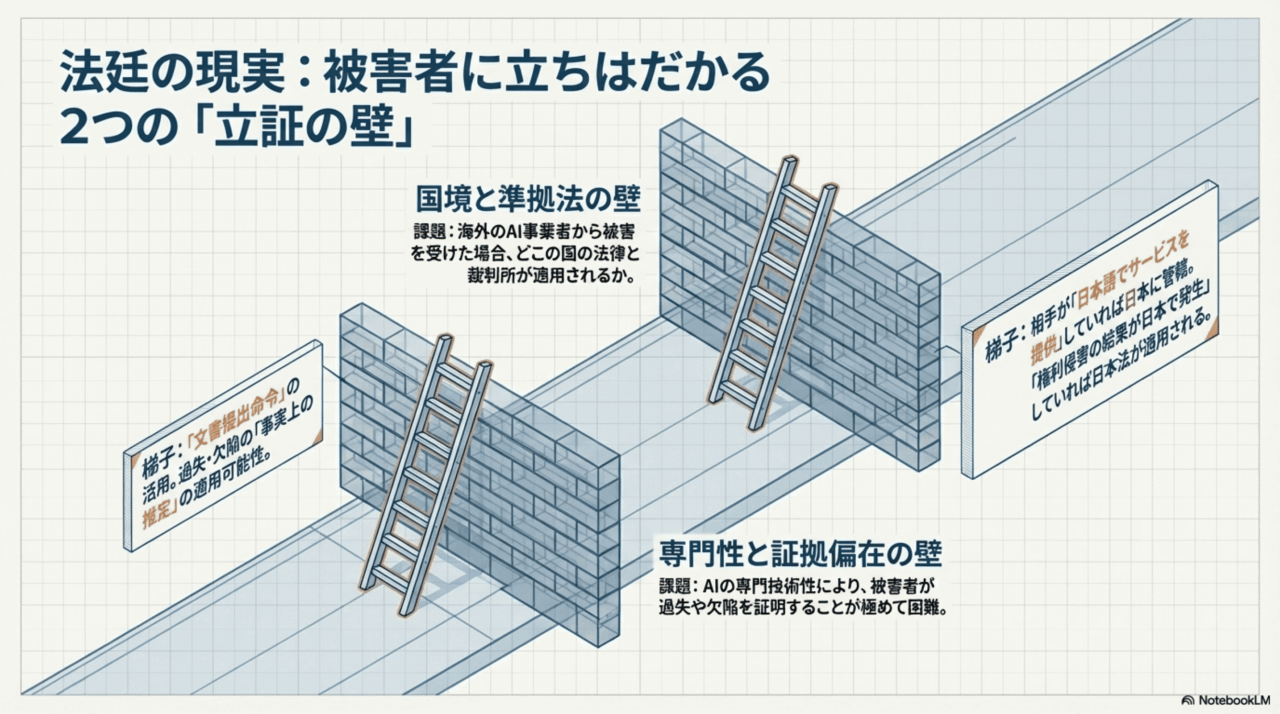

実際にトラブルになり裁判を起こす場合、被害者には特有の壁が立ちはだかります。

- 立証上の論点: AIの専門技術性や証拠の偏在により、被害者が過失や欠陥を証明するのは困難です。このため、文書提出命令の活用や、医療・環境訴訟などで用いられる「過失の事実上の推定」「欠陥の事実上の推定」といった法理のAI事案への適用可能性が議論されています。

- 手続上の論点: 国境を跨ぐAIサービスでトラブルが起きた場合、国際裁判管轄や準拠法が問題となります。日本の利用者が海外のAI事業者から被害を受けた場合、相手が日本語でサービスを提供していれば日本の裁判所に管轄が認められ得ることや、権利侵害の結果が日本で生じている場合は日本法が適用される可能性が高いことが整理されています。

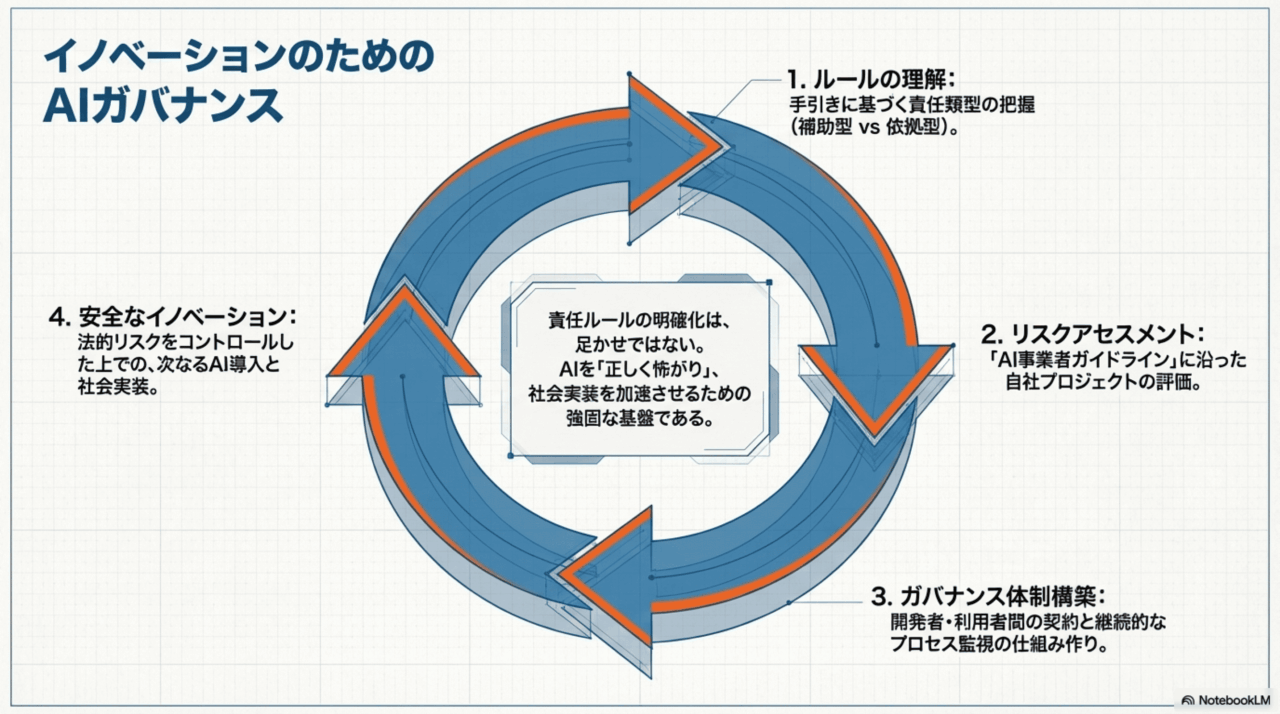

AIを「正しく怖がり」、イノベーションを加速させるために

責任のルールが明確になることは、決してAI導入の足かせではありません。AIの開発者や利用者は、「AI事業者ガイドライン」などに沿ったリスクアセスメントとガバナンス体制を構築することで、トラブルを未然に防ぐことが求められます。ルールを理解し、各々が果たすべき責任を全うすることが、AI社会を安全かつ豊かに発展させる鍵となります

【2026年4月15日 追記】

本手引きを正確に読み解くには、二つの文脈を重ねて見る必要があります。

日本の立ち位置:「ソフトロー」で進むAIガバナンス

本手引きは、2025年5月に成立した「人工知能関連技術の研究開発及び活用の推進に関する法律」(AI法)を背景に生まれています。AI法は罰則規定を持たない「理念法」であり、政府のAI政策の司令塔(AI戦略本部)を設置し、イノベーション促進とリスク対応の両立を国家方針として明確にしました。本手引きは、この方針のもとで「すでにある民事法の解釈」を整理したものです。新たな規制を創設するのではなく、不法行為法・製造物責任法という既存の法体系をAI事案にどう適用するかを示す——これが日本が選んだアプローチです。

EUとの決定的な違い:ソフトウェアは「製造物」か

対照的に、EUでは2024年12月に改正製造物責任指令(PLD)が発効し、無体物であるソフトウェアも「製造物」の定義に含まれるようになりました。これにより、AIソフトウェア単体に欠陥があれば、過失の有無にかかわらず責任が問われる枠組みがEUでは整備されつつあります(EU加盟国は2026年12月までの国内法化が求められています)。一方、日本の製造物責任法では、現在もソフトウェア単体は動産ではないため適用対象外です。本記事の責任一覧表でソフトウェア系AI(弁護士支援AI・取引審査AIなど)に「製造物責任は適用されない」と整理されているのは、この日本法の現状を反映しています。EU市場でもAIサービスを展開する企業は、日本とEUの責任フレームが異なることを意識した設計・契約が求められます。

infomation

【用語解説】

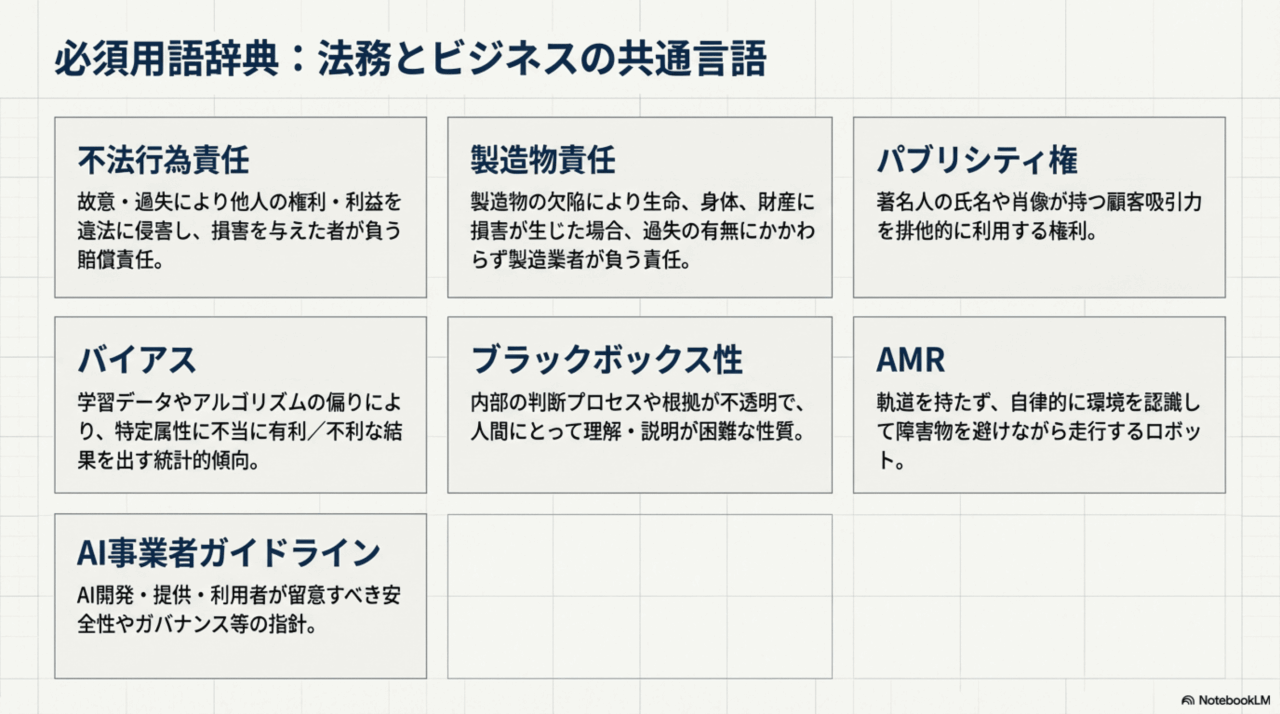

不法行為責任

故意または過失によって他人の権利や利益を違法に侵害し、損害を与えた者が負う賠償責任である。

製造物責任

製造物の欠陥により人の生命、身体または財産に損害が生じた場合、過失の有無にかかわらず製造業者等が負う損害賠償責任である。

ブラックボックス性

AIの内部の判断プロセスや根拠が、人間にとって不透明で理解・説明が困難である性質のことである。

パブリシティ権

著名人の氏名や肖像などが持つ、顧客を惹きつける経済的な価値(顧客吸引力)を排他的に利用する権利である。

バイアス

AIの学習データやアルゴリズムに偏りがある結果、特定の属性(性別など)に対して不当に有利または不利な結果を出力する統計的な傾向のことである。

AMR

Autonomous Mobile Robotの略称。あらかじめ設定された軌道を持たず、自律的に周囲の環境を認識し、障害物を避けながら目的地まで走行するロボットのことである。

AI事業者ガイドライン

AIの開発、提供、利用に携わる事業者が留意すべき安全性やガバナンス等の指針を定めたガイドラインである。

【参考リンク】

経済産業省(外部)

日本の行政機関。「AI利活用における民事責任の解釈適用に関する手引き」の公表や「AI事業者ガイドライン」の策定など、AIの社会実装に向けたルール整備を行っている。

AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕(外部)

経済産業省がとりまとめた、AI利活用時に損害等が発生した際の民事責任の所在について、現行法に基づく解釈適用上の論点や考え方を整理した資料本体。

AIの利用・開発に関する契約チェックリスト(外部)

経済産業省が2025年2月に公表した実務向けツール。AI開発・提供・利用に関わる契約で確認すべき事項をチェックリスト形式で整理したもの。本手引きと合わせて参照することで、責任の所在を契約レベルで明確化する手がかりになる。

人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)(外部)

2025年9月1日に全面施行された日本初のAI基本法。本手引きが置かれる法的文脈を理解するための基礎資料。

【参考動画】

【関連記事】

経済産業省「AI民事責任手引き」——補助型・代替型の2類型で責任分界を整理

あわせて読みたい記事。経産省の手引き公表の背景・概要・国際比較など、ニュース視点から今回の手引きの意義を解説した記事。