2026年4月23日、Anthropicは同社のエージェント型コーディングツールClaude Codeに関するポストモーテムを公開した。3月初旬以降の性能低下を訴えるユーザーの指摘を認め、3つの変更が原因だったと説明したものである。

第一に、3月4日にデフォルトの推論effort値をhighからmediumへ変更し、4月7日に撤回した。第二に、3月26日にthinking-cacheに関する不具合を導入し、4月10日に修正した。第三に、4月16日にOpus 4.7のローンチに合わせて冗長性を制限するシステムプロンプトを追加し、Opus 4.6および4.7のコーディング評価で約3%の低下を招いたため、4月20日に撤回した。

4月2日にはAMDのAIグループでシニアディレクターを務めるステラ・ラウレンツォが、6,852セッション、234,760件のツール呼び出し、17,871件のthinkingブロックの分析に基づくGitHub Issueを公開した。Claude Codeリードのボリス・チェルニーは事態を認め、Anthropicは全契約者の利用上限をリセットした。

From: ![]() Clients Were Right: Anthropic Admits Claude Code Got Dumber — Not Claude (Post-Mortem)

Clients Were Right: Anthropic Admits Claude Code Got Dumber — Not Claude (Post-Mortem)

📋 編集部注(2026年4月27日更新):ポストモーテム公開直前の4月21日、AnthropicがProプランからClaude Codeを一時的に除外するテストを実施し、すぐ撤回するという動きが見られました。本件に関する追記を編集部解説の末尾に追加しました。

【編集部解説】

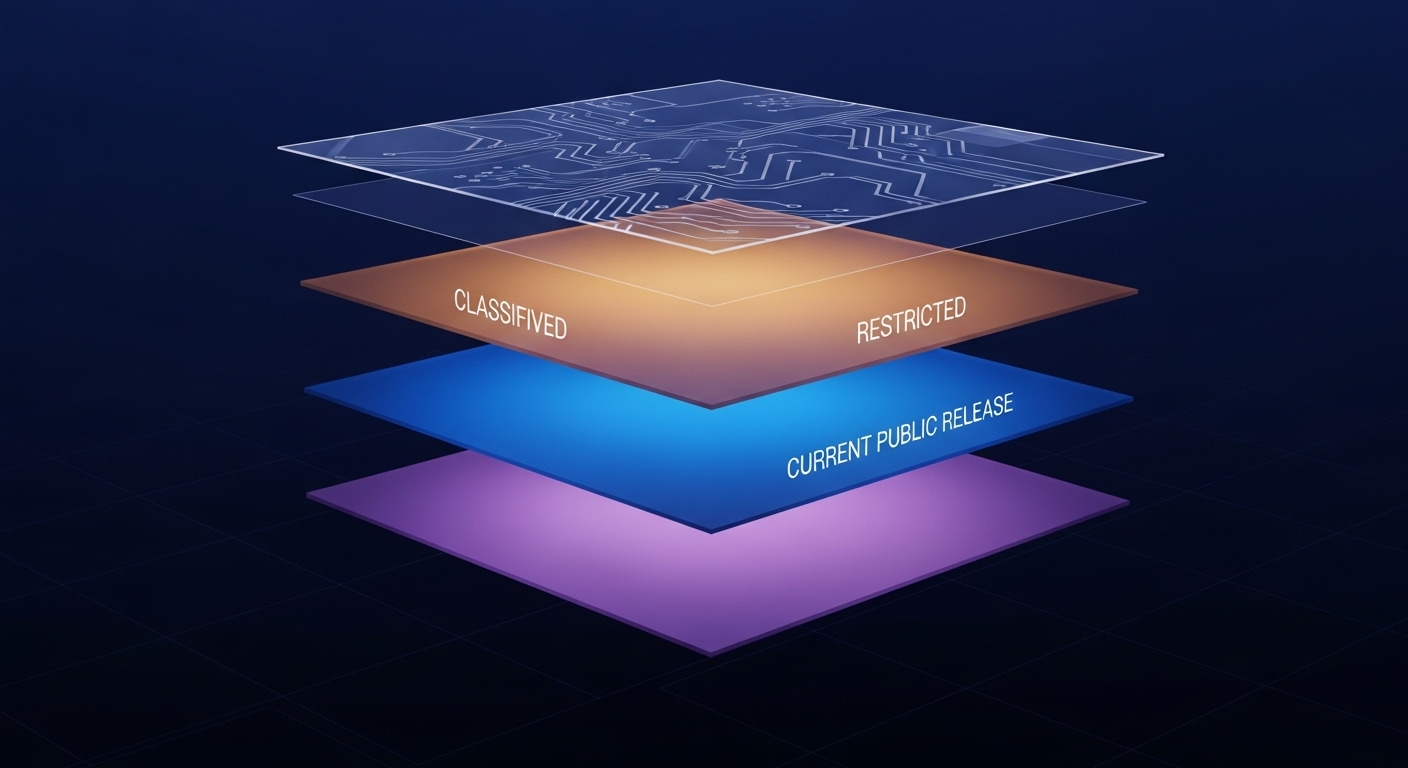

今回の事案で最も重要なポイントは、「モデル本体は劣化していなかった」という点です。Anthropicが今回認めたのは、Claude Code(およびClaude Agent SDK、Claude Cowork)を取り囲む「ハーネス(harness)」と呼ばれる外側のレイヤー——具体的にはデフォルト設定、キャッシュ処理、システムプロンプト——での回帰でした。Claude APIそのもの、つまりモデルウェイトは無傷です。元記事はClaude Codeにフォーカスしていますが、実際の影響範囲はSDKやCoworkにも及んでいた点は補足しておくべき事実といえます。

ここで言う「ハーネス」とは、生成AI業界における比較的新しい概念です。LLM本体(モデルウェイト)と、それを実用的なエージェントとして動かすための足回り——ツール呼び出しのループ、推論深度の制御、コンテキスト管理、キャッシュ戦略、プロンプト雛形——を区別する考え方で、今回の事案はまさに「モデルは賢いままでも、ハーネス次第で製品体験は劇的に劣化する」という構造的リスクを可視化しました。

今このニュースを取り上げる理由は、まさにここにあります。Claude Codeは2025年5月のリリース以降、開発者の支持率や満足度で首位級の評価を得るまでに急成長しました。複数の調査によれば、多くの開発者が日常業務にAI支援を取り入れていることが示されており、AIによるコード生成は実際の開発ワークフローやGitHub上の公開コミットにも一定の割合で浸透し始めています。Anthropicによれば、Claude Code単体の年率換算収益は2026年時点で25億ドル超(1ドル=155円換算で約3,875億円、4月24日時点のレート)に達したとされています。そのインフラ層で「サイレントな劣化」が起きうるという事実は、すべての開発組織にとって構造的なリスクシグナルです。

技術的に最も興味深いのは、3つの変更が個別には合理的だった点です。レイテンシ削減のためのデフォルトeffort値ダウングレード、アイドルセッションの古い思考履歴をクリアする最適化、Opus 4.7の冗長性を抑える1行のシステムプロンプト——これらはどれも「測定可能な何か(応答速度、コスト、トークン消費)」を改善する目的で投入されました。しかし「測定しにくい知能」とのトレードオフは社内評価では捕捉されず、有料ユーザーの実環境で複合的に顕在化したのです。

今回のキャッシュバグは特に示唆的です。Anthropicは「複数の人間レビュー、自動レビュー、ユニットテスト、E2Eテスト、社内ドッグフーディング」をすべて通過したと認めています。テストは書かれたコードの正しさを検証できても、エージェントの「記憶の一貫性」や「コードを読む丁寧さ」のような上位概念までは検証できなかったわけです。これはAIエージェント時代の新しい品質保証(QA)課題そのものといえるでしょう。

ポジティブな側面として、Anthropicがポストモーテムを公開し、バージョン番号、日付、問題のシステムプロンプト全文まで具体的に開示した点は評価できます。AIラボの透明性開示として高水準のものです。一方で潜在的なリスクは、「ベンダー側が見えていないものを、ユーザー側が自前のテレメトリで証明しなければならない」という非対称性です。今回はAMDのステラ・ラウレンツォ氏という、6,852セッション分のログを詳細に分析できる立場の人物が声を上げたから表面化しましたが、ほとんどの開発組織にそこまでの計測能力はありません。

規制への影響という観点では、EU AI法などの枠組みがAIモデルの透明性、安全性、リスク管理を重視しています。しかし今回の事案は、「モデル本体」だけでなく、製品としての運用レイヤーやハーネス変更も品質管理の対象に含める必要があることを示しています。SLA(サービス品質保証)における「品質の安定性」をどう契約・規制レベルで担保するかという議論は、エンタープライズ向けAI契約の現場で今後加速する可能性があります。

長期的な視点で見れば、今回のエピソードは「AIプロバイダーへの全面依存」という構造的リスクを浮き彫りにしました。ラウレンツォ氏のチームが回帰の最中に競合プロバイダーへ移行できたのは、複数モデルでの並行運用体制を維持していたためです。ここから読み取れる示唆は、シングルベンダー依存を避け、必要に応じて複数モデルや複数プロバイダーを使い分けられる体制を持つことが、業務継続性の観点からも重要になりつつある、という点でしょう。

最後に、innovaTopiaとして強調しておきたいのは、Anthropicという会社が「AI Safety」を旗印に掲げる企業である、という文脈です。安全性を最重要価値と位置付ける組織が、自社の最重要プロダクトで「測定できる範囲を最適化した結果、測定できない価値を毀損した」というケーススタディを公開したこと。これは皮肉ではなく、AI業界全体にとっての貴重な学習素材といえるでしょう。ベンダーの誠実さは、製品が完璧に動いている時ではなく、こういう時にこそ問われます。次のリグレッションを「AMDのディレクターが声を上げる前に」検出できるかどうか——これこそがAnthropicに対する真のテストとなります。

【2026年4月27日 追記】

ポストモーテム公開(4月23日)の直前となる4月21日、AnthropicのProプラン(月額20ドル)の料金ページからClaude Codeのチェックマークが消え、数時間後に復元されるという出来事がありました。Anthropicの成長責任者Amol Avasareは「新規Prosumerサインアップの約2%を対象にした小規模テスト」と説明しましたが、同氏の投稿は「Maxプラン導入時にはClaude CodeもCoworkも存在せず、現在の利用パターンは当初の想定を大きく上回っている」という内容を含んでいました。ポストモーテムと時期を同じくして、ほぼ事前告知なくプランの変更テストが行われたことは、開発者コミュニティに追加の不信感をもたらしました。またFortuneの取材に対するAnthropicの声明でも「Claudeへの需要は前例のない速度で成長しており、特にピーク時はインフラが対応しきれていない状態だ」と認めています。品質の問題と並行して浮上したこの動きは、本記事で触れた「ベンダー側が見えていない制約をユーザー側が体感させられる非対称性」という問題が、プラン設計の領域にも及びうることを示す事例として記録しておきたいと思います。

【用語解説】

ポストモーテム(post-mortem)

ソフトウェア業界における事後分析報告のこと。障害や品質低下の原因、対応経緯、再発防止策を技術的に整理した文書を指す。エンジニアリング文化として透明性の証とされる。

ハーネス(harness)

LLM本体(モデルウェイト)を実用的なエージェントとして動かすための外側のレイヤーの総称。ツール呼び出しのループ、推論深度の制御、コンテキスト管理、キャッシュ戦略、システムプロンプトなどを含む。

effort値(推論effort)

モデルが回答前にどれだけ「考える」かの強度を指定するパラメータ。high、medium、xhigh などの段階があり、高いほど深い推論が行われるが、応答時間とトークン消費は増える。

システムプロンプト

ユーザーの入力とは別に、開発者側がモデルに恒常的に与える指示文。モデルの振る舞い、応答の長さ、口調、出力形式などを規定する。

ドッグフーディング

自社で開発した製品を社内で実際に使い、品質を検証する慣行。「自社のドッグフードを食べる」という比喩に由来する。

アブレーション・テスト(ablation testing)

システムプロンプトや特定の機能を意図的に外して挙動を比較し、どの要素がどれだけ性能に寄与しているかを切り分ける検証手法。

Claude Agent SDK

Anthropicが提供する、Claudeを汎用エージェントとして組み込むための開発キット。Claude Codeもこの基盤上で動作する。

Claude Cowork

Anthropicが提供する非開発者向けのデスクトップツール。Agent SDK上で動作し、ファイルやタスクの自動化を担う。

CLAUDE.md

リポジトリのルート等に置く設定ファイルで、Claude Codeに対するプロジェクト固有のルールや過去のエラー履歴を記述する。

SLA(Service Level Agreement)

サービス提供者と利用者の間で結ばれる、品質や可用性に関する合意。エンタープライズAI契約では応答品質や稼働率が定義される。

【参考リンク】

Anthropic 公式サイト(外部)

AI安全性を中心理念に掲げる米国のAI研究企業。Claudeシリーズの開発元。

Claude Code 製品ページ(外部)

Anthropicのエージェント型コーディングツールの公式紹介ページ。機能や導入事例を掲載。

AMD 公式サイト(外部)

ステラ・ラウレンツォ氏がAIグループのシニアディレクターを務める米国の半導体企業。

GitHub(外部)

ラウレンツォ氏が今回のIssueを公開した、開発者向けソースコード共有プラットフォーム。

【参考記事】

An update on recent Claude Code quality reports(Anthropic公式)(外部)

3月から4月にかけてのClaude Code、Agent SDK、Coworkの品質問題に関するAnthropic公式の一次情報。

Mystery solved: Anthropic reveals changes to Claude’s harnesses and operating instructions likely caused degradation(VentureBeat)(外部)

特定された3つの製品レイヤーの変更と、ラウレンツォ氏の監査結果を整理した記事。

Anthropic admits it dumbed down Claude with ‘upgrades’(The Register)(外部)

ポストモーテム公開当日に出された詳細レポート。問題のシステムプロンプト原文と性能低下を報じる。

Claude Code has become dumber, lazier: AMD director(The Register)(外部)

Anthropic公式認定の3週間前、ラウレンツォ氏のGitHub Issueを最初に報じた記事。

Claude Code Drama: 6,852 Sessions Prove Performance Collapse(Scortier)(外部)

ラウレンツォ氏の分析を独立に再構成し、思考長や読み込み数の崩落を定量的に示した解説。

Anthropic Says Claude Code’s Performance Was Degraded Because Of Bugs(OfficeChai)(外部)

Anthropicの売上規模やGitHubコミットへの影響度合いから、本件の市場インパクトを整理した記事。

Anthropic tests reaction to yanking Claude Code from Pro(The Register)(外部)

4月21日のProプランからのClaude Code一時除外を報じた記事。Amol Avasareのコメントとユーザー反応を整理。

【関連記事】

Claude利用制限の仕組みが変更—Anthropicがピーク時のトークン配分を見直し

2026年3月25日のセッション制限調整を扱った記事。本件で触れた「3月下旬の利用枠調整」の文脈を補足できる。

Claude Opus 4.7登場|「Mythosの体験版?」サイバーセキュリティ対応モデルの性能とは

4月16日にローンチされたOpus 4.7のモデル性能を解説。本件の冗長性プロンプトが追加された時期と直結する記事。

Claude Code、ルーティン機能を公開—眠っている間にAIが開発を進める時代へ

4月16日に公開されたClaude Codeのルーティン機能を解説。同時期に複数の変更が投入されていた背景情報。

Claude、世界規模の障害でダウン ― App Store1位直後、急増するユーザーがインフラを直撃

3月2日のclaude.ai認証基盤の障害を扱った記事。Claudeシリーズ全体で続発する運用課題の連続性を示す。

Claude Code|LINEヤフーコミュニケーションズが示す、AIエージェント導入の現実解

Claude Codeの企業導入事例を扱った記事。業務に組み込んだ企業が直面しうるリスクの観点から関連する。

【編集部後記】

今回のニュースは、私たちが日々何気なく使っているAIツールが、いつのまにか「少し違う顔」になっているかもしれない、ということを静かに教えてくれます。みなさんはClaude CodeやCursor、GitHub Copilotなどを使っていて、「最近なんだか調子がおかしいかも」と感じた経験はありませんか。

その違和感は、もしかすると気のせいではないのかもしれません。AIエージェントと付き合っていく時代に、私たちユーザー側はベンダーの説明をどこまで信じ、自分の体感をどこまで信じればよいのでしょうか。一緒に考えていけたら嬉しいです。