「どのAIを使うか」ではなく「どう束ねるか」——日本発のSakana AIが、GPTもClaudeもGeminiも指揮下に置く新たなAIプロダクト「Sakana Fugu」のβテストを始めた。基盤モデルとアプリケーションの間に新たな“指揮者層”を築く挑戦が、ついに動き出す。

Sakana AIは2026年4月24日、新たな商用AIプロダクト「Sakana Fugu」のβテスト募集を開始したと発表した。Sakana Fuguは複数のフロンティア基盤モデルを協調させるマルチエージェント・オーケストレーションシステムであり、コーディング、数学、科学的推論などの領域に対応する。

当初はAPIとして提供され、OpenAI形式のエンドポイントと互換性を持つ。ラインナップはレイテンシ重視の「Sakana Fugu Mini」と、フル構成の「Sakana Fugu Ultra」の2種類である。ベンチマーク結果ではfugu-ultraがGPQADで95.1、LCBv6で93.2、SWEProで54.2を記録し、Gemini 3.1(high)、GPT 5.4(high)、Opus 4.6(max)を上回った。

基盤となる手法は、ICLR 2026採択論文「Trinity」および「Conductor」に基づく。

From: ![]() Sakana Fugu: A Multi-Agent Orchestration System as a Foundation Model

Sakana Fugu: A Multi-Agent Orchestration System as a Foundation Model

【編集部解説】

Sakana AIは、東京を拠点とする日本発のAI研究ラボです。同社は2023年に元Google研究者のデイビッド・ハ氏、Transformer論文の共著者として知られるライオン・ジョーンズ氏、伊藤錬氏によって共同創業されました。2025年11月のSeries Bでは公式発表ベースで約320億円(約2億ドル、ポストマネー評価額約27億ドル)を調達したとされ、海外メディアでは1億3500万ドル・評価額26.5億ドルとも報じられています。いずれにせよ日本で最も評価額の高い未上場AI企業のひとつに数えられています。

今回のSakana Fuguは、同社が2026年4月初旬にリリースしたエンタープライズ向けリサーチエージェント「Marlin」に続く2本目の商用プロダクトで、国際展開を視野に入れたフラッグシップという位置付けです。研究成果を「使えるサービス」へと転換するスピード感そのものが、同社の現在地を物語っています。

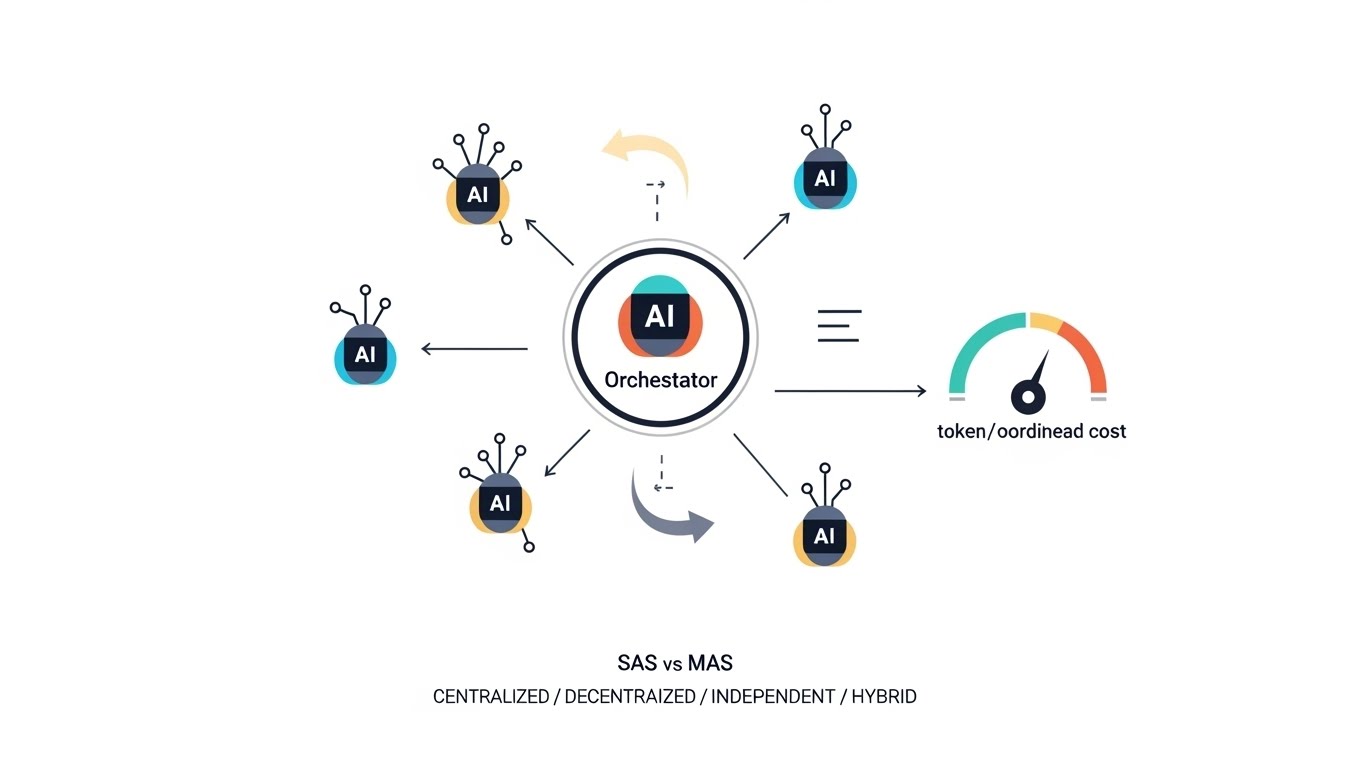

ポイントは「単一の巨大モデルを作る」のではなく「複数の優れたモデルを束ねて指揮する」というアプローチにあります。OpenAIやGoogle、Anthropicが基盤モデルそのものを巨大化させてきた一方で、Sakana AIはそれらを使う側の知性、いわば指揮者役を磨き込むという、明確に異なる立ち位置を選んでいます。

この指揮者役の中核にあるのが、ICLR 2026に採択された2本の論文「Trinity」と「Conductor」です。Trinityでは、約0.6Bパラメータの小型言語モデルと、約1万パラメータの軽量ヘッドからなるコーディネーターが、選んだLLMに「Thinker(思考役)」「Worker(実行役)」「Verifier(検証役)」の3つの役割を動的に割り当てる仕組みが提案されています。実際に進化計算で最適化されるのはこの軽量ヘッド部分(2万パラメータ未満)だけであり、勾配を用いた一般的な学習を経ずに役割割り振りの方策を獲得するという点が、技術的な新しさです。

技術的にとくに注目したいのは、Fuguが「自分自身を呼び出せる」という性質です。最初の答えが不十分だと判断すれば、自らのアウトプットを読み返して協調戦略を組み直し、再帰的にワークフローを起動します。再学習なしに推論時の計算量を調整できる、新しいタイプのテストタイム・スケーリングと位置付けられており、海外の研究者からも好意的に受け止められています。

実用面では、OpenAI形式のエンドポイントに互換である点が大きな鍵となります。GPT、Claude、Geminiを呼んでいるコードのエンドポイントを差し替えるだけで導入できる設計のため、既存のコーディングアシスタントやエージェント基盤への組み込みは想像以上にスムーズに進む可能性があります。

一方で、ベンチマーク表は割り引いて見る必要もあります。SWE-ProでのOpus 4.6の53.4というスコアは、Anthropicが独自スキャフォールドで自己申告した値をSakana側がそのまま転記したもので、Fugu自身の評価環境(mini-swe-agent)とは条件が一致していません。この点はSakana自身が脚注で正直に開示しており、誠実な姿勢ではあるものの、「Fuguが各社のフラッグシップモデルを凌駕した」と単純に読み取るのはやや早計でしょう。

経済性についても、海外の技術メディアAiholaは、Sakana側が「自社で各モデルを直接呼び出すより数十倍安価」とアピールしていると伝えていますが、公式ブログにはトークン単価などの具体的な料金体系は明示されておらず、再帰呼び出しが頻発すればその経済性は崩れます。実環境のワークロードでどう振る舞うかは、まさにβテスター自身が見極めるべき論点です。

長期的には、Fuguのような存在は基盤モデルとアプリケーションの間に位置する「コントロール層」あるいは「指揮者層」を新たに生み出す動きとして見るべきだと感じています。基盤モデルそのものを持たない国や企業でも、この層を握ることで上位のAI戦略を描けるようになる、ということです。日本発のスタートアップが世界の主要モデルを横断的に束ねる役割を取りにいく構図は、AI主権や経済安全保障の文脈でも示唆に富んでいます。

懸念点として、複数の外部APIを束ねる以上、可用性は常に各社の状態に依存します。料金体系はSakanaに一本化されるとはいえ、裏側でどのモデルがどれだけ使われたのかという透明性、ログ管理、データ取り扱いの責任所在は、企業導入の局面でよりシビアに問われていくはずです。生成AI規制が国際的に整備されつつあるなか、「複数モデルを動的に呼び出すシステム」が単一モデル前提の規制とどう折り合いをつけるかも、今後の論点になりそうです。

【用語解説】

マルチエージェント・オーケストレーション

複数のAIエージェント(個別の役割を持つAIモデル)を、一つの上位システムが指揮者のように動的に組み合わせ、協調動作させる仕組みである。単一モデルでは難しい複雑なタスクを、得意分野が異なるモデル群の連携で解く設計思想を指す。

基盤モデル(Foundation Model)/フロンティアモデル

大量のデータで事前学習された汎用大規模AIモデルのこと。「フロンティア」は、その時点で最先端の性能を持つモデル群を指す呼称として用いられる。

LLM(大規模言語モデル)

Large Language Modelの略。膨大なテキストデータで学習され、自然言語の生成・理解・推論を行う巨大なニューラルネットワークモデルである。

API(Application Programming Interface)

ソフトウェア同士が連携するための取り決めや窓口のこと。AI業界では、開発者が外部からモデルを呼び出して利用するための入り口を指す。

OpenAI形式エンドポイント

OpenAIが定義したAPIの呼び出し形式のこと。事実上の業界標準となっており、これに対応するサービスは既存コードの大幅修正なしで差し替え可能となる。

ベンチマーク(GPQA-D / LiveCodeBench v6 / SWE-Pro)

AIモデルの性能を客観的に測定するための標準化されたテスト群である。GPQA-Dは博士課程レベルの科学知識、LiveCodeBench v6はコード生成、SWE-Proは実際のソフトウェアエンジニアリング課題を扱う。

Thinker / Worker / Verifier

Trinity論文で提案された、コーディネーターがLLMに割り当てる3つの役割である。思考役・実行役・検証役と分担させることで、複雑な問題への対応力を高める。

進化計算(Evolutionary Strategy)

生物の進化(変異と選択)を模した最適化手法のこと。勾配を用いた一般的な機械学習とは異なり、勾配が取れない設定でもパラメータ探索が可能である。

テストタイム・スケーリング(推論時スケーリング)

学習済みモデルを再学習することなく、推論時に投入する計算量を増やすことで性能を向上させる手法を指す。Sakana Fuguでは再帰呼び出しの深さがその制御軸となる。

スキャフォールド(scaffold)

LLMにツール使用やマルチステップ推論を行わせるための足場となるエージェント実装のこと。同じモデルでもスキャフォールドが異なれば性能評価値が変わるため、ベンチマーク比較時には注意が必要である。

Marlin

Sakana AIが2026年4月初旬にリリースしたエンタープライズ向けリサーチエージェント。Sakana Fuguに先行する同社の商用プロダクト第1弾と位置付けられる。

【参考リンク】

Sakana AI 公式サイト(外部)

東京を拠点とする日本発のAI研究ラボの公式サイト。研究成果と商用プロダクト情報を発信している。

Sakana Fugu ベータ公式ブログ(外部)

本記事の一次情報源。製品概要、ベンチマーク、βテスト申し込みフォームへの導線を掲載。

Trinity論文(arXiv)(外部)

ICLR 2026採択論文。軽量コーディネーターが複数LLMを協調させる手法を提案する。

Conductor論文(arXiv)(外部)

ICLR 2026採択論文。自然言語によるエージェント・オーケストレーションの学習手法を提案する。

ICLR 公式サイト(外部)

機械学習分野の最高峰国際会議の公式サイト。査読付きで採択論文の質が高い学会である。

OpenAI 公式サイト(外部)

GPTシリーズおよびCodexの開発元。Fuguが互換するOpenAI形式APIは業界標準仕様となっている。

Anthropic 公式サイト(外部)

Claudeシリーズを開発する米AI企業。本記事ではOpus 4.6が比較対象として登場している。

Google DeepMind 公式サイト(外部)

Geminiシリーズを開発するGoogleのAI研究部門。本記事ではGemini 3.1が比較対象である。

【参考記事】

ICLR 2026 Poster: Trinity — An Evolved LLM Coordinator(外部)

学会公式ポスター。コーディネーターが約0.6Bパラメータの小型LMと約1万パラメータの軽量ヘッドで構成される点を要約。

Sakana Fugu Orchestration Beta(Aihola)(外部)

Fuguのスコアを示しつつ、Opus 4.6の53.4が条件不一致の自己申告値である点を批判的に指摘した記事。

Sakana AI Doc-to-LoRA: Instant LLM Knowledge Injection in 2026(Ai2.work)(外部)

創業者、Series B 1億3500万ドル調達、評価額26.5億ドルなどSakana AIの企業背景を詳述している。

Sakana AI Highlights TRINITY Coordinator as Core to Multi-Agent Product Strategy(TipRanks)(外部)

TRINITYが学習可能パラメータ2万未満で進化計算により訓練される仕組みを解説した記事。

Sakana AI Launches Beta of Sakana Fugu Multi-Agent Orchestration System(TipRanks)(外部)

βテスト開始発表を投資家視点で解説。基盤モデルと企業の間の「コントロール層」戦略と位置付ける。

Sakana AI Launches Fugu: Multi-Agent AI System Built on Collective Intelligence Research(Metaverse Post)(外部)

OpenAI形式API互換による既存ワークフローへの導入容易性を強調して解説した記事。

【関連記事】

Sakana Chat 公開|DeepSeek・Llama を日本仕様に再設計した「Namazu」とは何か

Sakana AIがFugu発表直前にリリースしたNamazuシリーズとSakana Chatを解説。同社の最新動向を追ううえで必読の記事。

Sakana AI TreeQuest:AI同士の協力で単体性能を30%向上、オープンソース化も発表

Fugu公式ブログでも研究系譜として明示されているMulti-LLM AB-MCTSをオープンソース化したTreeQuestの解説記事。

Sakana AIのM2N2進化アルゴリズム、コスト削減でAIモデル融合に革命

Sakana AIの「進化計算によるモデル融合」という思想を解説。Trinity論文で進化戦略が使われる技術的源流の理解に有効。

Sakana AI、世界初のAI生成論文が査読通過 – 科学研究の未来を変える日本発の技術革新

Fugu公式ブログでも研究系譜として明示されているThe AI Scientistを解説した、同社の代表作にまつわる記事。

Google Research/DeepMind・MIT「Towards a Science of Scaling Agent Systems」:マルチエージェントはいつ効き、いつ崩れるのか

マルチエージェントが効く条件と崩れる条件を数値で示した研究を解説。Fuguの優位性を相対化して読むための比較軸となる。

VS Code 1.107、マルチエージェント・オーケストレーション導入で複数AIの協調作業が可能に

開発環境側からマルチエージェント・オーケストレーションを実装する潮流を解説。Fuguがバックエンドのオーケストレーターであるのと対をなす視点。

Anthropic「Claude Agent SDK」が長時間稼働AIエージェント問題に挑む

マルチエージェント設計の競合潮流を理解する補助記事。長時間稼働するエージェントのメモリ設計とアーキテクチャの選択肢を整理している。

【編集部後記】

Sakana Fuguが投げかけているのは、「これからのAI活用は、どのモデルを使うかではなく、どう束ねるかで差がつくのかもしれない」という問いではないでしょうか。皆さんが普段GPTやClaude、Geminiを使い分けるとき、その判断を機械に任せられるとしたら、仕事の景色はどう変わりそうでしょうか。

日本発のスタートアップが「指揮者」のポジションを取りに行く動きについても、ぜひ自分ごととして眺めてみていただけたら嬉しいです。私自身も、βテストの行方を一緒に追いかけていきたいと思っています。