「もしもし」と話しかけたら、ほぼ間髪入れずに自然な日本語で返事が返ってくる――そんな会話体験を、不安定な車内のネット環境やスマートホーム機器でも実現する仕組みが、AWSから提示されました。鍵となるのは、音声から直接音声を生成する「Amazon Nova 2 Sonic」と、低遅延通信の代名詞「WebRTC」の組み合わせです。本記事では、スマート家電を声で操るシーンと、運転中のドライバーをAIが見守るシーンという、二つの具体例を通じて、私たちの暮らしと移動の風景がどう変わっていくのかを読み解いていきます。

AWSは2026年5月13日、Amazon Nova 2 Sonic(Nova Sonic)とAmazon Kinesis Video Streams WebRTCを組み合わせた、リアルタイム音声ストリーミングアプリケーション構築のソリューションを発表しました。

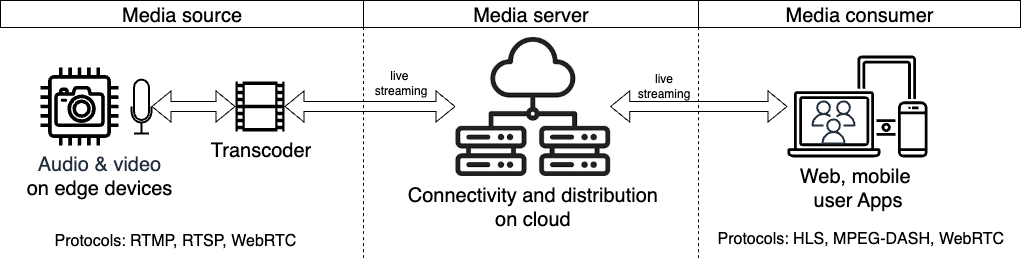

著者はジハン・ファン、ビン・チェン、ラナ・チャン、シヴァ・ソマスンダラムの4名です。Nova Sonicは統合されたスピーチ・トゥ・スピーチアーキテクチャを提供し、低レイテンシでの音声会話を実現します。WebRTCはアダプティブビットレート、前方誤り訂正、ジッターバッファ管理を備え、Chrome、Firefox、Safari、Edge、Android、iOSに対応します。実装にはPythonライブラリのaiortc、音声活動検出にはWebRTCVADを用います。音声データはWebRTC接続を介して伝送され、48kHzから16kHzへのリサンプリング、Int16からFloat32への変換などのフォーマット適応を行います。GitHubでは汎用サンプルに加え、Amazon Bedrock Knowledge BaseとAWS IoT Core向けMCPサーバーを用いたスマートホーム例と、コネクテッドカー例の2つのシナリオが提供されています。

From: ![]() Build real-time voice streaming applications with Amazon Nova Sonic and WebRTC

Build real-time voice streaming applications with Amazon Nova Sonic and WebRTC

【編集部解説】

今回のAWSによる発表は、一見すると「音声AI×ストリーミング技術の実装ガイド」という地味な技術記事に見えるかもしれません。しかし編集部としては、これが「会話するエッジAI」の本格普及を告げるマイルストーンであると捉えています。

従来の音声AIアシスタントは、音声認識、言語理解、音声合成という3つのモデルを直列でつなぐ「パイプライン方式」が主流でした。この方式の弱点は、各段階で文脈情報が削ぎ落とされることです。話者の抑揚、間の取り方、感情のトーン――こうした非言語情報は一度テキスト化された時点で失われてしまいます。Nova Sonicが採用する統合型アーキテクチャは、この情報損失そのものを構造的に解消しようという試みです。

今回の記事の本質的な新規性は、そのNova SonicをWebSocketではなく「WebRTC」で繋いだ点にあります。両者は似たプロトコルに見えますが、設計思想がまったく異なります。WebSocketはTCPベースで信頼性重視、一方のWebRTCはUDPベースでリアルタイム性重視です。音声会話のように「多少パケットが落ちても遅延ゼロのほうが嬉しい」用途では、後者が圧倒的に有利となります。

ここで注目したいのは、組み合わせの相手がAmazon Kinesis Video Streams WebRTCである点です。WebRTC自体は規格にすぎず、シグナリングサーバーやSTUN/TURNサーバーの運用は実装者の責任となります。これらをマネージドで提供するKVS WebRTCを使うことで、スタートアップでもインフラ運用負担なくグローバル展開が可能になる――この「参入障壁の劇的な低下」こそが、今回の発表の隠れた主役だと編集部は見ています。

具体的なユースケースとして提示された2つのシナリオも示唆的です。スマートホームの例では、Amazon Bedrock Knowledge Baseでユーザーの曖昧な指示からMQTTトピックを引き当て、AWS IoT Core向けのMCPサーバー経由でデバイスを操作します。「リビングをちょっと暗くして」という日常言語が、機器固有のコマンドへ翻訳されて伝わるわけです。

もう一つのコネクテッドカーの例は、技術的に踏み込んだ実装になっています。ドライバーの危険なスマホ使用を検出し、音声アシスタントが声をかけて注意を促す。同時に、独立した映像チャネルで監督者がリアルタイム映像を確認できる構造です

技術的なポイントとして特筆すべきは、サーバー側に音声活動検出(VAD)レイヤーを実装している点です。ガウス混合モデルベースのWebRTCVADを使い、無音区間や雑音をフィルタリングしてからNova Sonicに渡すことで、Nova Sonicが処理する音声トークン数を抑え、結果的にコストとレイテンシ双方を改善できる設計になっています。これは音声AIの商用運用において見落とされがちな、しかし極めて実利的な工夫です。

ポジティブな側面として、この組み合わせが切り拓く可能性は広範です。多言語切り替えに対応した会話AIにより、観光業や国際物流の現場での言語バリアが下がります。製造現場では多国籍チームの連携が滑らかになり、医療や介護では機器を物理的に操作できない人々にとっての新たなインターフェースとなり得ます。

一方で、潜在的なリスクも視野に入れておく必要があります。常時音声を聞き取るデバイスがクラウドに接続される構造は、プライバシー保護とデータ主権の観点で慎重な設計が求められます。EUのAI法や日本のAI事業者ガイドラインなど、音声バイオメトリクスを扱う際の規制枠組みは今後さらに厳格化していく可能性が高く、開発者は「技術的に可能なこと」と「社会的に許容されること」のギャップを常に意識する必要があるでしょう。

また、コネクテッドカーのシナリオで示された「ドライバー監視」は、安全向上に資する一方で、労働者監視や行動データの蓄積という側面も持ちます。技術の使い方しだいで福利にも管理ツールにもなり得る――この両義性は、設計段階から組み込んでおくべき論点です。

長期的視点で見ると、今回の発表は「クラウド上の大規模AIをエッジデバイスで違和感なく使う」という、ここ数年の業界課題に対する一つの解答提示です。Nova Sonicが東京リージョンで提供されている事実は、日本市場で低レイテンシの自然な音声体験を実装できる土台が整ったことを意味します。

「Tech for Human Evolution」を掲げるinnovaTopiaの視点からは、音声インターフェースは「人類が機械と関わる作法」を根本から書き換える技術領域です。キーボードとマウス、タッチスクリーンに続く第三の入力革命が、いま実装可能なレイヤーまで降りてきました。読者のみなさんがこの波にどう関わり、どう未来を形作るのか――そのための材料として、本記事を活用していただければと思います。

【用語解説】

スピーチ・トゥ・スピーチ(Speech-to-Speech, S2S)

音声入力を一度テキストに変換せず、音声から直接音声を生成する処理方式である。従来の「音声認識→言語処理→音声合成」という3段階パイプラインを単一モデルに統合することで、低レイテンシかつ抑揚や話し方といった音響的文脈を保持した応答が可能となる。

WebRTC(Web Real-Time Communication)

ブラウザ間で追加プラグインなしにリアルタイムの双方向通信を実現する公開標準プロトコルである。ピアツーピア接続によって中間サーバーを介さないため、HLSやMPEG-DASHなど他のストリーミング方式と比べ最も低レイテンシを実現できる。

シグナリングチャネル

WebRTC接続を確立する前段階で、ピア同士が接続条件(メディア仕様、ネットワーク経路候補など)を交換するための通信路を指す。Kinesis Video Streams WebRTCではこれをマネージドサービスとして提供する。

SDP(Session Description Protocol)/ICE(Interactive Connectivity Establishment)

SDPは接続条件(コーデック、解像度、暗号化方式など)を記述する標準書式である。ICEはNAT越えを含むネットワーク経路候補を相互に試して最適な接続パスを確立する仕組みを指す。

STUN/TURN

STUNは自身のグローバルIPアドレスを把握するためのプロトコルである。TURNは直接接続が不可能な場合に中継サーバー経由で通信を成立させる仕組みを指す。いずれもNAT越えに用いられる。

DTLS(Datagram Transport Layer Security)/SRTP(Secure Real-time Transport Protocol)

DTLSはUDP上での通信を暗号化するプロトコルである。SRTPはリアルタイム音声・映像データを暗号化して伝送する規格である。WebRTCは両者を組み合わせ、メディア通信のセキュリティを担保している。

アダプティブビットレート(ABR)/前方誤り訂正(FEC)/ジッターバッファ

ABRは回線状況に応じて伝送ビットレートを動的に変更する仕組みである。FECは送信側で冗長データを付加し、受信側でパケットロスを補完する技術を指す。ジッターバッファは到着間隔のばらつきを吸収し、滑らかな再生を保つ仕組みである。

VAD(Voice Activity Detection、音声活動検出)

音声信号の中から人間が発話している区間のみを抽出する技術である。無音や雑音区間を除外することで、認識精度向上と処理コスト削減に寄与する。本記事ではPythonのWebRTCVADライブラリ(ガウス混合モデルベース)が用いられている。

RAG(Retrieval Augmented Generation、検索拡張生成)

生成AIが回答する際、外部の知識ベースから関連情報を検索・取得し、それを根拠として応答を生成する手法である。AIモデル自体を再学習させずに、最新情報や独自データを反映できる。

MCP(Model Context Protocol)

AIモデルと外部ツール・データソースを接続するためのオープン規約である。Anthropicが2024年に公開し、現在は業界横断で採用が進んでいる。

Strands Agents

AWSが提供するAIエージェント構築用のオープンソースSDKである。複数のツールや言語モデルを組み合わせたエージェント型ワークフローを構築できる。

MQTT

IoT機器同士の通信に広く使われる軽量メッセージングプロトコルである。「トピック」と呼ばれる識別子を介して、機器が情報を発行・購読する仕組みを取る。

aiortc

PythonでWebRTC機能を実装するためのオープンソースライブラリである。SDP交換、DTLS、SCTP、SRTP、ピア接続といったWebRTCの主要機能を提供する。

HTTP/2双方向ストリーミング

HTTP/2の多重化機能を活用し、単一の接続上でクライアントとサーバーが同時かつ継続的にデータを送受信する通信方式を指す。Nova SonicのAPIはこの方式を採用している。

【参考リンク】

Amazon Nova(公式サイト)(外部)

AWSが提供する基盤モデル群「Amazon Nova」の総合ページ。各モデルの概要と価格情報を掲載している。

Amazon Nova 2 Sonic 製品ページ(外部)

スピーチ・トゥ・スピーチモデル「Amazon Nova 2 Sonic」の機能、対応言語、ユースケースを紹介する公式ページ。

Amazon Bedrock 公式サイト(外部)

Nova Sonicを含むAWSの基盤モデルを統合的に利用できるマネージドサービスのページ。

Amazon Kinesis Video Streams WebRTC 開発者ガイド(外部)

シグナリングチャネルの作成手順、SDK利用方法など、開発者向けの包括的なドキュメント。

AWS IoT Core 公式サイト(外部)

MQTTベースで数十億台規模のIoTデバイスを接続・管理できるマネージドサービスの公式ページ。

Amazon Bedrock Knowledge Bases(外部)

RAGを実現するためのフルマネージドサービスのページ。社内ドキュメントを基盤モデルに組み込める。

Strands Agents(GitHub)(外部)

AWSが公開するAIエージェント構築用オープンソースSDKのリポジトリ。実装の雛形を提供する。

aiortc(GitHub)(外部)

PythonによるWebRTC実装の代表的なオープンソースライブラリのリポジトリ。

py-webrtcvad(GitHub)(外部)

GoogleのWebRTCプロジェクト由来のVADエンジンをPythonから利用するためのバインディング。

Model Context Protocol(公式サイト)(外部)

AIモデルと外部ツール・データソースを接続するためのオープン規約「MCP」の公式サイト。

【参考記事】

Introducing Amazon Nova 2 Sonic: Our new speech-to-speech model for conversational AI(外部)

Nova 2 Sonicが米国東部、米国西部、東京リージョンで一般提供開始されたことを伝える公式発表記事。

Introducing Amazon Nova Sonic: Human-like voice conversations for generative AI applications(外部)

初代Nova Sonicの発表記事。統合モデルが解決する従来パイプラインの課題を説明している。

Using the Amazon Nova Sonic Speech-to-Speech model(外部)

双方向ストリーミングAPI、RAG連携、関数呼び出しなどNova Sonicの技術仕様を網羅した公式ドキュメント。

Amazon Kinesis Video Streams WebRTC: How it works(外部)

シグナリングチャネルの1対多モデルや最大10ビューワー接続など、アーキテクチャの仕様解説。

Speech-to-Speech (Amazon Nova 2 Sonic) – 公式ユーザーガイド(外部)

低レイテンシ多ターン会話、多言語サポート、ポリグロット音声などNova 2 Sonicの能力を整理した文書。

Getting started with speech-to-speech(外部)

入力16,000Hz・出力24,000Hz・8分の接続上限など、実装時に必要な数値仕様を記載した公式文書。

Enabling video chats using Amazon Kinesis Video Streams for WebRTC(外部)

WSSによる暗号化シグナリングや、STUN・TURN・ICE機能を備えたマネージドサービスの仕組み解説。

【編集部後記】

「機械と話す」という体験は、ここ数年で驚くほど自然なものになってきました。今回ご紹介した技術が普及していくと、私たちの生活のどの場面で会話型AIと触れ合う機会が増えていくでしょうか。車の中、キッチン、職場、あるいは旅先――場面によって、欲しい応答の速さや言葉づかいは違ってくるはずです。

みなさんは、どんな場面でなら機械との会話を心地よく感じられそうですか。逆に「ここはやはり人間と話したい」と思う領域はどこにありますか。よろしければ、ご自身の感覚を少し言語化してみてください。技術の未来は、使う側の私たち一人ひとりの感覚から形作られていくものだと感じています。