中国のBaiduが2026年5月9日、新たな大規模言語モデルERNIE 5.1を発表した。注目すべきは、性能ではなく「6%」という数字だ。AI開発の常識を覆す効率化戦略の意味を、技術と地政学の両面から読み解く。

2026年5月9日、Baiduは大規模言語モデルERNIE 5.1を正式リリースした。ERNIE 5.0の事前学習基盤を継承しつつ、総パラメータ数を約3分の1、アクティブパラメータ数を約2分の1に圧縮し、同等規模モデルの事前学習コストの約6%で開発された。

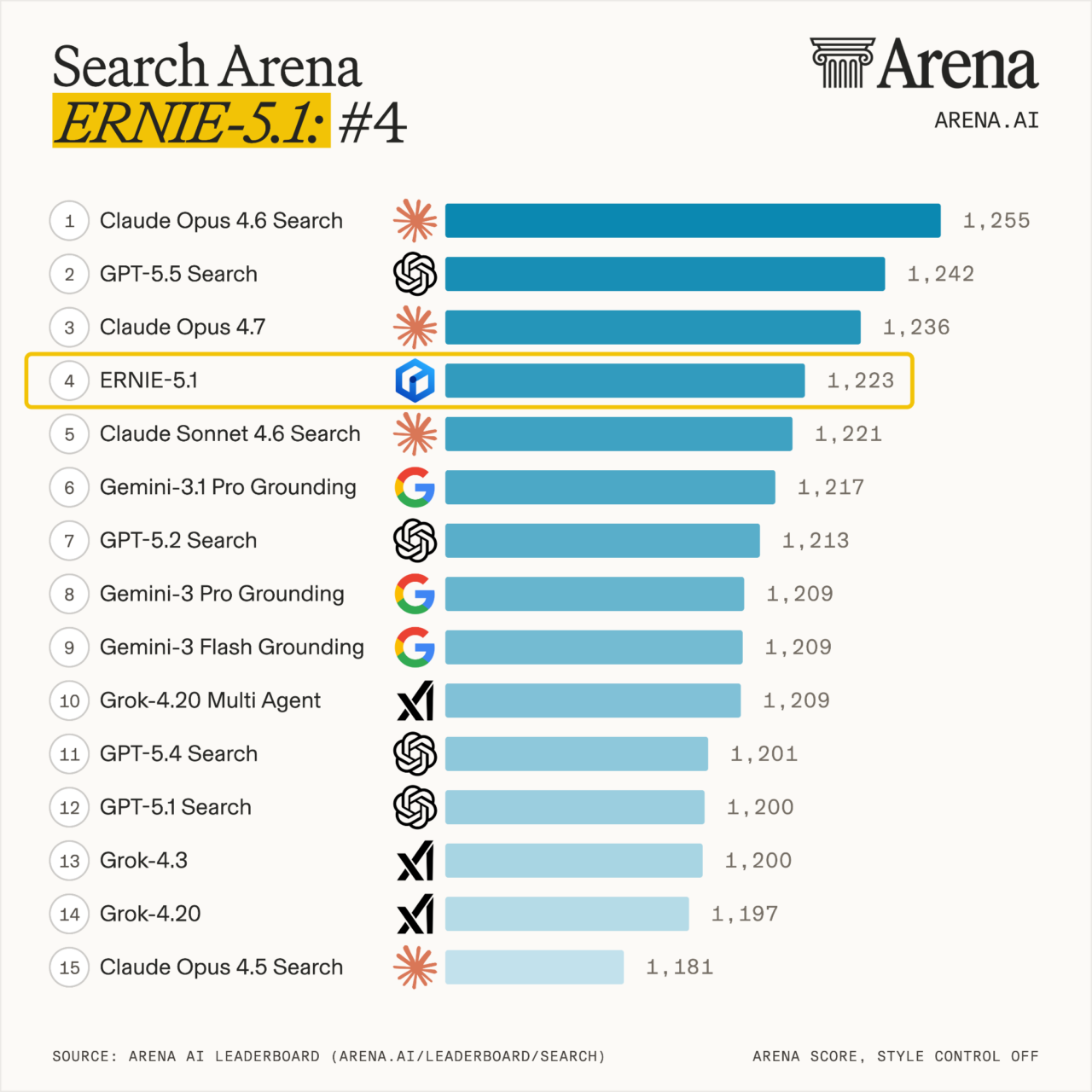

5月9日時点でArena Searchリーダーボードにおいて1,223ポイントを記録し、グローバル4位、中国モデル中1位を獲得した。τ³-benchおよびSpreadsheetBench-VerifiedではDeepSeek-V4-Proを上回り、AIME26(ツール使用あり)では99.6点でGemini 3.1 Proに次ぐ2位となった。GPQAおよびMMLU-Proでも主要クローズドソースモデルに近い性能を示した。技術的には、Once-For-Allエラスティック学習フレームワーク、PaddlePaddle上に構築した分離型完全非同期強化学習インフラ、Multi-Teacher On-Policy Distillation(MOPD)を中核とする4段階ポストトレーニングを採用している。同日より、ISEKAI ZERO、Mulan AI、Diting Huanliu、Storymasterなど10超の創作エージェントプラットフォームへ段階的に展開される。

【編集部解説】

まず押さえておきたいのは、ERNIE 5.1が「ゼロから訓練された新モデル」ではないという点です。2026年1月22日に正式リリースされたERNIE 5.0(総パラメータ2.4兆、ネイティブマルチモーダル対応)から、最適なサブネットワークを抽出して構築されています。

これはBaidu独自の「Once-For-All」エラスティック学習という発想によるもので、ERNIE 5.0を訓練した時点で、深さやエキスパート容量の異なる多数のサブモデルが同時に最適化される設計になっていました。ERNIE 5.1は、その巨大な「親モデル」の中から、最も効率の良い部分を切り出して仕上げ直した、と理解するのが適切です。

事前学習コストが「同等規模モデル比6%」という主張については、注意深く読む必要があります。これはあくまでBaidu自身の発表に基づく数字であり、独立した第三者検証は現時点で行われていません。とはいえ、もし同社の主張が再現可能なものであれば、フロンティアレベルの性能を、フロンティア級の計算予算なしで達成するテンプレートとなる可能性があり、AI開発の経済構造そのものに影響を与えうる話です。

ベンチマークの解釈にも丁寧さが求められます。Arena Searchで4位というのは、検索を伴う質問応答に特化した評価で、Baiduが20年以上にわたり中国市場で検索エンジンを運営してきた蓄積を考えれば、ある意味で本領発揮の領域と言えます。一方、海外メディアFello AIの分析によれば、LMArenaのテキスト部門での順位は13位前後にとどまっており、汎用言語能力ではGPT-5.5やClaude Opus 4.6、Gemini 3.1 Proといった最上位勢にはまだ届いていないことも事実です。「検索が強い」と「汎用能力が世界一」は別の話として読み解く必要があります。

技術的に注目すべきは、MOPD(Multi-Teacher On-Policy Distillation)と呼ばれるポストトレーニング手法です。従来のLLM学習では、「コーディング能力を上げると創作能力が落ちる」といった、いわゆるシーソー効果が深刻な課題でした。MOPDは、分野ごとに特化したエキスパートモデルを並列で訓練し、それらを「教師」として一つの統合モデル(生徒)に蒸留するという発想です。興味深いのは、Xiaomiの研究チームがMiMo-V2-Flashで類似のアプローチを発表しており、この手法が中国の主要AIラボで共通の方向性として浮上しつつある点です。

日本の読者にとっての意義を考えると、これは「中国製AIをどう評価するか」というメタな問題提起でもあります。欧米メディアの多くはERNIEシリーズを脚注的に扱う傾向がありますが、コストパフォーマンスと実用領域での性能を見れば、無視できる存在ではなくなっています。エンタープライズ用途で複数のAIプロバイダーを比較検討する局面では、選択肢としての視野に入れる価値があるでしょう。

ただし潜在的なリスクも明記しておく必要があります。ERNIE 5.1はオープンウェイトではなく、ローカル展開やハードウェア管理を必要とする用途には適しません。データの所在、検閲ポリシー、地政学的なリスクも、企業利用では避けて通れない論点です。同時に、Baidu傘下のKunlun Chip(昆崙芯)が、それぞれ2026年と2027年にM100、M300チップの投入を控えており、ハードウェアからモデルまで自社で垂直統合する戦略が見えてきています。米国による先端半導体輸出規制の文脈で、この自前主義はますます重要な意味を持つはずです。

最後に、Baiduは2026年5月13日から14日にかけて北京で「Create 2026 Baidu AI Developer Conference」を開催予定です。共同創業者兼CEOのロビン・リー氏(李彦宏)からは、技術的な詳細と商業化計画について追加発表が見込まれており、ERNIE 5.1の本当の評価はそこから始まるとも言えます。「未来を報じる」私たちとしては、続報を含めて引き続き注視していきたいと考えています。

【用語解説】

MoE(Mixture of Experts、混合エキスパート)

モデル内部に複数の「エキスパート(専門家ネットワーク)」を配置し、入力に応じて一部だけを選択的に活性化させる仕組みである。総パラメータ数を巨大化させつつ、推論時の計算コストを抑えられるのが利点だ。

アクティブパラメータ/総パラメータ

MoEモデルにおいて、推論時に実際に計算に使われるパラメータが「アクティブパラメータ」、モデル全体に存在するパラメータの総和が「総パラメータ」である。両者の比が小さいほど計算効率が高いとされる。

Once-For-All(一度の学習で多様な構成を取り出す)

異なる規模・構造のサブモデルを単一の事前学習プロセス内で同時に最適化する手法である。従来は規模ごとに別々の学習が必要だったが、この手法では「親モデル」から複数の派生モデルを抽出できる。

強化学習(Reinforcement Learning, RL)

エージェントが環境との相互作用を通じて、報酬を最大化する行動方針を学習する手法である。LLMのポストトレーニングでは、人間の選好やタスク成功率を報酬信号として用いることが一般的だ。

MOPD(Multi-Teacher On-Policy Distillation、マルチティーチャー・オンポリシー蒸留)

ドメインごとに特化させた複数のエキスパートモデル(教師)から、統合モデル(生徒)が同時に知識を引き継ぐ蒸留手法である。能力ごとに学習を分離することで、ある能力を伸ばすと別の能力が落ちる「シーソー効果」を回避することを狙う。

シーソー効果(Seesaw Effect)

複数の能力を一つのモデルに同時に詰め込もうとすると、ある領域の性能向上が別の領域の性能低下と引き換えになる現象を指す。多目的最適化の難しさを表す業界用語である。

FP8(8ビット浮動小数点演算)

従来主流であったFP16やBF16より精度を落とし、ビット幅を8ビットに圧縮した数値表現である。メモリ使用量と計算コストを大幅に削減できる一方、精度管理が技術的な鍵となる。

KLダイバージェンス(Kullback-Leibler Divergence)

二つの確率分布の差を測る指標である。蒸留や強化学習において、生徒モデルの出力分布が教師モデルや基準分布からどれだけ離れたかを測る目的で使われる。

ロングテールタスク

発生頻度は低いものの種類が膨大に存在する「裾野の長い」タスク群を指す。実世界の多様なエッジケースに対応するには、このロングテール領域での安定性が不可欠となる。

Arena Search(LMArena Search Arena)

LMArenaが運営する、検索を伴う質問応答に特化した評価リーダーボードである。実ユーザーが匿名化されたモデル同士の回答を比較投票する方式で順位が決まる。

τ³-bench(Tau3-bench)

マルチステップのエージェント実行能力を、現実的なシナリオで評価するベンチマークである。

SpreadsheetBench-Verified

表計算ソフト上での構造化データ処理能力を測るベンチマークである。ビジネスワークフローに直結する実用性が問われる。

GPQA/MMLU-Pro

GPQAは博士課程レベルの科学知識を、MMLU-Proは幅広い学術分野の知識と推論を評価するベンチマークである。世界知識の指標として広く参照されている。

AIME26

2026年版のAmerican Invitational Mathematics Examinationに基づく、難関数学コンペティション形式の推論ベンチマークである。

ロビン・リー(李彦宏)

Baiduの共同創業者兼CEOである。

【参考リンク】

Baidu ERNIE公式サイト(外部)

Baiduが提供するERNIEシリーズの公式ポータル。最新モデルとの対話やリリース情報を確認できる。

Baidu AI Studio(飞桨AI Studio)(外部)

ERNIE 5.1 Playgroundを含む、Baiduの開発者向けAIプラットフォームである。

PaddlePaddle公式サイト(外部)

ERNIE 5.1の学習基盤となったBaidu製の深層学習フレームワーク。2016年にオープンソース化された。

PaddlePaddle GitHubリポジトリ(外部)

PaddlePaddleのソースコードが公開されている公式リポジトリ。最新の更新情報も確認できる。

Baidu公式サイト(企業情報)(外部)

Baiduの企業情報・投資家向け情報を掲載した公式サイト。決算資料や戦略発表もここから入手できる。

LMArena(外部)

ERNIE 5.1がランクインしたAIモデル評価リーダーボードの運営元。匿名比較投票方式を採用する。

DeepSeek公式サイト(外部)

ERNIE 5.1のベンチマーク比較対象となったDeepSeek-V4-Proの開発元である。

Google Gemini公式サイト(外部)

比較対象として言及されているGemini 3.1 Proの公式サイトである。

Anthropic公式サイト(外部)

Claude Opus 4.6を提供するAI企業の公式サイトである。

ISEKAI ZERO公式サイト(外部)

ERNIE 5.1が段階展開されるAIロールプレイ・インタラクティブプラットフォームである。

【参考記事】

Baidu releases Ernie 5.1 with pre-training cost at only 6% of industry peers(CnTechPost)(外部)

ERNIE 5.1がLMArenaのSearch Leaderboardで1,223ポイント、グローバル4位を獲得した経緯を伝える中国テック専門メディアの報道。

Baidu’s ERNIE 5.1 Just Released(Fello AI)(外部)

ERNIE 5.1の技術的位置付けと過去シリーズとの比較、LMArenaテキスト部門でグローバル14位を獲得した点を詳述。

Baidu Launches Ernie 5.1 AI Model, Cutting Pretraining Costs by 94%(BigGo Finance)(外部)

ERNIE 5.1の電力消費試算とKunlun Chipの上場準備など、経済的インパクトに焦点を当てた金融系メディアの報道。

Baidu’s ERNIE 5.1 Is Rivaling Gemini 3.1 Pro at AI Search(Firethering)(外部)

AIME26、τ³-bench、SpreadsheetBenchの各ベンチマーク数値を競合モデルと比較検証した分析記事。

Baidu ERNIE 5.1 Hits No. 1 Chinese Model on LMArena(Remio AI)(外部)

ERNIE 5.1 Previewが2026年4月30日に公開されたこと、カテゴリ別ランキングでの順位を詳述している。

MiMo-V2-Flash Technical Report(arXiv)(外部)

Xiaomiが発表したMOPD採用モデルの技術レポート。中国主要AIラボでMOPDが共通トレンド化していることを裏付ける。

Baidu Unveils ERNIE 5.0 and a Series of AI Applications at Baidu World 2025(PR Newswire)(外部)

ERNIE 5.0発表時の公式プレスリリース。Kunlunxin M100/M300の戦略的位置付けも記載。

ISEKAI ZERO: The Interactive Adventure Platform Redefining AI-Generated Stories(AI DayaHimour)(外部)

ERNIE 5.1の展開先プラットフォーム、ISEKAI ZEROの運営企業と技術的背景を解説。

【関連記事】

ERNIE Bot 5.0が登場、Baiduの「ネイティブフルモダリティ」が切り拓くAIの新境地

ERNIE 5.1の「親モデル」となるERNIE 5.0の正式リリースを報じた、本記事の直接の前提記事。総パラメータ2.4兆、ネイティブマルチモーダル統合の技術的詳細を解説している。

百度ERNIE 5.0、MAU2億人突破──AIが中国人海外旅行者の「検索」を「対話」に変える

ERNIE 5.0の市場浸透状況と、Alibaba通義千問、ByteDance豆包など中国AI市場の競争環境を扱った続報。実利用面での到達点が見える。

「Baidu ERNIE 5.0」登場|新時代マルチモーダルAIの最新ベンチマーク

ERNIE 5.0プレビュー版発表時のベンチマーク報道。GPT-5やGemini 2.5 Proとの比較を通じ、BaiduのグローバルAI戦略を読み解いている。

Baidu ERNIE-4.5新モデル公開:280億パラメータでGemini 2.5 Proを上回る性能

ERNIE 5.1にも継承されるMoEアーキテクチャの系譜を、オープンソース版ERNIE 4.5の事例から追える参考記事。

ERNIE Bot完全無料化へ|バイドゥのAIチャットボット、4月から全機能開放

Baiduが推論コストを年間90%削減できるようになった背景と、無料化戦略の経済合理性を伝えた記事。今回のコスト効率化議論の起点となる。

Baidu、GPT-4.5の1%の価格で高性能AIモデル「ERNIE 4.5」を発表

ERNIE 4.5/X1の発表時、価格戦略をGPT-4.5比1%と打ち出した報道。Baiduの「規模より効率」路線の早い段階の事例として参照できる。

【編集部後記】

ERNIE 5.1のリリースは、AIの進化が「より大きく」から「より賢く、より効率的に」というフェーズへ移り変わりつつあることを示しているのかもしれません。みなさんは、生成AIを選ぶとき何を基準にされていますか。

性能の高さ、コスト、開発元の国、それともデータの扱われ方でしょうか。中国発のモデルは選択肢として視野に入れているでしょうか。今後も、フロンティアの動きを偏りなくお伝えしていきたいと考えています。みなさんの感じる「ここが気になる」も、ぜひ聞かせてください。