スマートグラスの普及を阻んできた壁の一つは、「何ができるか」の狭さでした。ハードウェアは進化しても、利用できるアプリがメーカー製のみに限られていては、デバイスの可能性は閉じたままです。Metaが「Ray-Ban Displayグラス」をサードパーティ開発者に開放したことで、799ドルのスマートグラスはいよいよプラットフォームとしての本格始動を迎えようとしています。

MetaはMeta Ray-Ban Displayグラスをサードパーティ開発者に開放し、ディスプレイ対応アプリとNeural Bandコントローラーを使った開発が可能になった。iOSおよびAndroidのモバイルアプリとWebアプリに対応する。

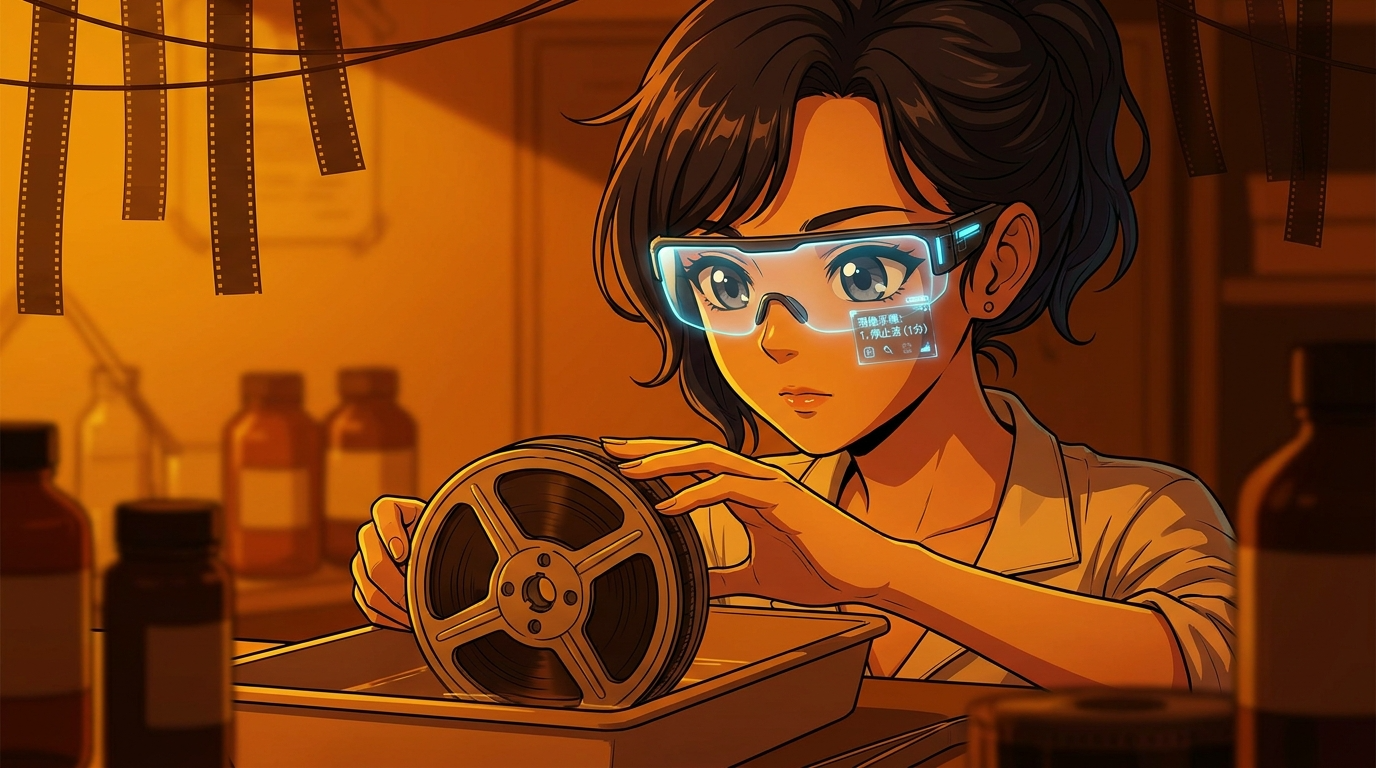

視野角20度の単眼ディスプレイを活かした「情報オーバーレイ」や「マイクロアプリ」を主な用途として想定しており、フィルム現像ガイド「Darkroom Buddy」やチェス・スネークなどミニゲームのサンプルも公開された。昨秋799ドルで発売された同グラスはこれまでMeta製アプリのみに対応していた。実際の提供時期は未定で、ディスプレイ負荷によるバッテリー消耗も懸念として挙がっている。

既存ユーザー向けには「ニューラルハンドライティング」機能の全ユーザー開放、ディスプレイ録画機能の追加、Messenger・WhatsApp・Instagramの通話でのライブキャプション対応が即日提供される。また、Metaは次のConnectイベントの日程を発表しており、マーク・ザッカーバーグCEOは次世代モデルとみられる新グラスを示唆している。

From: ![]() Meta is bringing third-party apps and games to its display glasses

Meta is bringing third-party apps and games to its display glasses

【編集部解説】

今回の発表を理解する鍵は、これがいきなり訪れた変化ではなく、Metaが2025年から段階的に進めてきたプラットフォーム化戦略のもう一歩前進である、という点にあります。

時系列を整理すると流れが見えやすくなります。2025年9月のMeta Connect 2025で、同社は「Wearables Device Access Toolkit」と呼ばれる開発者向けツールキットを発表しました。ただしこの時点で利用できたのはディスプレイ非搭載のRay-Ban MetaとOakley Meta向けで、初期パートナーはTwitch(ライブ配信)、Disney(テーマパーク内ガイド)、Streamlabsなどの限定的なグループに絞られていました。プレビュー段階での制約はかなり厳しく、カメラと音声入出力が中心で、ディスプレイ機能へのアクセスは「将来のイテレーションで拡張する予定」と公式FAQに明記されていました。

今回(2026年5月14日)の発表は、その「将来」が来たことを意味します。Ray-Ban Displayのディスプレイそのものへ書き込めるWebアプリおよびモバイルSDKがDeveloper Previewとして開発者に開かれた——これがプラットフォームとしての本質的な転換点です。

ここで注目すべきは、Engadgetの記事が指摘した「Metaは昨年、ディスプレイなしのスマートグラス向けにサードパーティアプリのサポートを発表していたが、その多くはまだ提供されていない」という事実です。8ヶ月以上が経過してもアプリの一般公開が進んでいない状況で、Metaはさらに踏み込んだ開放を選びました。慎重に時間をかけて開発者エコシステムを育てる姿勢は、過去のスマートグラス領域における失敗事例——Google Glass(2013年)が直面した「何のためのデバイスか分からない」問題——を強く意識したものに見えます。

タイミングの妙もあります。Metaは2026年5月12日、Connect 2026を9月23〜24日に開催すると発表したばかりです。今回の開発者向け開放は、約4ヶ月後の本番イベントまでに「初期サードパーティアプリ群」が揃う準備期間を確保する布石と読めます。ザッカーバーグCEOが次世代モデルの存在を示唆していることも合わせると、Connect 2026は「ハードウェア新製品+本格的なアプリエコシステム」という、これまで一度も実現していないスマートグラスの完成形をMetaが提示する場になる可能性が高いと考えられます。

「glanceable」という第3のインターフェース

もう一つ重要なのは、Metaが今回開発者に示した用途のイメージです。視野角20度の単眼ディスプレイは、Apple Vision Proのような完全没入型でもなく、両眼waveguide方式の競合とも異なります。Metaが提示した用途——「情報オーバーレイ」「マイクロアプリ」「スコアやステータスのリアルタイム表示」、そして象徴的な例としてのフィルム現像ガイド「Darkroom Buddy」——を眺めると、ある共通点が浮かびます。

すべてが「ちらっと見る」(glanceable)ことに最適化されている、という共通点です。

これは新しい人間とコンピュータの関係を提案しています。スマートフォンは「手に取って見る」ことを前提に設計されています。Vision Proのようなヘッドセットは「視界を完全に乗っ取る」ことで没入を作ります。スマートウォッチは「腕を上げて手首を見る」という動作で情報を取り出します。Ray-Ban Displayが提示するのは、そのいずれでもない第4の様式——「視界の片隅に常に存在する小さな情報レイヤー」です。

Darkroom Buddyが象徴的なのは、暗室作業中という両手がふさがり、スマホが取り出せない状況での参照ツールという点にあります。Meta CTOのアンドリュー・ボスワースが公開した動画で紹介されたこのアプリは、「ちらっと見る(glanceable)」参照ツールとして機能するとされています。料理中にレシピを横目で確認する、ランニング中にペースを視野の隅で見る、会議で発言者の名前と肩書きを補助線として表示する。こうした用途は、スマホでもVRヘッドセットでも実現が難しい領域です。

ただし、この方向性には固有の難しさもあります。「ちらっと見る」体験は密度の濃いアプリには向きません。複雑なゲームや長文の閲覧は、20度視野角の単眼ディスプレイには適さない。Metaが「マイクロアプリ」「ミニゲーム」という言葉を使い続けているのは、その制約への自覚の表れです。開発者にとっては、既存のスマホアプリをそのまま移植する発想では失敗する、ということでもあります。スマホとは別物の体験設計が必要になります。

Engadgetのレビュアーが「料理中にレシピをディスプレイで見たかったが、Meta AIに尋ねるしか方法がなかった」と語っていますが、これは象徴的な不満です。すでに使われ尽くしているユーザー行動(レシピ参照)に対し、わざわざAIに音声で問い直すという摩擦が発生する。サードパーティ開放が解こうとしているのは、まさにこの「日常の小さな不便」のための小さなアプリが量的に揃わない、という構造的な問題です。

Neural Bandの開放が意味すること

今回の発表でもう一つ見落とせないのは、ディスプレイ機能だけでなくNeural Bandコントローラーも開発者に開放された点です。

Neural Bandは2025年9月のConnect 2025で発表され、9月30日にRay-Ban Displayとセットで$799のバンドル価格で発売されました。これはMetaが2019年に買収したCTRL Labsのsurface EMG(表面筋電図)技術を、6〜7年の歳月をかけてようやく消費者製品まで仕上げたものです。

技術的に何が新しいのかを簡単に説明します。EMG(筋電図)は手首・前腕の筋肉が指を動かそうとする際に発する微小な電気信号を読み取る技術で、Metaの実装は手をカメラの視野に入れる必要がなく、机の下や腕を下ろした状態でも精密な指の動きを検出できます。同社はこの技術の基礎研究を学術論文として『Nature』に発表しており、査読を経た裏付けがある点も他の入力デバイスとは一線を画します。

ARグラスが長年抱えてきた問題の一つは「入力をどうするか」でした。声で操作するのは公共空間では気が引ける、空中で手を振るジェスチャーは社会的にぎこちなく見える、コントローラーを持ち歩くのは煩わしい。Neural Bandは「ポケットに手を入れたまま、指先で操作できる」という、ARグラスの社会的受容に直結する選択肢を提示しています。

このNeural Bandを使った入力APIがサードパーティ開発者に開放されたということは、開発者が新しい入力体験そのものを再発明できる、ということを意味します。スマホのタッチパネルがアプリ開発者の創造性を大きく解放したように、EMG入力もまた、まだ誰も想像していないインタラクションを生み出す可能性があります。これは8ヶ月がかりのプラットフォーム化戦略の中でも、最も野心的な部分かもしれません。

Android XR、そして競合の影

最後に、なぜMetaがこのタイミングで動いたのかという文脈に触れておく必要があります。

2026年は、スマートグラス領域における競合環境が一気に変化する年です。GoogleはAndroid XRを基盤とするスマートグラスを、Samsung・Warby Parker・Gentle Monsterと協業して2026年内に投入する計画を進めています。Android XRの最大の強みは「既存のAndroidアプリを土台に膨大なエコシステムを継承できる」点にあり、Metaの閉じたエコシステムに対する構造的な対抗軸となります。

中国系のRokid Glassesは2026年3月にGoogle Geminiをネイティブ搭載した最初のスマートグラスとなり、約$599という価格でmicro-LED両眼ディスプレイ(デュアルウェーブガイド方式)を提供しています。価格面でも機能面でも、Meta Ray-Ban Displayの$799という価格設定に直接的な圧力を与える存在です。

一方Appleについては、自社のスマートグラスは2027〜28年の投入予測が大勢で、当面は競合の中心ではありません。ただしApple Intelligenceを組み込んだ製品が登場すれば一気に競争地図が塗り替わる可能性は残っています。

Metaの選択は、こうした地殻変動に対する応答として読めます。「閉じた高品質エコシステム」を保ったまま競合のオープン性に対抗するのは難しい——だからこそ慎重に、しかし着実にサードパーティを取り込む段階を踏んできた。今回の発表は、その戦略がいよいよ核心部分(ディスプレイとEMG入力)に到達したことを示しています。

ただし、Engadgetの記事が指摘した「昨年発表されたサードパーティアプリの多くがまだ提供されていない」という事実は、Metaにとって深刻な警鐘です。SDKを開放するだけではアプリは生まれません。開発者にとって投資する価値のあるプラットフォームだと示すには、ユーザー基盤の大きさ、収益化の手段、開発の容易さといった多角的な条件が必要です。Connect 2026で何が示されるかによって、Metaのプラットフォーム戦略の成否はかなりの部分が決まると言えそうです。

【用語解説】

Neural Band(ニューラルバンド)

Meta Ray-Ban Displayと同時発売されたEMGリストバンド型コントローラー。手首・前腕の筋肉が生成する電気信号を読み取り、指の動きでグラスを操作できる。2025年9月30日発売、Ray-Ban Displayとのバンドル価格は$799。

sEMG(表面筋電図 / surface electromyography)

筋肉の収縮時に発生する微弱な電気信号を皮膚表面から非侵襲的に計測する技術。Neural Bandはこの技術を用い、手をカメラの視野に入れずに指の精密な動きを検出する。MetaはCTRL Labsの買収(2019年)を経てこの技術を製品化。基礎研究は学術誌『Nature』に査読論文として掲載されている。

Wearables Device Access Toolkit

Meta Connect 2025(2025年9月)でMetaが発表したウェアラブル向け開発者ツールキット。当初はディスプレイ非搭載のRay-Ban MetaとOakley Meta向けで、カメラ・音声機能を中心とした限定的なAPIを提供。2026年5月に今回のアップデートでRay-Ban DisplayのディスプレイとNeural Band入力APIが追加され、Developer Previewとして開放された。

Meta Connect

Metaが年次開催するデベロッパー・製品発表イベント。VR/ARおよびスマートグラス関連の主要な新製品・新機能がここで発表されることが多い。2026年の開催は9月23〜24日が予定されている。

CTRL Labs

手指の神経・筋肉信号をコンピュータ操作に変換するインターフェース技術を開発したスタートアップ。MetaがEMG技術の獲得を目的として2019年に買収(買収額は非公開。報道では5億〜10億ドル規模とされる)。Neural Bandの技術的基盤となっている。

glanceable(グランサブル)

「ちらっと見る」「瞬間的に確認できる」を意味する英語。スマートウォッチの情報設計などで広く使われる概念で、視線を長時間奪わず必要な情報だけを瞬時に表示するUXを指す。Meta Ray-Ban Displayが想定する用途の基本思想として、Meta CTOのアンドリュー・ボスワースが公開した動画で言及された。

【参考リンク】

Meta Ray-Ban Display 製品ページ(外部)

Metaによる公式製品ページ。スペック、対応機能、購入情報。視野角・解像度(600×600ピクセル)などのハードウェア詳細も確認できる。

Ray-Ban公式 Meta Ray-Ban Display(外部)

Ray-Banブランドによる製品紹介ページ。フレームデザイン・カラー展開など、ファッション面での情報が充実。

Meta for Developers — Wearables(外部)

開発者向けツールキット(Wearables Device Access Toolkit)の公式ドキュメント。今回開放されたディスプレイAPIとNeural Band入力APIの詳細・申請フォームへのアクセス。

Meta Connect 2026(外部)

Meta Connect公式ページ。2026年の開催情報(9月23〜24日)が掲載されており、今後のスマートグラスアップデートの情報が集まる場所。

MetaのEMG技術紹介(外部)

MetaによるsEMG技術の公式解説ページ。Neural Bandの技術原理・機械学習による信号変換・応用可能性をビジュアルとともに説明している。

【参考動画】

【参考記事】

Introducing the Meta Wearables Device Access Toolkit — Meta for Developers

2025年Connect 2025時点での開発者ツールキット発表記事。初期パートナー(Twitch、Disney、Streamlabs)の紹介と、当時のディスプレイ非対応という制約が記録されており、今回の進展との差分を把握するための一次情報源。

New Meta Developer Tool Enables Third-parties to Bring Apps to its Smart Glasses for the First Time — Road to VR(2025年9月)

Connect 2025時点でのToolkit発表を詳報した記事。2025年9月時点でディスプレイAPIが未開放だった経緯とその技術的背景を整理しており、今回の変化の文脈を理解する上で有用。

Meta Details EMG Wristband Gestures You’ll Use To Control Its HUD & AR Glasses — UploadVR

Neural Bandの技術基盤であるsEMGに関する『Nature』掲載論文を取り上げた記事。CTRL Labs共同創業者Thomas Reardonの現在の役割と、低消費電力という技術的特性も紹介している。

Save the Date: Meta Connect 2026 — Meta公式ブログ(2026年5月12日)

Connect 2026(9月23〜24日)の開催告知。今回のサードパーティ開放発表との時間的関係を確認できる。

Android XR Glasses Beat Meta Ray-Ban in 3 Key Areas — Next Reality

Android XRを軸にしたGoogleのスマートグラス戦略とMetaの比較分析記事。既存Androidアプリ資産の継承というGoogleの強みと、Metaが閉じたエコシステムを段階的に開放せざるを得ない構造的背景を理解する文脈として有用。

【編集部後記】

スマートグラスに期待しては待つ、という経験を、私たちは何度か繰り返してきました。Google Glassの頃から10年以上が経ちます。

Metaが今回提示した方向性は、没入でも大画面でもなく、「ちらっと見る」という小さな行為への賭けです。暗室でフィルムを現像しながら視野の端に手順を映す——そんな断片的な日常の隙間に、次のインターフェースが宿るとしたら。

開発者たちが何を持ち込んでくるのか、私たちにはまだ想像できません。